Schlagwort: Technologie

Bild: Ian Usher / Unsplash

11.05.2026 | hoouadmin

Herausforderung Drohnen: Cyberangriffe von oben

Für die meisten Menschen ist eine Cyberattacke etwas, das im eigenen Postfach oder Netzwerk lauert. Doch was vielen nicht bewusst ist: Durch Drohnen können solche Angriffe heute auch über unseren Köpfen oder vor unserem Fenster passieren. Was Kriminelle bewegt, Drohnen einzusetzen, wie sie das tun und wie wir uns schützen können. Ein Beitrag von Prof. Dr. Volker Skwarek (HAW Hamburg), Host des HOOU-Podcasts „Die Sicherheits_lücke“

Drohnen: Errungenschaften der Technik, die nicht nur regelmäßig über, sondern mittlerweile auch in unseren Köpfen schwirren. In einer Vielzahl von Anwendungen sind sie längst fest etabliert: Sie transportieren Pakete, überwachen Wälder bei Brandgefahr oder liefern spektakuläre Luftaufnahmen bei Open-Air-Events. Wie bei jeder technologischen Innovation bringt der vermehrte Einsatz von Drohnen jedoch auch eine Reihe an Herausforderungen mit sich. Und Cyber(un)sicherheit steht in diesem Fall ganz oben auf der Liste.

Luftfahrtrechtlich als UAVs (Unmanned Aerial Vehicles) bezeichnet, sind Drohnen unbemannte Fluggeräte, die entweder autonom fliegen oder ferngesteuert werden. Ausgestattet mit Kameras und Sensoren können sie zahlreiche Aufgaben übernehmen, die sich üblicherweise mit Überwachung oder Dokumentation befassen. Für jede davon gibt es inzwischen spezialisierte Drohnen sowie die entsprechenden Konfigurationen.

Aber unabhängig davon, ob es sich um eine Drohne für Filmaufnahmen, eine militärische Drohne oder eine Do-it-yourself-Version im 3D-Druck handelt: Jede Drohne stellt ein potenzielles Risiko für einen Cyberangriff dar – und kann dabei sowohl Werkzeug als auch Ziel des Angriffs sein.

Die Schattenseiten der Freiheit

Drohnen sind inzwischen in einem breiten Spektrum und einer großen Preisspanne verfügbar. Sie sind oft sehr einfach zu steuern, klein und relativ unauffällig. Während sie im Flug einfach Grenzen überwinden und dadurch viele neue Möglichkeiten und Anwendungsfälle eröffnen, ziehen sie auch unweigerlich die Aufmerksamkeit von Cyberkriminellen auf sich. Denn die oben erwähnten Vorteile machen Drohnen auch zu äußerst attraktiven Begleitern für Cyberangriffe in sensiblen Bereichen, die ohne sie nicht zugänglich wären.

Doch wer nutzt Drohnen für Cyberangriffe? Und mit welcher Motivation wird ein solcher Cyberangriff ausgeführt? Auch wenn es sicher nicht eindeutig differenzierbar ist, so lassen sich verschiedene Kategorien von Angreifenden nach Mitteln und Zielen unterscheiden.

Wer nutzt Drohnen für Cyberangriffe?

Da sind zum einen die sogenannten Skriptkiddies: Diese Personengruppe, zumeist Menschen mit wenig Informatikkenntnissen, hat eingeschränkte technische und finanzielle Möglichkeiten und probiert beispielsweise publizierte Konzepte aus. Drohnen setzen sie eher als Mittel zum Zweck ein, ohne vorsätzlich ein Ziel zu verfolgen, das die IT-Sicherheit verletzt. Dazu gehört beispielsweise das Ausspähen von WiFi mit dem Versuch, in diese Netzwerke einzudringen.

Auch Cyberaktivist*innen setzen bereits vermehrt Drohnen ein. Diese Personengruppe agiert eher einzeln als organisiert und verfolgt ein weiterführendes, in der Regel übergeordnetes Ziel. Dabei werden bekannte Techniken und Schwachstellen kombiniert und weiterentwickelt. Es bestehen finanzielle Grenzen, die aber deutlich höher sind als die der Skriptkiddies. Zudem besteht in dieser Kategorie von Angreifenden ein umfangreicheres Wissen, etwa darüber, wie man Drohnen selbst baut oder so umbaut, dass sie sich optimal für den geplanten Angriff eignen.

So können Überwachungen im optischen oder Infrarotbereich für Social-Engineering-Angriffe durchgeführt oder auch optische und Laser- oder Radarscans von Liegenschaften zur Schwachstellenanalyse durchgeführt werden. Zudem können zusätzliche WiFi-Accesspoints als Man-in-the-Middle abgesetzt werden, um so Datenverkehr mitzuhören, abzufangen oder sogar im Namen des Absenders zu manipulieren. Aktivistische Gruppen verfolgen damit oft das Ziel, Daten und Informationen zu stehlen und für die aktivistischen Zwecke als Druckmittel einzusetzen. Eher selten besteht die Absicht, sich monetär zu bereichern.

Im Gegensatz zu Cyberaktivist*innen verfügen Cyberkriminelle, eine weitere Gruppe, die vom Einsatz von Drohnen profitieren kann, zusätzlich über große finanzielle Mittel, sodass ihre Angriffe nicht an materiellen Grenzen scheitern. Diese Gruppe ist in der Lage, sich zahlreiche Drohnen mit unterschiedlichen Eigenschaften und Nutzlasten zu beschaffen und diese in Mehrpilotensystemen für komplexe Aufgaben und Manöver zu steuern. Allerdings steht für Wirtschaftskriminelle der Return on Invest im Vordergrund. Somit sind bei den meisten Angriffen das Ausspähen und Stehlen von Daten, das Vorbereiten von physischen Einbrüchen, Cyberspionage und Erpressung zu erwarten.

Im Auftrag von Regierungen und Staaten

Eine besonders schwer zu greifende Gruppe sind die State Actors, also Angreifende, die im Auftrag von Regierungen und Staaten agieren. Sie nutzen ähnliche Mittel wie Cyberkriminelle, handeln jedoch eher nicht aus finanziellen Interessen. Für sie gilt, andere Gesellschafts- und Wirtschaftssysteme zu destabilisieren. Dabei sind Umfang und Art der eingesetzten Mittel von untergeordneter Bedeutung, wenn der Zweck sie aus Sicht der Handelnden rechtfertigt.

State Actors geht es bei Cyberangriffen durch Drohnen oft eher um nachrichtendienstliche Analysen: Längerfristiges Mitschneiden verschlüsselter Kommunikation über WiFi, sogenanntes IMSI-Scanning der SIM-Karten von Mobiltelefonen an verschiedenen Orten, um Bewegungsmuster und sogar Wohnorte von Personen zu bestimmen, oder der Einsatz von höchstauflösenden Kameras und Richtmikrofonen, um Bildschirme und Gespräche auszuspähen: eine ausgezeichnete Grundlage, um weitere Cyberoperationen zu starten.

Schnellere und gezieltere Angriffe möglich

Welche Gruppe sie auch einsetzt: Fest steht, dass Cyberangriffe durch Drohnen an Komplexität gewinnen. Etablierte Abwehrmaßnahmen wie ein Zaun oder eine Mauer lassen sich damit mühelos überwinden, der physische Angriffsraum wird erweitert und die Geschwindigkeit, in der Angriffe ausgeführt werden, erhöht sich. Für Firmen bedeutet das, dass die Absicherung ihres Geländes auch den Luftraum und womöglich das Umfeld miteinbeziehen muss.

Darüber hinaus ermöglicht die hohe Geschwindigkeit einer Drohne Cyberangriffe auf Orte und Räume, an denen man sich bisher in relativer Sicherheit wiegen konnte. Beispielsweise werden dadurch Angriffe auf WiFi-Systeme in einem vermeintlich physisch sicher abgegrenzten Raum möglich, indem in einem einzigen, schnellen Überflug Netzwerke, Authentifikationsverfahren oder Bluetoothgeräte lokalisiert und mitgeschnitten werden, um Sicherheitslücken zu finden.

Aus diesen Überlegungen lässt sich der Charakter der zu erwartenden Cyberangriffe ableiten: Die hohe Mobilität, die geringe Größe sowie die Möglichkeit zum Transport leichter Nutzlasten prädestiniert Drohnen dafür, Angriffe vorzubereiten und durchzuführen.

Methoden der Angriffe

Methoden, die dabei mittlerweile bekannt sind, sind etwa das Erstellen von (3D-)Geländeplänen oder das Ausspähen von vorhandenen und angefragten drahtlosen Netzwerken sowie von Bluetooth-Verbindungen, insbesondere zu Druckern und anderen schlecht gesicherten Geräten des Internet of Things.

Auch das Scannen von Netzwerken über ungesicherte Zugangspunkte oder das Ausstrahlen eines Netzwerks und Accesspoints wird durch Drohnen sehr viel einfacher. Zudem ermöglichen sie es, den Funkverkehr drahtloser Mäuse und Tastaturen mitzuschneiden sowie Personen, Dokumente und Bildschirme zu fotografieren oder zu filmen.

Die zu erwartenden Angriffe zeichnen sich also durch eine Mischung aus unerwarteter Nähe, Höhe, Position und Geschwindigkeit aus. Die konkreten Angriffsvektoren sind dabei vielfältig: von Social Engineering über Man-in-the-Middle-Angriffe, um Netzwerke zu kompromittieren, bis hin zum Ausnutzen bekannter Sicherheitslücken durch spezialisierte Tools.

Podcast thematisiert Drohnenangriffe und deren Abwehr

Eine gute Verteidigung gibt es leider nicht. In unserer mehrteiligen Podcast-Serie haben wir uns mit dem Thema auseinandergesetzt und herausgearbeitet, dass der beste Schutz darin besteht, über präventive Angriffe wie Red-Teaming und Pentesting herauszufinden, wo Schwachstellen gegenüber Drohnen bestehen. Und darin, sich beim Schutz von IT, Ressourcen und Gelände nicht auf die physische Unerreichbarkeit zu verlassen. Drohnenangriffe zu erkennen und abzuwehren, ist aufgrund der geringen Größe und hohen Geschwindigkeit oft ein aussichtsloses Unterfangen.

Selbstverteidigungsmaßnahmen wie Zerstörung, Hacking oder Abschuss lassen sich juristisch – wenn überhaupt – nur für den konkreten Einzelfall abschätzen. Grundsätzlich müsste die Polizei informiert werden und eingreifen. Dafür laufen Drohnenangriffe aber zu schnell ab. Zudem verfügt die Polizei selbst kaum über wirksame Maßnahmen.

Drohnen, Cybersecurity und Recht

In dieser Folge spricht Volker Skwarek mit David Klein, Fachanwalt für Informationsrecht und Salary Partner der Kanzlei Taylor Wessing. Das Gespräch dreht sich um Auswirkungen, Gefahren und rechtliche Beurteilungen rund um Cybersicherheit und Drohnen. Im Anschluss ordnen Monina Schwarz und Ingo Timm das Interview ein.

Daher bleibt die Empfehlung, Drohnen in der Bewertung des Cyberrisikos zu berücksichtigen und ausreichende Präventivmaßnahmen zu ergreifen – beispielsweise auch durch die Lage kritischer Räume, die Orientierung von Schreibtischen und Monitoren zu Fenstern oder Handlungsempfehlungen an die Mitarbeitenden im Fall einer Drohnensichtung.

Die Sicherheits_lücke

… ist ein Podcast der Hamburg Open Online University (HOOU), der IT-Sicherheit greifbar macht und fundierte Inhalte mit unterhaltsamen Gesprächen verbindet. Prof. Dr. Volker Skwarek (HAW Hamburg) spricht gemeinsam mit Monina Schwarz (Landesamt für Sicherheit in der Informationstechnik Bayern) und Prof. Dr. Ingo Timm (Deutsches Forschungszentrum für Künstliche Intelligenz und Universität Trier) über aktuelle Risiken, technologische Trends und gesellschaftliche Herausforderungen. Die Illustrationen und das Design des Podcasts wurden gestaltet von Anne Vogt.

https://www.sicherheitsluecke.fm

Über den Autor

Volker Skwarek ist seit 2014 Professor für Technische Informatik an der HAW Hamburg und leitet das Forschungs- und Transferzentrum CyberSec. Dort forschen er und seine wissenschaftlichen Mitarbeiter an Methoden der Kodierung von Identitäten, Netzwerkabsicherung, Access-Control-Mechanismen insbesondere für Anwendungen der kritischen Infrastruktur. Bei der Gesellschaft für Informatik engagiert er sich als stellvertretender Sprecher der Fachgruppe Netzwerksicherheit (NetSec) und organisiert die Konferenz GI Sicherheit 2026 in Hamburg. Sein Text ist in Zusammenarbeit mit Monina Schwarz, Ingo Timm sowie Christian Friedrich entstanden, mit denen er seit Januar 2025 den Podcast „Die Sicherheits_lücke“ produziert. Dort wurde das Thema auch in mehreren Episoden aufgegriffen.

Dieser Beitrag ist im Mitgliedermagazin der Gesellschaft für Informatik e.V. – „Das Informatik-Magazin“ – erschienen.

Bild: Ivan Samkov / pexels.com

07.05.2026 | Meena Stavesand

KI trifft Klassenzimmer: Wie Lehrkräfte lernen, künstliche Intelligenz sinnvoll einzusetzen

Wie verändert KI die Bildung – nicht nur im Klassenzimmer, sondern schon in der Ausbildung der Lehrkräfte? Wir haben mit Johannes Schäfers von der TU Hamburg gesprochen. Er ist Experte für berufliche Bildung und entwickelte für die HOOU gemeinsam mit Prof. Dr. Maren Baumhauer und Stephanie Wichmann das Lernangebot „KOM.KI“, mit dem sich etwa Lehramtsstudierende auf den reflektierten Einsatz von KI vorbereiten können. Im Interview spricht er über Chancen, Stolpersteine – und darüber, warum man sich ruhig trauen darf, einfach mal mit KI loszulegen.

Wann bist du mit KI in Berührung gekommen?

Johannes Schäfers: Mein erster Berührungspunkt mit KI war tatsächlich Ende 2022, Anfang 2023, als die ersten Chatbots für die breite Gesellschaft wie z. B. ChatGPT aufkamen. Das war schon beeindruckend, was da plötzlich möglich war.

Wie nutzt du KI heute in deiner Arbeit an der TU Hamburg?

Johannes Schäfers: Inzwischen fast täglich. An der TU Hamburg haben wir einen eigenen Chatbot namens TUKI, die auch auf ChatGPT basiert. Die ist mit unserer Infrastruktur verknüpft. Das macht es besonders praktisch.

Ich nutze aber auch verschiedene KI-Tools fürs Brainstorming, zum Strukturieren von Inhalten und für Bildgenerierung – zum Beispiel für Präsentationen oder für die Lehre allgemein. KI hilft mir teilweise bei administrativen Aufgaben, um Prozesse effizienter zu gestalten. Es spart einfach Zeit und gibt Raum für Kreativität.

Wenn du an Schule und Bildung denkst – wo siehst du die größten Potenziale von KI? Für Lehrkräfte und für Schüler:innen?

Johannes Schäfers: Für Lehrkräfte sehe ich unter anderem riesiges Potenzial in der Analyse und Begleitung von Lernprozessen – also dabei, besser zu verstehen, wo die Schüler:innen gerade stehen – das nennt sich Learning Analytics.

Für Schüler:innen wiederum ist KI super, um sich Inhalte einfacher aufbereiten zu lassen: Zusammenfassungen, Gliederungen, einfache Erklärungen oder auch Bildmaterial. Das erleichtert vieles.

Aber: Es ist wichtig, diese Tools aber auch kritisch zu betrachten. Man muss lernen, die Ergebnisse zu hinterfragen. Ist das korrekt, was die KI da ausspuckt? Wie kann ich die Ergebnisse möglicherweise weiter überprüfen? Ergibt das Sinn? Diese Reflexion sollte immer dazu gehören.

Learning Analytics bezeichnet die systematische Auswertung von Lerndaten der Schüler:innen. Es geht darum, Lernstände zu analysieren, Abweichungen frühzeitig zu erkennen und individuelle Lernpfade aufzuzeigen. Beispielsweise kann ein KI-gestütztes System zeigen, wenn die Leistung eines Schülers oder einer Schülerin plötzlich abfällt – vielleicht durch persönliche Probleme oder Lernschwierigkeiten. Lehrkräfte können so gezielter unterstützen. Auch adaptive Lernpfade sind möglich: Wer Schwierigkeiten hat, bekommt kleinere, passende Aufgabenpakete – bis das große Ganze bewältigt werden kann. Das Ziel: mehr (und schnellere) individuelle Förderung.

Ich musste mir damals im Studium alle Inhalte mühsam zusammensuchen – heute fragt man ein Tool. Geht da nicht auch etwas verloren?

Johannes Schäfers: Natürlich kann man sagen: Die Tools nehmen einem einiges an Arbeit ab. Aber man muss auch dazu befähigt werden, sie überhaupt sinnvoll einsetzen zu können. Und genau da sehe ich unsere Aufgabe – in der Ausbildung der angehenden Lehrkräfte. Es geht nicht nur um die bloße Anwendung, sondern um eine ganzheitliche Kompetenzentwicklung im Umgang mit KI-Tools.

Und klar ist doch: Jede Generation hatte ihre Tools. Wir hatten in den 2000ern plötzlich Computer. Vor knapp 50 Jahren gab’s das alles noch nicht. Es geht nicht darum, ob man Technik nutzt – sondern wie.

Welche Kompetenzen sind dir dabei besonders wichtig?

Johannes Schäfers: Neben dem technischen Verständnis sind mir ethische, gesellschaftliche und auch ökologische Aspekte extrem wichtig. Aspekte der Diskriminierung, des Datenschutzes aber auch der Energieverbrauch von Servern – das gehört alles dazu. Ich versuche, meinen Studierenden genau diese Perspektiven mitzugeben: Es geht nicht nur um die Technik, sondern darum, wie wir verantwortungsvoll mit ihr umgehen.

Ihr habt ein Lernangebote zum Umgang mit KI erstellt. Es geht um die Entwicklung von KI-Kompetenzen. Was sind eure Erkenntnisse bisher?

Johannes Schäfers: Was mich total begeistert: Die Studierenden in unseren Seminaren kommen mit vielen eigenen Ideen. Sie entwickeln Projekte, erproben KI in Lehrveranstaltungen und profitieren auch selbst ganz konkret. Auch leistungsschwächere Studierende sehe ich durch KI gezielt unterstützt – etwa bei der Rechtschreibung oder bei der Gliederung von Texten. Das stärkt das Selbstbewusstsein und führt oft zu besseren Ergebnissen.

Aber das funktioniert natürlich nur, wenn die Studierenden auch wissen, wie man mit KI sinnvoll umgeht. Und genau das versuchen wir zu fördern – Schritt für Schritt, ohne Überforderung, mit den Lernangeboten unseres Projekts „Kom.KI“.

Worum geht’s da genau?

Johannes Schäfers: Wir haben zwei Formate entwickelt: den „Short Track“ für Einsteiger:innen, der sich am 4-A-Modell von Prof. Dr. Doris Weßels orientiert – also Aufklären, Ausprobieren, Akzeptieren, Aktiv werden. Wir haben das Ganze um ein fünftes A ergänzt: Anlässe schaffen. Denn oft fehlt in Schulen genau das – der konkrete Anlass, um KI sinnvoll z. B. im Unterricht einzusetzen.

Dann gibt es noch den „Deep Track“ für Fortgeschrittene. Dieser vertieft das Thema – mit konkreten Beispielprojekten, die unsere Studierenden gemeinsam mit Lehrkräften unter anderem aus Hamburger beruflichen Schulen entwickelt haben. Die Ergebnisse wurden hierbei in Form von Postern aufbereitet und sind auf unserer über unsere Lernangebote öffentlich zugänglich.

Kom.KI - Kompetenzentwicklung für KI-Tools

Künstliche Intelligenz (KI) spielt für viele Bereiche unseres Lebens bereits eine wichtige Rolle. Dies zeigt sich durch die intensive Nutzung von generativer KI, zum Beispiel in Form von Textgenerierung oder verschiedenen kreativen Prozessen wie Bilderstellung, Musikkomposition oder Videoproduktion. Die Veränderungen, die KI mit sich bringt, wirken sich aber auch unmittelbar auf unsere persönliche und berufliche Bildung aus. Diese Zusammenhänge möchten wir dir gerne hier in diesem Lernmodul vermitteln. Dafür haben zahlreiche Studentinnenund Studenten in Kooperation mit beruflichen Schulen Konzepte entwickelt, wie Künstliche Intelligenz für verschiedene Akteure zum Vorteil werden kann.

Wie gut kennen sich die Studierenden mit KI aus? Gibt es da Unterschiede?

Johannes Schäfers: Ja, definitiv. Manche sind sehr Technik-affin, andere tun sich schwerer – es gibt große Unterschiede. Dazu kommen die unterschiedlichen Vorerfahrungen oder auch ungleichen Zugänge zu kostenpflichtigen Tools – das sind alles reale Stolpersteine, denen wir begegnen.

Ich bin zwar ein Fan von „einfach mal ausprobieren“, also „trial and error“, aber wir brauchen trotzdem einen begleiteten Einstieg. Nur so können die Studierenden lernen, worauf es ankommt – nicht nur technisch, sondern auch inhaltlich und praktisch damit zu arbeiten sowie ihr Erlerntes zu reflektieren.

Ihr seid auch bei der KI-Werkstatt der HOOU. Was zeigt ihr dort?

Johannes Schäfers: Bei der KI-Werkstatt stellen wir beide Lernformate vor – und damit auch die Projektergebnisse unserer Studierenden. Uns geht’s darum, andere Lehrkräfte zu inspirieren: Schaut, was möglich ist! Findet Anlässe in eurem eigenen Schulalltag. Probiert Dinge aus, auch wenn ihr noch keine Expert:innen seid.

Denn genau das ist der erste Schritt: ins Handeln kommen. Nicht nur verstehen, sondern machen.

Wenn du an die Zukunft des Lernens denkst – welche Rolle spielt KI dabei?

Johannes Schäfers: Ich glaube KI wird nicht wieder verschwinden. Sie ist schon jetzt Teil unseres Alltags, besonders im Bildungsbereich. Und ich sehe das nicht als Problem, sondern als großartige Chance. Wichtig ist, dass wir lernen, damit umzugehen – kritisch, reflektiert und verantwortungsvoll.

Natürlich gibt es auch Risiken: KI kann halluzinieren, also falsche Informationen ausgeben. Aber wenn wir lernen damit umzugehen, können wir viel gewinnen. Studien zeigen schon jetzt: Wer mit KI arbeitet, kann manche Aufgaben schneller und besser erledigen – gerade im Bereich allgemeiner Schreibaufgaben. Die Qualität steigt, der Zeitaufwand sinkt. Das finde ich ist ein starkes Argument.

Aber: Es braucht Interesse, Neugier und die Bereitschaft, sich mit diesen Technologien auseinanderzusetzen. Nur dann kann man das Potenzial wirklich nutzen.

Über Johannes Schäfers

Johannes Schäfers M. Ed. ist seit Mai 2023 wissenschaftlicher Mitarbeiter am Institut für Berufliche Bildung und Digitalisierung an der Technischen Universität Hamburg. Zuvor war er in der Zeit von Juni 2020 bis April 2023 über das BMBF-geförderte Projekt „Leibniz works 4.0“ im Rahmen der Qualitätsoffensive Lehrerbildung als wissenschaftlicher Mitarbeiter am Institut für Berufspädagogik und Erwachsenenbildung an der Leibniz Universität Hannover beschäftigt. Sein Arbeits- und Forschungsschwerpunkt liegt in der Entwicklung und Evaluation von digitalen Lernumgebungen und der Erfassung und Förderung digitalisierungsbezogener Kompetenzen von Lehrkräften in der beruflichen Bildung.

Headerbild: AbsolutVision/Unsplash

14.04.2026 | Meena Stavesand

Ideen als Problemlöser: Gemeinsam kreative Lösungen schaffen

Ideen hat jeder Mensch, und Kreativität kann man lernen. Davon ist Jan Küchenhof von der TU Hamburg überzeugt. Mit seinem Lernangebot „Collaborative Ideation“ zeigt er, wie wir gemeinsam für komplexe und gesellschaftlich relevante Probleme Ideen finden und entwickeln können. Das geht am besten in einem diversen Team. Im Interview erklärt Jan Küchenhof, was eine Idee eigentlich ist, wie Ideen entstehen und welche Rolle die eigene Kreativität bei dem Ideenfindungsprozess spielt.

Wer Lust hat, dies einmal auszuprobieren, hat bald die Möglichkeit: bei der Zukunftswerkstatt für die Mobilität von morgen. In vier interaktiven Zoom-Sessions könnt ihr eure Sichtweise zu aktuellen Herausforderungen in Hamburg einbringen und gemeinsam neue Konzepte entwerfen. Mehr dazu gibt es am Ende des Interviews.

Was ist eigentlich eine Idee?

Jan Küchenhof: Für mich ist eine Idee dieser Aha-Moment, den vermutlich jeder von uns kennt. Es macht klick bei uns im Kopf, der Schalter wird umgelegt und es offenbart sich eine potentielle Lösung. Eine Idee kann auch die Antwort auf eine Frage sein, über die wir uns schon länger den Kopf zerbrechen. Häufig muss man ein Problem etwas inkubieren, also etwas länger mit sich herumtragen bis man auf eine Lösung kommt. Eine Idee ist dann ein Problemlöser. Das heißt aber nicht, dass eine Idee immer etwas Neues sein muss – anders als bei einer Invention, also einer Erfindung.

Wie entstehen Ideen?

Jan Küchenhof: Ideen können auf unterschiedliche Arten und Weisen entstehen – bei denkenden Lebewesen sind sie das Resultat kognitiver Prozesse und können sich im Unterbewusstsein entwickeln, allerdings auch gezielt herbeigeführt werden. Klar ist: Jeder Mensch hat Ideen. Meist braucht es ein Problem, das wir zunächst verstehen und dann lösen wollen, damit wir Ideen erkennen. Dieser Prozess kann unterstützt werden – zum einen mit intuitiven Methoden wie etwa Brainstorming, die unsere Kreativität anregen, oder zum anderen mit diskursiven Methoden, die unser systematisches Denken anstoßen. Das Problem, das es zu lösen gilt, wird dann Schritt für Schritt analysiert und durchdrungen, um am Ende passende Ideen für die Problemlösung zu erhalten.

Collaborative Ideation: Gemeinsam Ideen entwickeln

Wie können dezentrale Teams bei der kollaborativen Ideenentwicklung zur gemeinsamen Lösungfindung komplexer Problemstellungen unterstützt werden?

Welche Rolle spielt die eigene Kreativität bei Ideen und kann ich Kreativität lernen?

Jan Küchenhof: Früher wurde oft angenommen, dass Kreativität eine besondere Fähigkeit ist, die einige Menschen besitzen und andere nicht. Daher haben sich manche selbst schnell als unkreativ abgestempelt und das Entwickeln von Ideen den „Kreativen“ überlassen. Es ist vermutlich auch so, dass einige Menschen einfach kreativer sind als andere – jedoch gibt es mehrere Formen von Kreativität und Expert:innen erkennen zunehmend, dass kreatives Denken zu den grundlegenden kognitiven Fähigkeiten gehört, die jeder besitzt. Wir alle werden bei der Geburt mit einer individuellen natürlichen Kreativität ausgestattet. In Kombination mit dem uns verfügbare Wissen steigt unsere verfügbare Kreativität und damit auch die kreative Leistung. Die kreative Leistung kann außerdem durch gezielten Wissenserwerb oder durch Kreativitätstechniken erhöht werden. Der Unterschied zwischen Menschen, die als kreativ und als nicht-kreativ gelten, liegt meist nur darin, wie aktiv sie diese Fertigkeiten nutzen. Daraus folgt: jeder kann seine kreatives Denken stärken und verbessern.

Wie entwickelt man seine Idee weiter?

Jan Küchenhof: Wenn man eine gute Idee gefunden hat, kann man versuchen, sie in die Tat umzusetzen. Natürlich kann nicht jede Idee realisiert werden – schon gar nicht sofort. Manchmal lohnt es sich auch, eine Idee erst einmal weiter zu durchdenken, zu entwickeln, bevor man in die Umsetzung geht. Mit Methoden wie Design Thinking haben wir heute die Möglichkeit, durchdachte Ideen zügig in Prototypen zu verwandeln und sie dann zu testen. Meist gibt es mehr als eine Lösung – daher ist eine gute Abwägung bei Ideen und deren Umsetzung wichtig. Hierbei spielen verschiedene Aspekte eine Rolle wie Aufwand, Umsetzbarkeit, Nutzen und auch die Frage: Welche Alternativen es gibt? Besonders hilfreich ist bei diesem Ideenfindungsprozess ein vielfältiges Team und ein geleiteter Prozess, damit sich komplexe Probleme leichter lösen lassen.

Wie kommen wir an Ideen für sehr komplexe und gesellschaftsübergreifende Probleme?

Jan Küchenhof: Genau diese Frage haben wir uns an der TU Hamburg ebenfalls gestellt – und eine Lösung dafür gefunden. In dem HOOU-Lernangebot „Collaborative Ideation“ haben wir uns auf Probleme konzentriert, die eine hohe gesellschaftliche Relevanz haben, da sie alle Menschen betreffen, aber nicht von Einzelnen gelöst werden können. Im Team ist das verfügbare Wissen höher und der Austausch kann die Motivation stärker anregen als alleine im stillen Kämmerchen an neuen Ideen zu arbeiten. Außerdem kann man die Ideen dann mit den unterschiedlichen Sichtweisen und Erfahrungen der Gruppe diskutieren.

So haben wir uns ein sehr relevantes Thema gesetzt: „Plastikmüll in Stadt und Umwelt“. Zunächst haben wir die Probleme dieses Themas identifiziert und kategorisiert. Wir konnten festlegen, dass es Probleme gibt, die jeder Menschen angehen kann – etwa beim Einkauf den Jutebeutel zu nehmen statt die Plastiktüte. Andere Probleme wie Industrieabfälle, die etwa von Unternehmen in Gewässer geleitet werden, sind nicht von einer Einzelperson zu lösen und erfordern mehr als individuelle Maßnahmen. Hier kann zum Beispiel die Politik mit entsprechenden Regulierungen eingreifen.

Im weiteren Prozess stießen wir auf das Thema Mikroplastik – ein Problem, das weit über die Reichweite von Einzelpersonen, Unternehmen und auch Politik hinausgeht. Mikroplastik ist mittlerweile überall in unseren Ökosystemen verbreitet: in Böden, Gewässern, der Nahrungskette und sogar in uns selbst, was unter anderem zu erhöhtem Artensterben beiträgt. Um hier eine Wirkung zu erzielen, müssen umfassende Maßnahmen und Mechanismen aktiviert werden.

Nachdem wir die Probleme sortiert hatten, wählten wir diejenigen aus, die wir als lösbar ansahen. In einem weiteren Workshop widmeten wir uns dann der Lösungsfindung. Wir sammelten Ideen, wie die Probleme angegangen werden könnten, wählten die besten aus und ließen sie im 5-Minuten-Takt von Team zu Team wandern. Auf diese Weise konnten die Vorschläge verfeinert werden. Jetzt sind die Ideen ausgereift und bereit zur Umsetzung – und genau das macht sie wahrhaft kreativ.

Lernangebot Collaborative Ideation als kostenloser Moodle-Kurs

Das HOOU-Projekt „Collaborative Ideation: Design Methods going Digital!“ wurde bereits 2021 gefördert und realisiert und geht nun in die zweite Runde. Mit dem Umzug auf die neue Moodle-Plattform wird das Lernangebot interaktiver und bietet digitale Möglichkeiten zum Mitmachen und Nachmachen. Wer mehr darüber wissen möchte, wie man gemeinsam an komplexe Probleme herangeht und kreative Lösungen entwickelt, für den ist unser Lernangebot „Collaborative Ideation“ genau das Richtige. Realisiert wird es von Jan Küchenhof vom Institut für Produktentwicklung und Produktentwicklung (PKT) der TU Hamburg und fleißiger studentischer Unterstützung. Das neue Lehr- und Lernprojekt soll ab Januar 2024 online verfügbar sein.

Jetzt anmelden! Zukunftswerkstatt für die Mobilität von morgen

Wie bewegen wir uns morgen durch Hamburg? Effizient, klimafreundlich und für alle zugänglich? Die Welt verändert sich ständig – und die Ideen von heute gestalten die Realität von morgen. In unserer Zukunftswerkstatt für die Mobilität von morgen möchten wir gemeinsam mit euch neue Perspektiven auf urbane Mobilität entwickeln.

In vier interaktiven Zoom-Sessions könnt ihr eure Sichtweise zu aktuellen Herausforderungen in Hamburg einbringen und gemeinsam neue Konzepte entwerfen. Methodisch begleitend erkunden wir im HOOU-Kurs „Collaborative Ideation“ die gemeinsamen Ideenentwicklung.

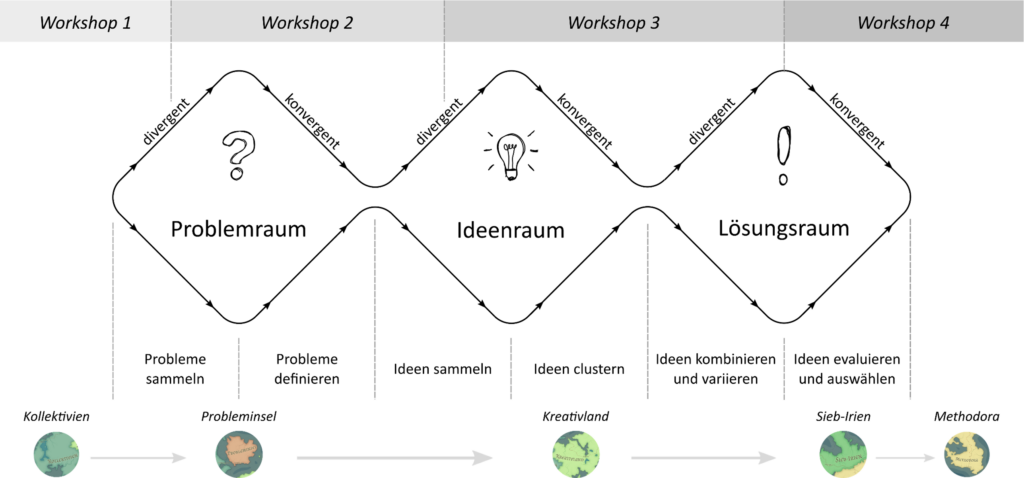

Unsere kreative Reise führt euch durch verschiedene Stationen:

Workshop 1 – Kennenlernen in Kollektivien

30.04. | 16:30–18:30 Uhr

Workshop 2 – Überfahrt auf die Problemsinsel

21.05. | 16:30–18:30 Uhr

Workshop 3 – Lösungssuche im Kreativland

11.06. | 16:30–18:30 Uhr

Workshop 4 – Die Eishöhlen Sieb-Iriens

02.07. | 16:30–18:30 Uhr

Ihr könnt auch schon vorab in unseren HOOU-Kurs „Collaborative Ideation: Gemeinsam Ideen entwickeln“ hineinschauen:

https://learn.hoou.de/blocks/course_overview_page/course.php?id=483

Anmeldung

Wenn ihr teilnehmen möchtet, meldet euch bitte bis zum 25.04. per E-Mail an: jan.kuechenhof@gmail.com

Wir freuen uns auf eure Ideen und darauf, gemeinsam an einer spannenden Zukunft der Mobilität zu arbeiten!

Annerkennungsmöglichkeiten

A) Teilnehmerbescheid über das Lernangebot “Collaborative Ideation”: https://learn.hoou.de/blocks/course_overview_page/course.php?id=483

B) Für Studierende: 3 ETCS über den SDG-Campus (https://sdg-campus.de/)

Bild: sasint / Pixabay

24.01.2025 | Meena Stavesand

Wissen als Schlüssel: Wie lebenslanges Lernen unsere Welt verändert

Der demografische Wandel stellt unsere Gesellschaft vor große Herausforderungen. Angesichts einer alternden Bevölkerung, einer immer vielfältiger werdenden Gesellschaft und der rasanten Veränderungen in der Arbeitswelt gewinnt das Konzept des lebenslangen Lernens zunehmend an Bedeutung. Anlässlich des internationalen Welttages der Bildung (24. Januar) zeigen wir, wie wir, die Hamburg Open Online University als Wissensplattform, auch den gesellschaftlichen Zusammenhalt fördern.

Für uns spielt lebenslanges Lernen eine Schlüsselrolle bei der Integration verschiedener Bevölkerungsgruppen, bei der Sicherung von Arbeitsplätzen in Zeiten des technologischen Wandels und bei der Förderung des Zusammenhalts zwischen Jung und Alt.

In einer Welt, in der sich Berufe und Qualifikationen ständig verändern, müssen Menschen bereit sein, ihr Wissen stetig zu erweitern. Um das zu ermöglichen und zu fördern, braucht es faktenbasierte und qualitativ wie didaktisch erstklassige Bildungsangebote für alle. Der Zugang dazu muss niederschwellig und barrierearm sein.

Unterstützung für Menschen in jeder Lebensphase

Plattformen wie die HOOU als Verbundeinrichtung der Freien und Hansestadt Hamburg, der Hamburger Hochschulen (HAW Hamburg, TU Hamburg, Hochschule für Musik und Theater, Hochschule für Bildende Künste), der Multimedia Kontor Hamburg gGmbH und des Universitätsklinikums Hamburg-Eppendorf arbeiten daran und unterstützen Menschen in jeder Lebensphase mit ihren fundierten Wissensangeboten. Drei Gedanken dazu.

1. Fit für die Zukunft: Warum lebenslanges Lernen in der Arbeitswelt unverzichtbar ist

In einer alternden Gesellschaft, in der die Menschen länger im Erwerbsleben stehen, wird lebenslanges Lernen zu einer zentralen Voraussetzung, um berufliche Chancen zu sichern und den technologischen Wandel zu bewältigen. Dies gilt insbesondere für ältere Arbeitnehmerinnen und Arbeitnehmer, die sich an neue Anforderungen anpassen müssen, um auf dem Arbeitsmarkt konkurrenzfähig zu bleiben.

Wir bieten als Plattform kostenlose, flexible und niederschwellige Weiterbildungsmöglichkeiten, die es Menschen (auch im Alter) ermöglichen, neue berufliche Kompetenzen zu erwerben. Durch die flexiblen Online-Formate können Interessierte die Lerninhalte auch mit begrenztem Zeitbudget – ob berufstätig oder in der Familienphase – nutzen.

Dies dient nicht nur der individuellen beruflichen Entwicklung, sondern wirkt auch dem durch den demografischen Wandel verschärften Fachkräftemangel entgegen.

2. Bildung für alle Lebensphasen: Persönliche Entwicklung durch lebenslanges Lernen

Lebenslanges Lernen unterstützt die persönliche Entwicklung in allen Lebensphasen – von der Jugend bis ins hohe Alter. Es ermöglicht jungen Menschen, ihre Bildung über die traditionellen schulischen und universitären Bildungswege hinaus zu erweitern, und älteren Menschen, neuen Interessen nachzugehen oder vorhandene Fähigkeiten auszubauen.

Gerade vor dem Hintergrund des demografischen Wandels ist dies wichtig, da der Dialog zwischen den Generationen und der gegenseitige Wissenstransfer gestärkt werden. Wir fördern diesen generationsübergreifenden Austausch, indem wir Menschen den Zugang zu hochwertiger Bildung ermöglichen.

3. KI und Automatisierung: Warum technologische Bildung jetzt wichtig ist

Mit dem technologischen Wandel durch künstliche Intelligenz (KI) und Automatisierung sind viele Berufe im Umbruch. Dies betrifft sowohl junge Menschen, die in eine sich wandelnde Arbeitswelt eintreten, als auch ältere Arbeitnehmerinnen und Arbeitnehmern, die sich an diese Veränderungen anpassen müssen. Wir bieten daher Lerninhalte, die Menschen jeden Alters darauf vorbereiten, die neuen technologischen Anforderungen zu bewältigen.

Für Jugendliche und junge Erwachsene ist es wichtig, sich frühzeitig auf die digitale Zukunft vorzubereiten, während ältere Erwachsene durch die Plattform die Möglichkeit haben, sich neue berufliche Fähigkeiten anzueignen und ihre Karrierechancen zu sichern.

Fazit: Lebenslanges Lernen für eine erfolgreiche Zukunft im demografischen Wandel

Diese drei Gedanken zeigen, dass lebenslanges Lernen mehr ist als persönliche Entwicklung. Es ist ein gesellschaftlicher Auftrag vor dem Hintergrund des demografischen Wandels. Eine alternde Bevölkerung, zunehmende Diversität und technologische Umbrüche machen es erforderlich, dass Menschen ihre Kompetenzen kontinuierlich erweitern und sich an neue Herausforderungen anpassen.

Bildungsplattformen wie wir bieten die notwendige Infrastruktur, um diesen Wandel erfolgreich zu gestalten. Wir ermöglichen den Zugang zu Bildung für alle Altersgruppen, fördern den Austausch zwischen den Generationen und stärken den gesellschaftlichen Zusammenhalt.

Nur durch eine breite Verankerung des lebenslangen Lernens kann eine zukunftsfähige Gesellschaft entstehen, die Jung und Alt in den Transformationsprozess integriert und eine gerechtere und nachhaltigere Zukunft sichert.

Das könnte dich interessieren:

30.10.2024 | Meena Stavesand

Entdecke deine digitale Superkraft: Der Insider-Guide zu KI-Tools

Stell dir vor, du könntest morgen aufwachen und plötzlich all die KI-Tools beherrschen, von denen alle um dich herum sprechen. Keine komplizierten Handbücher, keine kryptischen Anleitungen – stattdessen ein Weg, der so entspannt ist wie ein Gespräch mit einer guten Freundin. Genau das haben wir für dich entwickelt. Mit unserer KI-Moderatorin Luca, unsere niederschwelligen Texten und unseren kurzweiligen Erklärvideos tauchst du in eine Welt ein, in der Bildbearbeitung, Textgestaltung und Videokreation kein Mysterium mehr sind. Sie werden deine neuen Alltagstools. Wir zeigen dir nicht nur das Was und Wie, sondern vor allem das Warum und Wofür.

Künstliche Intelligenz revolutioniert die Art, wie wir arbeiten, kommunizieren und unsere Kreativität entfalten. Zwischen spektakulären Schlagzeilen und komplizierten Fachbegriffen fehlt dabei oft das Wichtigste: Ein verständlicher Zugang, der zeigt, wie diese Tools der generativen KI dein Leben tatsächlich bereichern können.

Gerade jetzt, wo KI-Technologien immer ausgereifter werden, ist es wichtiger denn je, sich mit den Möglichkeiten vertraut zu machen – nicht als passive:r Beobachter:in, sondern als aktive:r Gestalter:in dieser digitalen Revolution.

Technologie (be)greifbar machen

In unserem digitalen Lernangebot „KI-Tools kurz erklärt: So verwendest du ChatGPT, Leonardo.AI & Co.“ des Multimedia Kontor Hamburg und der TU Hamburg haben wir die spannendsten und nützlichsten KI-Tools für dich unter die Lupe genommen. Das Ergebnis: Ein kostenloser Online-Kurs, der Technologie (be)greifbar macht.

Deine Begleiterin durch dieses Abenteuer ist unsere KI-generierte Moderatorin Luca. Sie ist selbst ein faszinierendes Beispiel dafür, was mit generativer KI heute möglich ist, und wird dir in unseren Video-Tutorials mit Rat und Tat zur Seite stehen.

Das kannst du von unserem Kurs erwarten

- Deine Routineaufgaben geschickt automatisieren und wertvolle Zeit gewinnen

- Kreative Prozesse beschleunigen und neue Inspirationsquellen erschließen

- Professionelle Ergebnisse erzielen, die sich von der Masse abheben

- Innovative Lösungsansätze entwickeln und selbstbewusst umsetzen

- Technische Barrieren überwinden und deine digitale Kompetenz steigern

Text-KI als Inspirationsquelle

Im Bereich der Text-KI öffnen wir dir die Tür zu einem ganzen Universum an Möglichkeiten. Mit ChatGPT lernst du einen vielseitigen Allrounder kennen, der dir bei unzähligen Aufgaben zur Hand geht – von der ersten Recherche bis zur Textgestaltung. Microsoft Copilot wird zu deinem persönlichen Office-Assistenten und kann deinen Arbeitsalltag erleichtern, während du mit Google Gemini eine der nächsten Generation der Sprach- und Textverarbeitung kennenlernst. Speziell für Marketing-Inhalte zeigen wir dir Neuroflash, ein Tool, das die Feinheiten der Sprache besonders gut beherrscht. Das Besondere: Es ist ein deutsches Start-up!

KI-Tools kurz erklärt! So verwendest du ChatGPT, Leonardo.AI & Co.

Mit dem Lernangebot "KI-Tools kurz erklärt! So verwendest du ChatGPT, Leonardo.AI & Co." möchten wir einen niederschwelligen Zugang zu den gängigsten KI-Tools bereitstellen. Wir möchten Lust machen, die KI-Tools Schritt für Schritt kennenzulernen und sie direkt auszuprobieren und damit zu experimentieren. In verständlicher Sprache behandeln wir KI-Textgeneratoren sowie KI-Bild- und Videogeneratoren, gehen auf rechtliche Fragen ein, liefern Informationen zu Prompting, haben eine Sammlung für tiefergehendes Wissen und bieten ein Dialogforum, damit du dich mit anderen austauschen kannst. Wir erläutern dir die Tools auf zweifache Weise: in leicht verständlichen Texten, die auch Hintergrundinformationen zu der Entwicklung geben, und mit Videos, die die KI-Generatoren in der Anwendung zeigen. So lernst du die Entwicklung, die Funktionen und die Bedienung der Tools in deinem eigenen Tempo kennen und kannst sie Schritt für Schritt erkunden. Begib dich mit uns auf die Reise in dein KI-Abenteuer! 👩🚀

Visuelle Magie: Deine Ideen werden Realität

Die Welt der Bildgenerierung eröffnet dir völlig neue kreative Horizonte. In unseren praxisnahen Tutorials zeigen wir dir:

- wie du mit DALL-E fotorealistische Bilder zauberst, die deinen Vorstellungen entsprechen

- wie Midjourney dir hilft, deinen eigenen künstlerischen Stil zu entwickeln

- wie du Stable Diffusion für deine individuellen Projekte nutzt und anpasst

- wie Leonardo.AI deine Visualisierungen auf ein neues Level hebt.

Besonders spannend: Du lernst die Kunst der Prompts. Wir zeigen dir, wie du durch geschickte Formulierungen und Parameter genau die Bilder erzeugst, die du im Kopf hast. Dabei gehen wir auch auf spannende Techniken ein und modifizieren bestehende Bilder oder arbeiten mit verschiedenen Stilen.

Dein Weg in die KI-Zukunft

Die digitale Transformation ist in vollem Gange. KI-Tools sind dabei der Schlüssel zum Erfolg. In einer Zeit, in der sich Technologien rasant entwickeln, bieten wir dir einen verlässlichen Kompass durch die Welt der künstlichen Intelligenz. Unser Kurs vermittelt dir das nötige Wissen, um diese Entwicklung aktiv mitzugestalten – praxisnah, verständlich und ohne technische Hürden.

Stell deine Fragen in der Lunch Bag Session

Wir möchten dich hautnah informieren und regelmäßig updaten. So veranstalten wir Lunch Bag Sessions zu unserem Lernangebot. Darin informieren wir dich über die neuesten Entwicklungen und Trends in der Welt der KI-Tools.

Du bleibst damit am Puls der Zeit und kannst neue Features und Möglichkeiten direkt für dich nutzen. Unser Ziel ist es, dass du nach dem Kurs und unseren Schulungen nicht nur die Tools beherrschst, sondern auch verstehst, wie du sie kreativ und effizient in deinen Alltag integrierst.

Die nächste Lunch Bag Session zu ChatGPT und DALL-E

Unsere nächste Online-Schulung dreht sich um ChatGPT und DALL-E. Am Mittwoch, 20. November, erläutert Katrin Schröder vom Multimedia Kontor Hamburg von 12 bis 13 Uhr diese KI-Tools und deren vielfältige Anwendungsmöglichkeiten.

Die Schulung via ZOOM richtet sich an alle Interessierten – nicht nur aus dem Hochschulbereich, sondern auch explizit an interessierte Bürger:innen – unabhängig von Vorkenntnissen, und vermittelt ein grundlegendes Verständnis für die Anwendungen und Potenziale dieser KI-Modelle. Katrin Schröder ist Expertin auf diesem Gebiet und hat den Kurs „KI-Tools kurz erklärt: So verwendest du ChatGPT, Leonardo.AI & Co.“ gemeinsam mit Meena Stavesand konzipiert und umgesetzt.

Jetzt anmelden und einen Platz in der Schulung sichern

Melde dich jetzt kostenlos für die Lunch Bag Session an und starte deine persönliche KI-Lernreise mit uns. Unser Expertinnenteam freut sich darauf, dir die faszinierenden Möglichkeiten dieser Technologie näherzubringen und dich auf deinem Weg zu mehr digitaler Kompetenz zu begleiten. Gemeinsam erschließen wir das volle Potenzial der künstlichen Intelligenz – für deine persönliche und berufliche Entwicklung.

Weitere Veranstaltungen der HOOU zu Künstlicher Intelligenz

Die HOOU bietet dir ein vielfältiges Angebot zum Thema Künstliche Intelligenz – hier eine Auswahl der kostenlosen Events im November:

- Dienstag, 12. November, 18.30 Uhr, ligeti zentrum in Hamburg-Harburg: KI & Musik: Künstlerische Intelligenz im digitalen, kreativen Raum

- Freitag, 15. November, 13.45 bis 15 Uhr, TURN-Conference in Berlin: KI-Avatare in der Wissenschaftskommunikation & Lehre

- Mittwoch, 20. November, 12 bis 13 Uhr, ZOOM: Lunch Bag Session: Einführung in die KI-Tools ChatGPT und DALL-E

- Montag, 25. November, 17 bis 19.30 Uhr, TU Hamburg: Abschlusskonferenz im Projekt Kom.KI: KI –Kompetenzen fördern

- Donnerstag, 28. November, 15 bis 19 Uhr, Forum Finkenau in Hamburg: KI-Werkstatt: Alles KI – oder was?

Bild: Midjourney

24.07.2024 | Meena Stavesand

Generative KI: Das musst du über Urheberrecht, Datenschutz und Transparenz wissen

ChatGPT, Co-Pilot, Midjourney, Dalle-E oder auch DeepL – das alles sind KI-Generatoren für Texte und Bilder, die künstliche Intelligenz in die Gesellschaft gebracht haben. Jeder kann sich an generativer KI versuchen, Texte, Bilder und Videos erstellen und veröffentlichen. Aber wie sieht es mit Urheberrecht und Datenschutz aus? Was darf wie genutzt werden? Wann muss man KI-generierte Inhalte kennzeichnen? Und welche Verantwortung trägt man bei der Arbeit mit KI-Generatoren? Diese Fragen haben wir der Juristin Andrea Schlotfeldt von der HAW Hamburg gestellt. Herausgekommen ist ein spannendes Interview, in dem es auch um den neuen AI Act der EU geht.

Thema Urheberrecht. Inwieweit kann es bei Erstellung und Nutzung von KI-Inhalten zu Urheberrechtsverletzungen kommen?

Andrea Schlotfeldt: Die Wahrscheinlichkeit, hierbei fremde Urheberrechte zu verletzen, ist an sich gering. Es verbleibt aber ein Restrisiko. Hierfür ist die Art des gewählten Prompts relevant und, ob ich den KI-Output noch weiterbearbeite und falls ja, in welchem Umfang. Lasse ich einen noch geschützten fremden Text übersetzen und veröffentliche ich diese Übersetzung, kann darin eine Urheberrechtsverletzung liegen. Ebenfalls wenn ich ein fremdes Bild hochlade, durch die KI geringfügig verändere und dann neu veröffentliche.

Eine Urheberrechtsverletzung kann allerdings auch zufällig bzw. unbewusst vorkommen, auch je nach zugrunde liegendem Trainingsmaterial. Sofern KI-Output mit bestehenden fremden Werken identisch ist oder diesen stark ähnelt, ohne dass ich durch meinen Prompt darauf hingewirkt habe, könnte es theoretisch also auch zu Urheberrechtsverletzungen kommen.

Wie kann ich sicherstellen, dass ich bei der Nutzung von KI-Inhalten keine Urheberrechte verletze?

Andrea Schlotfeldt: Eine pauschale Sicherstellung ist nicht möglich, aber man kann z. B. durch eine Rückwärtssuche u. a. bei Google prüfen, ob man ähnliche Ergebnisse bekommt – wenn ja, ist man eventuell im Bereich der Urheberrechtsverletzung und sollte auf die Nutzung verzichten. Aber das lässt sich nicht generell sagen, sondern man muss es im Einzelfall prüfen. Grundsätzlich ist die Rückwärtssuche ein Instrument, mit dem man zumindest eine erste Information bekommt.

Auch sollte man davon absehen, KI-generierte Übersetzungen noch geschützter Texte ohne Zustimmung der Rechteinhaber:innen zu veröffentlichen. Letztlich kommt es darauf an, wie der Prompt ausgestaltet ist. Wenn man ganz gezielt nach bestimmten Texten oder Studienauszügen fragt, dann kann es vorkommen, dass zumindest in Teilen auch 1:1-Inhalte generiert werden. Von deren Weiterverwendung sollte ich dann absehen.

Gibt es Grenzen?

Andrea Schlotfeldt: Ja, man muss immer unterscheiden, in welchem Kontext man den Content verwendet. Wenn man ihn im Rahmen einer studentischen Arbeit oder auch als lehrende Person in Folien verwendet, dann kann das unter die Schranke des § 60a Urheberrechtsgesetz fallen, der zu Studien- oder Lehrzwecken bestimmte Nutzungen erlaubt, wenn die Inhalte in einem geschlossenen Benutzerkreis bleiben und nicht öffentlich auf einer Website zugänglich gemacht werden. Allerdings besteht hier die Anforderung, dass die Quellen angegeben werden müssen. Man muss also wissen, woher die Texte oder Bilder stammen – was bei KI-Output oft schwierig bis unmöglich sein kann. Und genau der eingeschränkte Kreis der Teilnehmerinnen und Teilnehmer an einer Veranstaltung ist wichtig.

Was ist der AI Act?<br>Der Artificial Intelligence Act (AIA) ist ein von der EU-Kommission im Rahmen der EU-Digitalstrategie veröffentlichtes Gesetz zur Regulierung von Künstlicher Intelligenz (KI) in Forschung und Wirtschaft. Er legt fest, welche Anbieter:innen und Nutzer:innen von KI-Systemen in der EU den neuen Regularien unterliegen. Dies betrifft sowohl in der EU ansässige als auch außerhalb der EU befindliche Akteur:innen, deren KI-Systeme in der EU genutzt werden. Der AI Act definiert KI weit: KI umfasst demnach Systeme, die maschinelles Lernen, logik- und wissensbasierte Konzepte oder statistische Ansätze nutzen. <br><br>KI-Anwendungen werden nach ihrem potenziellen Risiko in vier Kategorien eingeteilt: unannehmbares Risiko, hohes Risiko, geringes Risiko und minimales Risiko. Systeme mit unannehmbarem Risiko sind verboten, Hochrisiko-Systeme unterliegen strengen Anforderungen wie Risikomanagement und Daten-Governance, also Datenrichtlinien für die Erfassung, Speicherung, Verarbeitung und Vernichtung von Daten. Systeme mit geringem Risiko müssen minimale Transparenzpflichten erfüllen, während Anwendungen mit minimalem Risiko keine besonderen Anforderungen haben.<br><br>Der AI Act zeigt die EU-Bemühungen, Missbrauchspotenziale wie Beeinflussung und Überwachung durch KI zu minimieren. Unternehmen sollten sich frühzeitig mit den Regulierungen auseinandersetzen und ihre Entwicklungen entsprechend anpassen.

Es gibt auch die Gemeinfreiheit bei Werken. Was ist das genau?

Andrea Schlotfeldt: Zum einen sind Werke gemeinfrei, wenn der Urheberrechtsschutz abgelaufen ist, also 70 Jahre nach dem Tod des Urhebers oder der Urheberin. Oder Werke sind gemeinfrei, wenn sie gar nicht geschützt waren, weil es sich zum Beispiel um eine sehr einfache Gestaltung handelt, die keine Schöpfungshöhe, also keine besondere Originalität, aufweist, oder wenn es sich z. B. um Gesetzestexte handelt.

Wie kann ich sicherstellen, dass meine KI-generierten Inhalte nicht kopiert werden?

Andrea Schlotfeldt: Sicherstellen lässt sich dies nicht. Hier ist die Situation dieselbe wie bei herkömmlichen urheberrechtlich geschützten Texten oder Bildern, die ich veröffentliche. Sofern kein technischer Kopierschutz gegeben ist, können Inhalte rein faktisch übernommen werden. Wer bei mir „klauen“ möchte, den oder die kann ich nicht daran hindern.

Der Unterschied zu diesen von Menschen verfassten Inhalten ist, dass bei KI-Output in der Regel ja kein Urheberrechtsschutz anzunehmen ist, so dass die Weiternutzung zumeist tatsächlich zulässig ist (Stichwort „digitales Freiwild“). Derzeit wird unter Jurist:innen diskutiert, ob KI-Output künftig über ein sogenanntes Leistungsschutzrecht geschützt werden sollte, wie dies beispielsweise in Großbritannien in bestimmten Konstellationen der Fall ist. Ob eine solche Gesetzesänderung kommt, ist aber noch unsicher. Das Gesetzgebungsverfahren würde zudem sicher eine gewisse Zeit brauchen.

Gibt es Fälle, in denen mein KI-Output gleichwohl urheberrechtlich geschützt ist?

Andrea Schlotfeldt: Wenn Inhalte von mir wie Bilder oder Texte von einer KI nur geringfügig bearbeitet bzw. verändert wurden, aber im Wesentlichen immer noch meine Arbeit, mein Werk, sind, dann unterliegen sie weiterhin meinem Urheberrecht. So interpretiere ich die aktuelle Rechtslage. Wenn ich aber mittels KI ein Bild erstellen lasse, für das ich vorgebe, dass eine Lehr- bzw. Unterrichtssituation zu sehen sein soll, klassisch – ein Raum, Tische, Stühle, Monitore, Whiteboard und Studierende – und die KI generiert mir das, dann ist das nicht mein eigenes Werk. Wenn ich dieses Bild so – auch unbearbeitet – auf meine Website stelle, dann können es theoretisch auch andere nutzen. Es unterliegt dann keinem Urheberrecht. Das ist die Besonderheit – im Vergleich zu herkömmlichen Fotos oder Texten, auch wenn es mein Prompt ist, auf dem der Output ja letztlich basiert.

Gibt es eine Verpflichtung zur Transparenz, wenn ich Inhalte mit einer KI generiere?

Andrea Schlotfeldt: Hier kommt es auf die geplante Nutzung an: Eine generelle Pflicht zur Transparenz besteht aktuell noch nicht. Allerdings können sich auch jetzt schon Kennzeichnungspflichten aus Prüfungsvorgaben ergeben, etwa im Kontext der in der Regel geforderten Hilfsmittelangabe. Hierfür sind Art, Umfang und Zweck der KI-Nutzung ausschlaggebend. Die Umsetzung dieser Pflichten kann komplex ausfallen, zumal wenn die verwendeten Prompts mit aufzuführen sind.

Auch darf ich mich nicht als Urheber:in KI-generierter Texte ausweisen, wenn diese ausschließlich von einem KI-Tool erzeugt wurden. Die Grenzen sind allerdings fließend, und Rechtsprechung hierzu steht aus (Wieviel Anteil eines Textes darf beispielsweise KI-erzeugt sein, damit dieser noch als eigener Text gilt? Dies ist auch relevant bei Übersetzungen mit Diensten wie DeepL.). Bei Presseerzeugnissen können journalistische Sorgfaltspflichten ebenfalls eine Pflicht zur Kennzeichnung mit sich bringen.

Wichtig ist auch: Die EU hat im Mai 2024 den sogenannten AI Act verabschiedet – ein Gesetz für den Umgang mit KI. Darin ist auch eine Vorschrift enthalten, die eine Transparenzpflicht vorsieht. Sie soll voraussichtlich ab August 2025 gelten. Die genauen Vorgaben sind derzeit noch unkonkret. Hier werden juristische Kommentierungen oder ggf. Konkretisierungen durch das AI Office eine wertvolle Hilfe sein, Aktuell wird an diesen gearbeitet.

Eine Frage, die sich daran anschließt, ist die nach der Kontrolle. Wie kann man kontrollieren, ob ein Content KI-erzeugt ist?

Andrea Schlotfeldt: Kontrolle ist schwierig. Es gibt u. a. die Möglichkeit, Wasserzeichen einzusetzen, um KI-Output als solchen zu kennzeichnen, aber wie dauerhaft sind diese? Kann man sie einfach „herausschneiden“? Hier ist die Forschung gefragt und auch dabei (u. a. an der HAW Hamburg), gute Lösungen zu entwickeln, damit solche Markierungen nicht einfach entfernt werden können.

Was sind Deepfakes?<br>Deepfakes sind Medieninhalte, bei denen künstliche Intelligenz verwendet wird, um realistisch aussehende Fälschungen zu erstellen. Diese Fälschungen können Videos, Audios oder Bilder umfassen, bei denen das Gesicht oder die Stimme einer Person manipuliert oder komplett ersetzt wird, um den Eindruck zu erwecken, dass diese Person etwas gesagt oder getan hat, was in Wirklichkeit nicht der Fall ist. Der Begriff „Deepfake“ setzt sich aus „Deep Learning“ und „Fake“ zusammen und weist darauf hin, dass tiefe neuronale Netze, eine Technologie des maschinellen Lernens, verwendet werden, um diese Fälschungen zu erzeugen.

Thema Verantwortung und Haftung. Bin ich für meine Inhalte verantwortlich? Und kann ich die Verantwortung abgeben?

Andrea Schlotfeldt: Man kann die Verantwortung in der Regel nicht abgeben. Wenn man die Tools nutzt und damit Inhalte erstellt, dann sind die Nutzungsbedingungen dieser Programme in der Regel so ausgestaltet, dass der Nutzer oder die Nutzerin selbst verantwortlich ist. Anders kann die Situation zu beurteilen sein, wenn bei einer Prüfung der Einsatz eines KI-Tools verpflichtend vorgesehen ist und „unwissentlich“ eine Urheberrechtsverletzung entsteht, die zudem der Öffentlichkeit zugänglich wird, etwa im Zuge der Präsentation von Abschlussarbeiten. Hier hängt die Beurteilung sehr vom Einzelfall ab.

Viele Nutzende treibt der Datenschutz um. Bei ChatGPT gibt es die Möglichkeit, die eigenen Daten dahingehend zu schützen, dass die Prompts und Ergebnisse nicht weiterverwendet werden. Ist das wirklich möglich?

Andrea Schlotfeldt: Ob diese Einstellungen ein Garant für den Schutz sind, dazu sind mir keine Erhebungen oder Studien bekannt. Viele Expert:innen sprechen bei KI-Tools von einer Black Box. Was passiert da eigentlich? Wird eingehalten, dass meine Daten oder Werke nicht für das KI-Training verwendet werden? Das lässt sich derzeit nicht mit Sicherheit sagen. Wer seine Daten schützen will, sollte z. B. bei ChatGPT auf die History verzichten – und das kann wiederum problematisch sein. Diese Art der Dokumentation wird bei Prüfungen, bei denen KI-Generatoren erlaubt oder sogar vorgesehen sind, in der Regel vorausgesetzt, siehe oben, Stichwort Kennzeichnungspflichten. Das ist auch ein Problem, für das wir praxistaugliche Lösungen brauchen.

Hast du generell einen Tipp, wie man mit seinen Daten umgehen sollte?

Andrea Schlotfeldt: Möchte ich datensparsam vorgehen, sollte ich schon bei den eigenen Eingaben darauf achten, keine persönlichen Daten einzugeben und mir genau überlegen, wie viele Informationen ich preisgeben möchte. Wenn ich zum Beispiel meinen Lebenslauf von einer KI verbessern lasse, muss ich mich bewusst entscheiden, welche Daten ich der KI gebe.

Wenn ich im Personalwesen oder in der Forschung mit KI arbeite und zum Beispiel personenbezogene Daten zusammenfassen lasse, dann muss ich eine Rechtsgrundlage bzw. eine Einwilligung der Personen haben – und die muss freiwillig sein. Das heißt, die Person, die ich um Einwilligung bitte, muss verstehen, was genau mit den Daten passiert, und sie muss die Entscheidung tatsächlich als freiwillig empfinden. Es ist wichtig, dass wir diese Datensensibilität auf beiden Seiten entwickeln.

Was meinst du damit?

Andrea Schlotfeldt: Es geht zum einen darum, dass die Nutzerinnen und Nutzer von KI wissen, dass sie nicht einfach persönliche Daten anderer in das KI-Tool kopieren können, um zum Beispiel etwas zusammenzufassen oder sich die Arbeit anderweitig zu erleichtern. Gerade im Arbeitskontext, auch an Hochschulen, wird für Datenverarbeitungen immer eine Rechtsgrundlage benötigt. Zum anderen müssen auch die sogenannten „Betroffenen“, also die Menschen, deren Daten oder Informationen genutzt werden, verstehen, was konkret mit ihren Daten passiert und worauf sie bei einer Einwilligung achten müssen.

Das Thema KI wird uns rechtlich in den nächsten Jahren noch intensiv beschäftigen. Es geht um unsere eigenen Daten, um Urheberrechte und Transparenz, aber auch um die Verletzung von Persönlichkeitsrechten, zum Beispiel durch Deep Fakes.

Andrea Schlotfeldt: Ja, die sogenannten Deepfakes sind eine der großen Herausforderungen, denen wir begegnen. Je mehr technisch möglich ist und je mehr Menschen auch mit den Tools umgehen können, desto gravierender können die Auswirkungen auf die Gesellschaft und einzelne Betroffene sein. Der Bereich der pornografischen (Fake-)Darstellungen ist bereits jetzt ein riesiges Problem.

Auch die Politik und der Journalismus haben mit Deepfakes zu kämpfen – das kann Wahlen oder andere politische Entscheidungen beeinflussen, wenn Falschinformationen über KI-erzeugte Videos oder Bilder verbreitet werden. Ein weiteres Problem können sogenannten Softfakes sein, also Bilder, Videos oder Audioclips, die manipuliert werden, um politische Kandidat:innen attraktiver oder vorteilhafter wirken zu lassen. Auch im Bereich wissenschaftlicher Forschung können negative Auswirkungen, die auf Falschinformationen basieren, nicht ausgeschlossen werden.

Was kann hier helfen?

Andrea Schlotfeldt: Wir müssen eine deutlich höhere Sensibilität für solche falschen Inhalte entwickeln. Das geht nur durch (Weiter-)Bildung – und betrifft alle Altersstufen. Die Menschen müssen vielfältige Kompetenzen in diesem Bereich erwerben. Am besten fängt man damit schon bei Kindern an.

Viele Institutionen und Einrichtungen bieten bereits geeignete Materialien und Tools wie Fakefinder an. Auch von der HOOU an der HAW Hamburg gibt es ein passendes Lernangebot, adressiert an Lehrkräfte, die ihren Schülerinnen und Schülern wichtige Kompetenzen beim Umgang mit Informationen aus dem Netz vermitteln möchten, also auch Deepfakes. Diese Angebote sollten wir nutzen.

Über Andrea Schlotfeldt:

Andrea Schlotfeldt ist wissenschaftliche Mitarbeiterin Juristische Beratung für Projekte der Hamburg Open Online University an der HAW Hamburg. In dieser Rolle berät sie OER-Produzierende in rechtlicher Hinsicht bei der Konzeption und Veröffentlichung ihrer offenen Bildungsmaterialien. Darüber hinaus ist sie mit Fragen des Urheberrechts, des Datenschutzes und KI in der digitalen Lehre befasst. Sie ist zudem seit 2008 selbständige Rechtsanwältin, Dozentin und Referentin mit Schwerpunkt Urheber-/Vertragsrecht und KI, auch hier fokussiert auf Wissenschafts- und Bildungsinstitutionen.

Lizenzhinweis für das Interview (Text): CC BY 4.0

Bild: Markus Spiske/Unsplash

19.06.2024 | Meena Stavesand

Klimawandel: Wie uns grüner Wasserstoff bei der Energiewende helfen kann

Anlässlich der bundesweiten „Woche des Wasserstoffs“ beschäftigen wir uns mit der Energiewende. Denn Wasserstoff bietet vielfältige Anwendungsmöglichkeiten auf dem Weg zu mehr Klimaneutralität. In unserem Lernangebot „Green Hydrogen“ der TU Hamburg erfahrt ihr, was Wasserstoff eigentlich ist. Außerdem erklären wir euch, welche Rolle Wasserstoff für eine nachhaltige und zukunftsfähige Energieversorgung spielen kann.

In ganz Deutschland öffnen Unternehmen, Hochschulen und Forschungseinrichtungen in dieser Woche vom 15. bis 23. Juni ihre Türen, um Einblicke in aktuelle Projekte und Entwicklungen rund um das Thema Wasserstoff zu geben. Besucherinnen und Besucher können an Fachvorträgen, Workshops und Probefahrten mit wasserstoffbetriebenen Fahrzeugen teilnehmen.

Die Veranstaltungen richten sich an Fachleute, Studierende und natürlich alle interessierten Bürgerinnen und Bürger, die mehr über die Potenziale und Herausforderungen der Wasserstofftechnologie erfahren möchten.

Stadtrundfahrt in Hamburg: Auge in Auge mit der Zukunft

Auch in Hamburg beschäftigen sich Expertinnen und Experten mit dem Thema Wasserstoff und möchten ihr Wissen weitergeben. So unterstützen die Norddeutsche Wasserstoffstrategie und das Branchennetzwerk Erneuerbare Energien Hamburg (EEHH) im Rahmen der Wasserstoffwoche die neue Stadtrundfahrt „Auge in Auge mit der Zukunft“ – oder auch HH-Energie-Bus-Tour genannt. Sie erläutert hautnah im Hamburger Hafengebiet alles rund um das Thema Erneuerbare Energien und Wasserstoff. Anmeldungen sind noch möglich!

Green Hydrogen für eine nachhaltige Energieversorgung

Grüner Wasserstoff gilt als großer Hoffnungsträger für die erfolgreiche Umsetzung der Energiewende und die vollständige Abkehr von fossilen Energieträgern. Politik, Wissenschaft und Industrie sind sich weitgehend einig, dass Wasserstoff in einer Vielzahl von Anwendungen eingesetzt werden kann – und zum Teil auch muss, um ehrgeizige Klimaschutzziele zu erreichen. Im Fokus steht dabei insbesondere der klimaneutral hergestellte grüne Wasserstoff.

Bevor wir uns in dem Lernangebot „Green Hydrogen“ von der TU Hamburg mit den Details der Herstellung und Nutzung von Wasserstoff beschäftigen, diskutieren wir, warum Wasserstoff so wichtig für die Zukunft ist. Wir beginnen mit den Grundlagen:

- Wie genau beeinflussen wir Menschen und unser Handeln das Klima?

- Welche Folgen hat der menschengemachte Klimawandel?

- Warum ist es so wichtig, etwas dagegen zu tun?

Warum ist Wasserstoff der Energieträger der Zukunft?

Dann werfen wir einen Blick auf die Energiewende: Wie weit sind wir gekommen? Welche Herausforderungen liegen noch vor uns? Und vor allem: Welche Rolle kann Wasserstoff dabei spielen? Das Lernangebot „Green Hydrogen“ bietet eine spannende Reise durch die Welt des Wasserstoffs und zeigt, warum er der Energieträger der Zukunft sein könnte.

Vielseitig einsetzbar: Von der energetischen Nutzung bis zu E-Fuels

Ein Kapitel des Lernangebots beschäftigt sich mit den verschiedenen Anwendungen von Wasserstoff, wobei der Schwerpunkt auf der energetischen und stofflichen Nutzung liegt.

- Stoffliche Nutzung: Hier werden die chemischen Eigenschaften des Wasserstoffs genutzt, um mit anderen Elementen zu reagieren und neue Verbindungen zu bilden oder bestehende zu verändern. Wasserstoff wird häufig in der chemischen Industrie und bei der Raffination von Rohöl eingesetzt. Zukünftige Anwendungen könnten in der Stahl- und Kunststoffproduktion liegen.

- Energetische Nutzung: Wasserstoff kann auch zur Erzeugung von Strom und Wärme genutzt werden, indem seine chemisch gebundene Energie umgewandelt wird.

- E-Fuels: Eine interessante Anwendung von Wasserstoff ist die Herstellung von synthetischen Kraftstoffen, den so genannten E-Fuels. Diese werden aus grünem Wasserstoff und Kohlendioxid hergestellt und können ähnlich wie herkömmliche fossile Kraftstoffe zum Beispiel in Flugzeug- oder Lkw-Motoren eingesetzt werden. Während der Wasserstoff zunächst als Ausgangsstoff für die Synthese von E-Fuels dient, wird seine Energie letztlich bei der Verbrennung freigesetzt. Wer mehr über E-Fuels erfahren möchte, kann sich das Lernangebot Advanced Fuels ansehen oder den Podcast MobilCast der TU Hamburg anhören.

Wasserstoffanwendungen im Mobilitätssektor

Wasserstoffbetriebene Fahrzeuge können in nahezu allen Bereichen des Verkehrssektors eingesetzt werden. Elektroautos mit wasserstoffbetriebenen Brennstoffzellen sind eine Möglichkeit, den Individualverkehr auf der Straße ohne den Ausstoß von Treibhausgasen und anderen Luftschadstoffen zu ermöglichen. Diese wasserstoffbetriebenen Fahrzeuge werden seit mehreren Jahrzehnten entwickelt, unterscheiden sich heute in Funktionalität und Komfort kaum noch von fossil betriebenen Fahrzeugen und können auch von Privatpersonen erworben werden.

Wasserstoff in der Industrie

In der Industrie sind fossile Rohstoffe nicht nur Energieträger, sondern auch wichtige Grundstoffe. So werden zum Beispiel Kunststoffe aus Erdöl und Düngemittel aus Erdgas hergestellt. Grüner Wasserstoff könnte hier eine klimafreundliche Alternative bieten.

Eines der wichtigsten Einsatzgebiete für Wasserstoff ist die Stahlproduktion. Normalerweise wird Stahl aus Eisenerz hergestellt, das chemisch mit Sauerstoff verbunden ist. Um den Sauerstoff zu entfernen, wird Koks (aus Kohle) verwendet. Dadurch ist die Stahlproduktion ein großer Verursacher von Treibhausgasen – allein in Deutschland sind es etwa 6 Prozent der Gesamtemissionen. Umweltfreundlicher ist die Direktreduktion mit grünem Wasserstoff.

Wasserstoff für Strom und Wärme

Strom und Wärme verursachen mehr als die Hälfte der gesamten CO2-Emissionen in Deutschland. Wasserstoff bietet eine klimafreundliche Alternative, diese Emissionen zu reduzieren.

Mit grünem Wasserstoff kann auf zwei Arten Energie erzeugt werden:

- durch direkte Verbrennung

- durch Brennstoffzellen

Bei der direkten Verbrennung wird der Wasserstoff einfach verbrannt, um Wärme zu erzeugen. Brennstoffzellen hingegen wandeln die chemische Energie des Wasserstoffs in Strom und Wärme um – und das ohne CO2-Emissionen, wenn grüner Wasserstoff verwendet wird.

Wasserstoff in der Lebensmittelverarbeitung und im Maschinenbau

Ein wichtiges Anwendungsgebiet ist die Prozesswärme. Das ist die Wärme, die bei der Herstellung oder Weiterverarbeitung von Produkten benötigt wird. Fast alle Produkte, die wir täglich verwenden, benötigen an irgendeiner Stelle ihrer Herstellung hohe Temperaturen.

Einige Industriezweige, wie die Lebensmittelverarbeitung oder der Maschinenbau, benötigen moderate Temperaturen unter 500 °C. Andere, wie die Glas- und Keramikherstellung, benötigen sehr hohe Temperaturen von bis zu 3000 °C. Der Großteil dieser Prozesswärme wird derzeit mit fossilen Brennstoffen erzeugt. Grüner Wasserstoff kann hier eine klimaneutrale Alternative bieten.

Informiere dich in unserem Lernangebot, wie die Prozesse genau funktionieren!

Foto: Meena Stavesand

12.06.2024 | Meena Stavesand

Weltpremieren beim Slam: Von nackten Reitern über zerbrochene Nudeln bis hin zu Mathe in der Musik

Was haben nackte Reiter, zerbrochene Spaghetti und ein Instrument mit nur einer Saite gemeinsam? Sie alle waren Teil des ersten Science-and-Art-Slams der HOOU. Vor mehr als 130 Menschen in der Zentralbibliothek der Bücherhallen Hamburg performten die Wissenschaftler:innen und Kulturschaffenden mit einzigartigen Auftritten.

WELTPREMIERE! Moderator Dr. Ronny Röwert geizte am Abend des 31. Mai nicht mit solchen Superlativen – und das zurecht! Denn nicht nur der Science-art-Art-Slam der Hamburg Open Online University an sich war eine Weltpremiere, auch die Slams waren in ihrer jeweiligen Form und der Zusammensetzung ein exklusives Schauspiel (und werden dies wohl bleiben).

Wissenschaftliche Vielfalt

Den mehr als 130 Besucherinnen und Besuchern bot sich also ein außergewöhnliches Event, das sich insbesondere durch seine wissenschaftliche Vielfalt auszeichnete. Denn wenn die HOOU einen Slam organisiert, dann sollen das Publikum auch etwas lernen – dafür steht die HOOU jedenfalls: Bildung für alle. So lautete also auch das geheime Motto des Abends.

Und so kombinierte das Organisationsteam um Dr. Paula de Oliveira Guglielmi einen Auftritt zu Künstlicher Intelligenz (mit kurzeitigem Internetproblem, das Ronny Röwert und Slammer Franz Vergöhl charmant überbrückten, während seine Slammerkollegin Sophie Heins es schnell löste) mit dem Vocalcoaching von Linda Smailus, bei dem die Hamburgerinnen und Hamburger ihre Stimme trainieren konnten.

Harte Töne, sanfte Töne

Außerdem beeindruckten mit ihren Performances Prof. Dr. Anja Steidinger und Julia Stolba in Trenchcoat und Sonnenbrille – mit Prof. Dr. Nora Sternfeld als Stimme aus dem Off, die über nackte Reiter philosophierten, und Tam Thi Pham mit einem besonderen Instrument – der Dan Bau, die aus nur einer Saite besteht, aber trotzdem einzigartige Töne fabriziert.

Zu vergessen sind aber auch nicht Jan Küchenhof, der mit dem Publikum eine Reise in die Welt der Ideenfindung und Produktentwicklung unternahm, und Vincent Dombrowski, der Musik und Mathematik miteinander verband. Klingt komisch? War aber spannend – auch für Menschen, die weniger mit Zahlen umgehen wollen!

Komplexe Themen simpel heruntergebrochen

Was fehlt? Die zerbrochenen Spaghetti! Und für die sorgte Philip Rose, der am Ende auf den Nudelresten auch den Siegerpokal in die Luft heben konnte. Der Wissenschaftler der HAW brachte dem Publikum die Vielseitigkeit von kohlenstofffaserverstärktem Kunststoff näher – und das war (anders als vielleicht der Begriff an sich) unglaublich interessant. Das lag maßgeblich an Philips humorvoller Art, die Dinge auf ihre Einfachheit herunterzubrechen. Das ist nicht immer die Stärke von Forschenden, die zu einem Thema auch noch promovieren, aber Philip hat das mit Bravour gemeistert – und dafür am Ende den lautesten Applaus eingeheimst.

Natürlich wäre die HOOU nicht die HOOU, wenn auch beim „Applausometer“ Wissenschaft niederschwellig zu sehen gewesen wäre. Goran Lazarevic von der HfMT hatte eigens für den Slam eine Software programmiert, die mithilfe eines Mikrofons sehr genau anzeigte, wie laut der Applaus wirklich war. Und so war auch ohne Zweifel klar, dass sich Philip am Ende durchsetzte – wissenschaftlich belegt!

Leidenschaft für Wissenschaft, Kunst und Kultur

Knappt war es trotzdem. Denn alle Slammer:innen haben eins gezeigt: Sie sind Expert:innen auf ihren Gebieten – und begeistern mit ihrer Leidenschaft für die Wissenschaft, Kunst und Kultur viele Menschen. So auch die über 130 Zuschauerinnen und Zuschauer beim ersten Science-and-Art-Slam der Hamburg Open Online University.

Danke an alle Beteiligten

Wir bedanken uns bei allen Beteiligten, insbesondere bei den Bücherhallen Hamburg als Kooperationspartner, bei Frau Dr. Eva Gümbel, Hamburger Staatsrätin für Wissenschaft, Forschung und Gleichstellung, die ein Grußwort sprach, bei Moderator Ronny Röwert und natürlich bei den Slammerinnen und Slammern für die vielen Weltpremieren!

Bild: Solen Feyissa/Unsplash

17.05.2024 | Meena Stavesand

KI im Studium nutzen: Darum sollten sich Studierende mit KI-Tools auseinandersetzen

ChatGPT, DeepL und Co. sparen viel Zeit. Bei den täglichen Routinen am Schreibtisch, aber auch bei der kreativen Arbeit. Doch wie lassen sich KI-Tools im Studium einsetzen?

Es ist eine spannende Frage, die Franz Vergöhl und Sophie Heins von der HafenCity Universität mit Studierenden besprochen haben. KI-Tools im Studium einsetzen – aber wie? Aus den Ergebnissen der Gespräche ist ein neues HOOU-Lernangebot entstanden: KI im Studium nutzen. Was in dem Kurs vermittelt wird und wie sich sowohl Studierende als auch Hochschulen in Zukunft auf den Einsatz von KI einstellen sollten, darüber sprechen wir mit den beiden im Interview.

Was ist euer Lieblings-KI-Tool?

Franz Vergöhl: Mein Lieblings-KI-Tool ist tatsächlich ChatGPT, das ich sehr gerne als Sparringspartner verwende, sei es für schwierige E-Mails, Projektideen, Titel für Podcastfolgen oder Artikel, aber auch für Social Media. Ich lasse mir zum Beispiel gerne Dinge vorformulieren oder auch Fragen stellen und verwende dann meine eigenen Formulierungen. Außerdem lasse ich mir manchmal Dinge von ChatGPT erklären, die ich sonst googeln müsste.

Sophie Heins: In letzter Zeit benutze ich vor allem DeepL Write, um E-Mails, die ich formuliere, von der Zeichensetzung korrigieren oder stilistisch besser formulieren zu lassen. Aber es kommt immer auf die Anwendung an. Also ChatGPT benutze ich natürlich auch, das finde ich ebenfalls sehr praktisch.

Ihr nutzt also KI-Tools in eurer täglichen Arbeit.

Sophie Heins: Ja. Wir hatten zum Beispiel vor kurzem eine Auftaktveranstaltung für eine Lehrveranstaltung und wir sind ganz begeistert von unserer ersten Aufgabe, die wir den Studierenden gegeben haben. Die haben wir nämlich mit Hilfe von ChatGPT generiert. Ich glaube nicht, dass wir selbst so schnell auf diese Aufgabe gekommen wären. Das ist ein sehr gutes Beispiel dafür, wie wir KI auch einsetzen. Es geht nicht nur darum, Texte zu verbessern oder zu korrigieren. KI-Tools können viel mehr.

Was war die Aufgabe?

Sophie Heins: In dem Seminar geht es darum, wie wir Städte nachhaltig gestalten können. Die Studierenden sollten dann in die Hafencity gehen und sie auf bestimmte Aspekte hin untersuchen – unter anderem auf nachhaltiges Wohnen. Eine Gruppe hat sich auf negative Punkte konzentriert, eine andere auf positive. Ihre Eindrücke sollten sie fotografisch dokumentieren. Anschließend haben wir anhand der Fotos darüber diskutiert. Die Fotodokumentation war eine Idee von ChatGPT.

Wie war das Feedback dazu?

Sophie Heins: Das kam bei den Studierenden sehr gut an, weil es eine willkommene Abwechslung zur Vorlesung ist. Sie müssen raus, sie machen Fotos, sie tauschen sich aus, sie diskutieren miteinander. Im Idealfall sind die Gruppen mit Studierenden aus verschiedenen Studiengängen gemischt, so dass verschiedene Perspektiven aufeinandertreffen. Auch wir sind von der Aufgabe begeistert.

Franz Vergöhl: Für kreative Aufgaben ist ChatGPT sehr hilfreich. Aber auch für organisatorische Aufgaben verwende ich es gerne. Derzeit koordiniere ich eine Runde mit verschiedenen Lehrenden aus Deutschland, die sich regelmäßig zum Austausch treffen. Für die Organisation mit vielen Informationen, die sinnvoll und schnell lesbar zusammengestellt werden müssen, benutze ich es ebenfalls. Ich schreibe alle Informationen nach bestem Wissen auf und frage dann die KI. Sie formuliert es so, dass es keine Dopplungen, keine unnötigen Füllwörter und dergleichen mehr gibt. Das ist sprachlich oft viel präziser, prägnanter und strukturierter und damit eine große Hilfe.

Und es geht auch viel schneller.

Franz Vergöhl: Ja, und es gibt eine gewisse Sicherheit, dass alles sinnvoll formuliert ist. Wenn ich den Text dann einer Kollegin zeige, haben wir eigentlich ein Sechs-Augen-Prinzip.

Wie geht ihr mit den Daten um?

Franz Vergöhl: Ich ändere zum Beispiel immer die Namen. Ansonsten arbeite ich, wenn ich ChatGPT benutze, mit wenig sensiblen Daten. Es gibt keine Forschungsdaten von Studierenden, die zurückverfolgt werden können oder ähnliches.

In eurem neuen Lernangebot auf der HOOU geht es auch um KI-Tools – und zwar um deren Einsatz im Studium. Wie seid ihr darauf gekommen?

Franz Vergöhl: Zum einen waren wir der Meinung, dass Studierende, die sich für den Einsatz von KI-Tools interessieren, mehr brauchen als die Handreichungen der Hochschulen. Die sind nicht wirklich pragmatisch und oft auch von der Sprache und vom Medium her nicht an die Studierenden gerichtet. Das fanden wir schwierig. Auf der anderen Seite ist KI so neu, dass es aus Sicht der Forschung oder der Wissenschaft keinen Wissensvorsprung gibt. Wir sind hier nicht in Themen unterwegs, die Professorinnen und Professoren seit 40 Jahren erforschen und dann den Bachelorstudierenden im ersten Semester ihren Wissensvorsprung präsentieren.

Wir wollten ein Gegengewicht schaffen und die Studierenden fragen, wie sie eigentlich mit KI umgehen, was sie voneinander lernen und wie sie sich gegenseitig unterstützen können? Die Grundidee war also, das studentische Wissen beziehungsweise die studentische Perspektive in den Mittelpunkt zu stellen.

Wie seid ihr dabei vorgegangen?

Sophie Heins: Wir haben viele Interviews mit Studierenden geführt oder mit Leuten gesprochen, die gerade ihr Studium abgeschlossen haben. Wir haben sie zum Beispiel gefragt, wie sich KI auf ihren späteren Beruf auswirkt oder ob sie sich bei der Anwendung von KI-Tools von den Hochschulen unterstützt fühlen. Was sie sich in diesem Zusammenhang wünschen. Daraus haben wir dann das Angebot entwickelt, das sich mit KI an sich beschäftigt, das generative KI erklärt und in KI als Werkzeug einführt, aber auch die Herausforderungen und Risiken von KI im Allgemeinen und im Rahmen der Bildung thematisiert.

Wir gehen auch darauf ein, was wir und KI für inklusive Bildung tun können, denn darum geht es im SDG 4 – hochwertige Bildung – im Rahmen der Sustainable Development Goals (SDGs). Das sind 17 Nachhaltigkeitsziele als politische Ziele der Vereinten Nationen, die weltweit eine nachhaltige Entwicklung auf ökonomischer, sozialer und ökologischer Ebene sicherstellen sollen. Das ist uns wichtig, weil wir an dem SDG-Campus an der HafenCity Universität angesiedelt sind. Darüber hinaus bietet der Kurs Beispiele dafür, wie KI konkret im Studium eingesetzt werden kann – von der Recherche über die Textverarbeitung bis hin zur Konzeptentwicklung – und gibt den Lernenden immer wieder die Möglichkeit, von ihren Erfahrungen in Foren zu berichten und von den Erfahrungen anderer zu profitieren.

Schließlich gibt es noch eine praktische Aufgabe mit der Frage: Wie können innovative Lösungen für Bildungsprobleme auf globaler Ebene dienen und gleichzeitig individuelle Bedürfnisse und soziale Gerechtigkeit im Bildungssystem fördern?

Das klingt spannend. Auch für diese Frage könnte man KI einsetzen – zumindest zum Brainstorming. Was meint ihr dazu: Ist die Hemmschwelle bei Studierenden groß, KI-Tools für studentische Aufgaben zu nutzen?

Franz Vergöhl: Nach meiner Wahrnehmung gibt es eher eine Hemmschwelle bei Studierenden, mit Lehrenden über den Einsatz von KI-Tools zu sprechen. Ich gehe davon aus, dass jeder schon einmal in die Anwendungen hineingeschaut hat. Aber bevor man sie im Studium einsetzt, sollte man sich gut informieren und mit anderen austauschen. Was darf man? Was darf man nicht? Unter welchen Bedingungen darf man? Gibt es Leitfäden und Regeln an der eigenen Hochschule?

Es ist aber auch wichtig, sich bereits im Studium mit KI zu beschäftigen. Denn die Kompetenz, mit KI-Werkzeugen umgehen zu können, wird wahrscheinlich auch im späteren Beruf benötigt. Es macht also keinen Sinn, sich im Studium davor zu drücken. Spätestens auf dem Arbeitsmarkt wird es verlangt.

Wie läuft der Diskurs über KI-Tools derzeit an den Hochschulen?

Franz Vergöhl: Es passiert viel, aber es wird noch nicht alles kommuniziert. Es wird sehr intensiv diskutiert, wie man KI strategisch einbinden kann. Kommt es in die Curricula der Bachelor-Studiengänge? Gibt es so etwas wie ein Studium Generale für KI? Wird es eher einzelne Kurse geben, in denen „Future Skills“ zum Beispiel in Projekten vermittelt werden? Wir sind glücklicherweise über den ersten Punkt hinaus, wo wir nur über Prüfung und Täuschung der Studierenden durch KI diskutiert haben. Das haben die Hochschulleitungen flächendeckend verstanden. Aber was unter der Oberfläche passiert, das kann ich in der Breite nicht sagen.