Kategorie: TUHH

Bild: Ivan Samkov / pexels.com

15.04.2025 | Meena Stavesand

KI trifft Klassenzimmer: Wie Lehrkräfte lernen, künstliche Intelligenz sinnvoll einzusetzen

Wie verändert KI die Bildung – nicht nur im Klassenzimmer, sondern schon in der Ausbildung der Lehrkräfte? Wir haben mit Johannes Schäfers von der TU Hamburg gesprochen. Er ist Experte für berufliche Bildung und entwickelte für die HOOU gemeinsam mit Prof. Dr. Maren Baumhauer und Stephanie Wichmann das Lernangebot „KOM.KI“, mit dem sich etwa Lehramtsstudierende auf den reflektierten Einsatz von KI vorbereiten können. Im Interview spricht er über Chancen, Stolpersteine – und darüber, warum man sich ruhig trauen darf, einfach mal mit KI loszulegen.

Wann bist du mit KI in Berührung gekommen?

Johannes Schäfers: Mein erster Berührungspunkt mit KI war tatsächlich Ende 2022, Anfang 2023, als die ersten Chatbots für die breite Gesellschaft wie z. B. ChatGPT aufkamen. Das war schon beeindruckend, was da plötzlich möglich war.

Wie nutzt du KI heute in deiner Arbeit an der TU Hamburg?

Johannes Schäfers: Inzwischen fast täglich. An der TU Hamburg haben wir einen eigenen Chatbot namens TUKI, die auch auf ChatGPT basiert. Die ist mit unserer Infrastruktur verknüpft. Das macht es besonders praktisch.

Ich nutze aber auch verschiedene KI-Tools fürs Brainstorming, zum Strukturieren von Inhalten und für Bildgenerierung – zum Beispiel für Präsentationen oder für die Lehre allgemein. KI hilft mir teilweise bei administrativen Aufgaben, um Prozesse effizienter zu gestalten. Es spart einfach Zeit und gibt Raum für Kreativität.

Wenn du an Schule und Bildung denkst – wo siehst du die größten Potenziale von KI? Für Lehrkräfte und für Schüler:innen?

Johannes Schäfers: Für Lehrkräfte sehe ich unter anderem riesiges Potenzial in der Analyse und Begleitung von Lernprozessen – also dabei, besser zu verstehen, wo die Schüler:innen gerade stehen – das nennt sich Learning Analytics.

Für Schüler:innen wiederum ist KI super, um sich Inhalte einfacher aufbereiten zu lassen: Zusammenfassungen, Gliederungen, einfache Erklärungen oder auch Bildmaterial. Das erleichtert vieles.

Aber: Es ist wichtig, diese Tools aber auch kritisch zu betrachten. Man muss lernen, die Ergebnisse zu hinterfragen. Ist das korrekt, was die KI da ausspuckt? Wie kann ich die Ergebnisse möglicherweise weiter überprüfen? Ergibt das Sinn? Diese Reflexion sollte immer dazu gehören.

Learning Analytics bezeichnet die systematische Auswertung von Lerndaten der Schüler:innen. Es geht darum, Lernstände zu analysieren, Abweichungen frühzeitig zu erkennen und individuelle Lernpfade aufzuzeigen. Beispielsweise kann ein KI-gestütztes System zeigen, wenn die Leistung eines Schülers oder einer Schülerin plötzlich abfällt – vielleicht durch persönliche Probleme oder Lernschwierigkeiten. Lehrkräfte können so gezielter unterstützen. Auch adaptive Lernpfade sind möglich: Wer Schwierigkeiten hat, bekommt kleinere, passende Aufgabenpakete – bis das große Ganze bewältigt werden kann. Das Ziel: mehr (und schnellere) individuelle Förderung.

Ich musste mir damals im Studium alle Inhalte mühsam zusammensuchen – heute fragt man ein Tool. Geht da nicht auch etwas verloren?

Johannes Schäfers: Natürlich kann man sagen: Die Tools nehmen einem einiges an Arbeit ab. Aber man muss auch dazu befähigt werden, sie überhaupt sinnvoll einsetzen zu können. Und genau da sehe ich unsere Aufgabe – in der Ausbildung der angehenden Lehrkräfte. Es geht nicht nur um die bloße Anwendung, sondern um eine ganzheitliche Kompetenzentwicklung im Umgang mit KI-Tools.

Und klar ist doch: Jede Generation hatte ihre Tools. Wir hatten in den 2000ern plötzlich Computer. Vor knapp 50 Jahren gab’s das alles noch nicht. Es geht nicht darum, ob man Technik nutzt – sondern wie.

Welche Kompetenzen sind dir dabei besonders wichtig?

Johannes Schäfers: Neben dem technischen Verständnis sind mir ethische, gesellschaftliche und auch ökologische Aspekte extrem wichtig. Aspekte der Diskriminierung, des Datenschutzes aber auch der Energieverbrauch von Servern – das gehört alles dazu. Ich versuche, meinen Studierenden genau diese Perspektiven mitzugeben: Es geht nicht nur um die Technik, sondern darum, wie wir verantwortungsvoll mit ihr umgehen.

Ihr habt ein Lernangebote zum Umgang mit KI erstellt. Es geht um die Entwicklung von KI-Kompetenzen. Was sind eure Erkenntnisse bisher?

Johannes Schäfers: Was mich total begeistert: Die Studierenden in unseren Seminaren kommen mit vielen eigenen Ideen. Sie entwickeln Projekte, erproben KI in Lehrveranstaltungen und profitieren auch selbst ganz konkret. Auch leistungsschwächere Studierende sehe ich durch KI gezielt unterstützt – etwa bei der Rechtschreibung oder bei der Gliederung von Texten. Das stärkt das Selbstbewusstsein und führt oft zu besseren Ergebnissen.

Aber das funktioniert natürlich nur, wenn die Studierenden auch wissen, wie man mit KI sinnvoll umgeht. Und genau das versuchen wir zu fördern – Schritt für Schritt, ohne Überforderung, mit den Lernangeboten unseres Projekts „Kom.KI“.

Worum geht’s da genau?

Johannes Schäfers: Wir haben zwei Formate entwickelt: den „Short Track“ für Einsteiger:innen, der sich am 4-A-Modell von Prof. Dr. Doris Weßels orientiert – also Aufklären, Ausprobieren, Akzeptieren, Aktiv werden. Wir haben das Ganze um ein fünftes A ergänzt: Anlässe schaffen. Denn oft fehlt in Schulen genau das – der konkrete Anlass, um KI sinnvoll z. B. im Unterricht einzusetzen.

Dann gibt es noch den „Deep Track“ für Fortgeschrittene. Dieser vertieft das Thema – mit konkreten Beispielprojekten, die unsere Studierenden gemeinsam mit Lehrkräften unter anderem aus Hamburger beruflichen Schulen entwickelt haben. Die Ergebnisse wurden hierbei in Form von Postern aufbereitet und sind auf unserer über unsere Lernangebote öffentlich zugänglich.

Kom.KI - Kompetenzentwicklung für KI-Tools

Künstliche Intelligenz (KI) spielt für viele Bereiche unseres Lebens bereits eine wichtige Rolle. Dies zeigt sich durch die intensive Nutzung von generativer KI, zum Beispiel in Form von Textgenerierung oder verschiedenen kreativen Prozessen wie Bilderstellung, Musikkomposition oder Videoproduktion. Die Veränderungen, die KI mit sich bringt, wirken sich aber auch unmittelbar auf unsere persönliche und berufliche Bildung aus. Diese Zusammenhänge möchten wir dir gerne hier in diesem Lernmodul vermitteln. Dafür haben zahlreiche Studentinnenund Studenten in Kooperation mit beruflichen Schulen Konzepte entwickelt, wie Künstliche Intelligenz für verschiedene Akteure zum Vorteil werden kann.

Wie gut kennen sich die Studierenden mit KI aus? Gibt es da Unterschiede?

Johannes Schäfers:Ja, definitiv. Manche sind sehr Technik-affin, andere tun sich schwerer – es gibt große Unterschiede. Dazu kommen die unterschiedlichen Vorerfahrungen oder auch ungleichen Zugänge zu kostenpflichtigen Tools – das sind alles reale Stolpersteine, denen wir begegnen.

Ich bin zwar ein Fan von „einfach mal ausprobieren“, also „trial and error“, aber wir brauchen trotzdem einen begleiteten Einstieg. Nur so können die Studierenden lernen, worauf es ankommt – nicht nur technisch, sondern auch inhaltlich und praktisch damit zu arbeiten sowie ihr Erlerntes zu reflektieren.

Ihr seid auch bei der KI-Werkstatt der HOOU am 26. April. Was zeigt ihr dort?

Johannes Schäfers: Bei der KI-Werkstatt stellen wir beide Lernformate vor – und damit auch die Projektergebnisse unserer Studierenden. Uns geht’s darum, andere Lehrkräfte zu inspirieren: Schaut, was möglich ist! Findet Anlässe in eurem eigenen Schulalltag. Probiert Dinge aus, auch wenn ihr noch keine Expert:innen seid.

Denn genau das ist der erste Schritt: ins Handeln kommen. Nicht nur verstehen, sondern machen.

Wenn du an die Zukunft des Lernens denkst – welche Rolle spielt KI dabei?

Johannes Schäfers: Ich glaube KI wird nicht wieder verschwinden. Sie ist schon jetzt Teil unseres Alltags, besonders im Bildungsbereich. Und ich sehe das nicht als Problem, sondern als großartige Chance. Wichtig ist, dass wir lernen, damit umzugehen – kritisch, reflektiert und verantwortungsvoll.

Natürlich gibt es auch Risiken: KI kann halluzinieren, also falsche Informationen ausgeben. Aber wenn wir lernen damit umzugehen, können wir viel gewinnen. Studien zeigen schon jetzt: Wer mit KI arbeitet, kann manche Aufgaben schneller und besser erledigen – gerade im Bereich allgemeiner Schreibaufgaben. Die Qualität steigt, der Zeitaufwand sinkt. Das finde ich ist ein starkes Argument.

Aber: Es braucht Interesse, Neugier und die Bereitschaft, sich mit diesen Technologien auseinanderzusetzen. Nur dann kann man das Potenzial wirklich nutzen.

Über Johannes Schäfers

Johannes Schäfers M. Ed. ist seit Mai 2023 wissenschaftlicher Mitarbeiter am Institut für Berufliche Bildung und Digitalisierung an der Technischen Universität Hamburg. Zuvor war er in der Zeit von Juni 2020 bis April 2023 über das BMBF-geförderte Projekt „Leibniz works 4.0“ im Rahmen der Qualitätsoffensive Lehrerbildung als wissenschaftlicher Mitarbeiter am Institut für Berufspädagogik und Erwachsenenbildung an der Leibniz Universität Hannover beschäftigt. Sein Arbeits- und Forschungsschwerpunkt liegt in der Entwicklung und Evaluation von digitalen Lernumgebungen und der Erfassung und Förderung digitalisierungsbezogener Kompetenzen von Lehrkräften in der beruflichen Bildung.

Bild: Tirachard Kumtanom / pexels

08.04.2025 | Meena Stavesand

Gesundheits-Hacks für ein fittes Leben: Dein Toolkit gegen Verspannungen, Stress & Co.

Während in Deutschland der Krankenstand mit etwa 5 Prozent immer noch auf Rekordhöhe liegt, bieten wir dir zum Weltgesundheitstag (7. April) passende Lösungen für mehr Fitness und eine stabile Gesundheit. Bei uns findest du alltagstaugliches Gesundheitswissen: Von schnellen Übungen gegen den Computer-Nacken über smarte Ernährungstricks (ohne erhobenen Zeigefinger!) bis hin zu verständlich erklärten medizinischen Innovationen. Unsere kostenlosen Kurse machen dich fit für die gesundheitlichen Herausforderungen von heute – ohne dass du Medizin studieren musst und mit Tipps, die du in deinen Alltag einbauen kannst.

Ob Norovirus, Influenza oder psychische Leiden – der Krankenstand liegt in Deutschland mit 5,3 Prozent im Jahr 2024 auf einem fast gleichbleibend hohen Niveau. Angesichts dieser Zahlen wird der diesjährige Weltgesundheitstag besonders wichtig.

Er steht am 7. April unter dem Motto „Gesunde Anfänge, hoffnungsvolle Zukunft“ und startet eine einjährige Kampagne der Weltgesundheitsorganisation (WHO) zur Verbesserung der Mutter-Kind-Gesundheit. Diese Initiative ist dringend nötig: Trotz Fortschritten starben 2020 etwa 1.000 Frauen in der Europäischen Region an Schwangerschafts- oder Geburtskomplikationen.

Gesunde Anfänge zu schaffen bedeutet auch, Wissen zu teilen und Gesundheitskompetenz zu fördern – genau hier setzen die Lernangebote der HOOU an.

Medizin verstehen – in einfachen Worten

Mit unserem Angebot „Medizin. Online. Verstehen.“ hat das Universitätsklinikum Hamburg-Eppendorf (UKE) eine Plattform geschaffen, die komplexe Gesundheitsthemen einfach erklärt. Hier findest du leicht verständliche Videos und Texte zu Themen wie Adipositas, Schlaganfall, Diabetes oder Depressionen – ein wichtiger Baustein für einen besseren Blick auf deine Gesundheit.

Medizin. Online. Verstehen.

In diesem Lernangebot stellen wir verschiedene Erkrankungen und deren Behandlung am Universitätsklinikum Hamburg-Eppendorf (UKE) in Form von kurzen Filmen und informativen Texten auf einer projekteigenen Webseite vor.

Verspannungen ade – kleine Übungen mit großer Wirkung

Kennst du das? Nach einem langen Tag vor dem Computer ziehen Nacken und Schultern, der Kopf brummt. Mit unserem Kurs „Spielend gesund bleiben“ lernst du einfache Übungen, die wirklich helfen. Die Expert:innen der Hochschule für Musik und Theater und des UKE zeigen in kurzen Videos, wie du Verspannungen selbst lösen kannst. Diese Übungen wurden ursprünglich für Musiker:innen entwickelt, aber sie sind für uns alle ein echter Gewinn. Probier’s aus – dein Nacken wird es dir danken!

Spielend gesund bleiben

Gesundes Musizieren braucht einen gesunden Körper und wir zeigen Dir die Übungen dafür!

Die Macht der Klänge – wie Geräusche heilen können

Passend dazu entdeckst du bei „Healing Soundscapes“, wie Klänge unsere Gesundheit beeinflussen können. Hast du dich schon mal gefragt, warum manche Geräusche stressen und andere entspannen? Dieses gemeinsame Projekt des UKE und der Hochschule für Musik und Theater gibt Antworten und zeigt praktische Anwendungen. Auch für Menschen, die in Kliniken arbeiten, ist dieses Lernangebot interessant – damit die Notaufnahme bald entspannender auf die Patient:innen wirken kann.

Healing Soundscapes - DE

Healing Soundscapes sind Klangumgebungen, die durch künstlerisch und raumbezogen gestaltete Musical Soundscape Interventions (MSI) entstehen. Lerne hier, wie wir die klangliche Umgebung von Warte- und Arbeitsbereichen in Krankenhäusern gestalten, dass das Wohlbefinden von Patient:innen und Mitarbeitenden gesteigert wird.

Clever essen ohne Verzicht – so geht’s

Gesund essen im Uni-Stress oder im Büroalltag? Klingt gut, scheitert aber oft an der Praxis. Unser Kurs „Gesund durchs Studium“ der HAW Hamburg nimmt dich mit auf eine entspannte Entdeckungstour. Keine strengen Diätregeln, sondern alltagstaugliche Tipps, spannende Quizze und der Podcast „fit & fröhlich“. Hier lernst du nebenbei, wie du mit Stress besser umgehst und ein paar gesunde Gewohnheiten entwickelst.

Gesund durchs Studium

Gesund durchs Studium und noch viel weiter? Wie das gehen kann und was das bedeutet, findest du hier heraus.

Weiter geht’s mit „Nudging in der Ernährung“ – ein Kurs, der zeigt, wie kleine Veränderungen große Wirkung haben können. „Nudging“ bedeutet übrigens nichts anderes als ein freundlicher Anstupser in die richtige Richtung. Nimm die gesunden Alternativen wahr. Sie stehen meistens griffbereit.

Nudging für mehr Gesundheit und Nachhaltigkeit

Dieser Online-Kurs führt Multiplikatoren und interessierte Personen in den Einsatz von Nudging zur Förderung von Gesundheit und Nachhaltigkeit ein. Das Schulungskonzept ermöglicht eine schnelle Einarbeitung und praktische Anwendung des Gelernten. Der Kurs richtet sich an Fachkräfte und Einzelpersonen mit Interesse an Gesundheit und Nachhaltigkeit, ist kostenlos und flexibel online zugänglich. Ziel ist es, ein umfassendes Verständnis von Nudging zu entwickeln und Teilnehmende zur Anwendung im Beruf oder Alltag zu befähigen. Durch Quizzes und Übungen können Teilnehmende ihr Wissen vertiefen, mit dem Ziel, Nudging effektiv für Gesundheit und Nachhaltigkeit einzusetzen.

Diese Ernährungsangebote greifen den Kerngedanken des WHO-Mottos auf: Gesunde Anfänge schaffen wir durch informierte Entscheidungen im Alltag – jede gesunde Mahlzeit ist ein kleiner Schritt in Richtung einer hoffnungsvollen Zukunft.

Sport ohne Risiko – was du über Energiedefizite wissen solltest

Du bewegst dich gerne und regelmäßig? Super! Aber hast du schon vom relativen Energiedefizit gehört? Unser Kurzangebot „Wissenschaft kurz erklärt: das relative Energiedefizit“ der HAW Hamburg nimmt dich in nur 15 bis 20 Minuten mit in ein Thema, das nicht nur Profisportler:innen betrifft. Du erfährst, woran du erkennst, ob dein Körper genug Energie bekommt und wie du Probleme vermeiden kannst. Praktisches Wissen, das dir helfen kann, langfristig mit Freude aktiv zu bleiben.

Wissenschaft kurz erklärt: das relative Energiedefizit

Was ist das relative Energiedefizit im Sport? Hier erhältst du einen ersten Einstieg in dieses komplexe Thema.

Medizin der Zukunft – Ein Blick in die Forschung

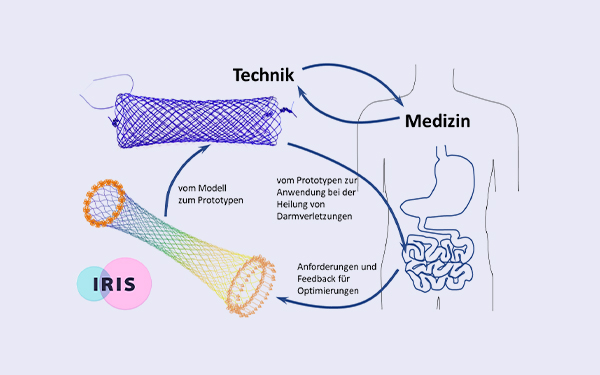

Du interessierst dich für medizinische Innovationen? Dann schau dir „IRIS – Individual Resorbable Intestinal Stents“ an, ein gemeinsames Projekt des UKE und der TU Hamburg. Der Kurs zeigt verständlich, wie spezielle Darmstents die Heilung von Darmverletzungen verbessern können. Hier bekommst du einen faszinierenden Einblick in ein Forschungsgebiet, das vielen Menschen helfen kann.

IRIS - Individual Resorbable Intestinal Stents

In diesem Lernangebot geht es um den Entwicklungsprozess von individuellen resorbierbaren Darmstents.

Medizinische Innovationen wie diese sind entscheidend für eine hoffnungsvolle gesunde Zukunft, wie sie die WHO mit ihrer Kampagne anstrebt. Sie verbessern nicht nur die Gesundheitsversorgung von Müttern und Neugeborenen, sondern aller Menschen weltweit.

Gesundheit in deinen Händen: kleine Schritte, große Wirkung

Unsere Kurse sind so vielfältig wie das Leben selbst. Ob du einfach weniger verspannt sein möchtest, deine Ernährung ohne großen Aufwand verbessern willst, bereits erkrankt bist und mehr darüber erfahren willst oder dich für medizinische Themen interessierst – bei uns findest du verständliche Informationen aus erster Hand, direkt aus der Forschung.

Triff gesunde Entscheidungen

Während die WHO mit dem diesjährigen Weltgesundheitstag den Fokus auf Mutter-Kind-Gesundheit legt, bieten wir ergänzend ein breites Spektrum an Gesundheitsthemen für jeden Alltag. Denn „Gesunde Anfänge, hoffnungsvolle Zukunft“ beginnt mit dem Wissen und den Fähigkeiten jedes Einzelnen, gesunde Entscheidungen zu treffen.

Glenn Carstens-Peters / unsplash

26.03.2025 | hoouadmin

Wissen teilen, Offenheit leben: Open Education und Open Access an der TUB

Offenheit und Bibliotheken – das passt sehr gut zusammen, findet Florian Hagen, Fachreferent für Open Access und Open Education an der Universitätsbibliothek (TUB) der Technischen Universität Hamburg. Im Rahmen der Projektförderung der HOOU an der TU Hamburg hat er 2018 sowie 2019/2020 die Projekte „Wissenschaftliches Arbeiten öffnen“ und „tub.torials“ maßgeblich gestaltet. Ein Interview von Dr. Jana Panke (TU Hamburg).

Was können wir uns unter Open Education und Open Access vorstellen?

Florian Hagen: Zum einen unterstütze ich die Forschenden an der TUB beratend. Das heißt, dass ich zum Beispiel recherchiere, in welchem Journal der Artikel veröffentlicht werden könnte oder welche Publikationsalternativen zur Verfügung stehen. Außerdem berate ich rund um urheberrechtliche Fragen: Was ist zu beachten, wenn ich eigene Fotos in meinem wissenschaftlichen Beitrag nutzen möchte? Und natürlich muss ich den aktuellen Forschungsstand zu „Open Access“ kennen. Das ist, grob beschrieben, die eine Seite meiner Stelle.

Für den Bereich „Open Education“ muss ich etwas mehr ausholen. Von der TUB bieten wir das Seminar „Wissenschaftliches Arbeiten“ an. Hier haben wir deutlich mehr Anmeldungen als Seminarplätze. Auf 30 Plätze kommen ca. 100 bis 200 Anmeldungen pro Semester. Hieraus ist die Idee zum Projekt „Wissenschaftliches Arbeiten öffnen“ entstanden. Dieses wurde 2018 von der HOOU gefördert. Im Rahmen des Projektes ist auch die Idee für ein Blog entstanden, um Inhalte aus dem Seminar nach außen zu tragen. Im Seminar wird eine komplette wissenschaftliche Arbeit verfasst.

Auf diese möchten wir auch Feedback geben. Viele Studierende haben bis zu diesem Zeitpunkt noch keine wissenschaftliche Arbeit geschrieben – in vielen technischen Fächern stehen zunächst unter anderem eher Laborbücher, technische Berichte oder auch Dokumentationen im Vordergrund. Daher spielen wir das wissenschaftliche Arbeiten und Schreiben einmal von A bis Z durch. So versuchen wir den Druck für Studierende, für die zukünftige wissenschaftliche Karriere oder eben oft in dem Fall die Abschlussarbeit, zu nehmen, damit sie sich sicherer in ihrem zukünftigen Forschungsfeld fühlen.

Wie definierst du Open Access und Open Education?

Florian Hagen: Bei Open Access würde ich von der wissenschaftlichen Kommunikationsarbeit oder vom wissenschaftlichen Publizieren sprechen. Und dies bedeutet nicht, dass Dokumente, also beispielsweise ein Beitrag in einer Fachzeitschrift, einfach nur als PDF-Dokument zum Herunterladen ins Internet gestellt werden, sondern dass es zum Beispiel auch eine eindeutige Lizenz zu diesem Dokument gibt. So ist dann direkt klar, welche Nutzung mir von Seiten der Autor:innen erlaubt ist. Hier sind die CC-Lizenzen immens wichtig. Und Open Access erleichtert dahingehend natürlich die Forschung.

Open Education oder auch offene Bildung ist für mich eine Bildungspraktik, bei der in meinem Fall vor allem Lehrende und Studierende (und mittlerweile auch Kolleg:innen und einfach interessierte Menschen aus völlig anderen Arbeitsbereichen) frei zugängliche, lizenzierte Materialien nutzen, um auf neue (bzw. mittlerweile einfach andere) und spannende Weise mit Lerninhalten zu interagieren. Natürlich ist ein großer Aspekt, dass Menschen, wo immer sie auch sind, ohne oder mit möglichst geringen Barrieren konfrontiert werden, wenn sie lernen bzw. sich weiterbilden möchten. Das ist mir wichtig.

Im Mittelpunkt offener Bildung stehen oftmals die offene Bildungsressource selbst. Spannend finde ich aber auch den Blick über diese frei lizenzierten Ressourcen hinaus auf Themen wie Kollaboration bei offener Bildung und damit verbundenen Fragen wie „Hat schon jemand anders etwas zu einem Thema gemacht und könnte man darauf aufbauend ggf. zusammenarbeiten oder die Idee für den eigenen Kontext anpassen?“. Ebenso eröffnet die Möglichkeit, durch offenes Feedback OER-Elemente zu optimieren, neue Perspektiven.

Was bedeutet Offenheit für dich?

Florian Hagen: Grundsätzlich bedeutet Offenheit für mich, dass ich verschiedene Perspektiven berücksichtige und nicht nur in der gewohnten (Informations-)Umgebung bleibe, weil ich mich dort wohlfühle. Zum Beispiel, wenn es konstruktive Ideen zu einer Herausforderung gibt, dann bedeutet Offenheit für mich, dass ich reflektiere, ob diese Idee mich weiterbringen kann. Oder auch, dass ich ein Ohr dafür habe, mit welchen Themen sich andere Personen beschäftigen, wie sie an Dinge herangehen und auch in den Austausch zu gehen, um zu schauen, ob dies meiner eigenen Arbeit zugutekommen könnte.

Kurz gesagt: die eigenen Scheuklappen abnehmen und in Verbindung mit lebenslangem Lernen ein Bewusstsein dafür entwickeln, dass die Welt nicht stehenbleibt.

Das Thema Offenheit an sich im Zusammenhang mit Open Education finde ich auch spannend. Für mich war das anfangs ein größerer Umgewöhnungsprozess. Ich verstecke meine Lehr-Lernmaterialien und Ideen nicht mehr in meiner Schublade, bis sie nach unzähligen Überarbeitungsversuchen im engen Rahmen genutzt werden können. Irgendwann müssen sie raus. Und zwar so, dass sie auch wirklich möglichst leicht nachgenutzt und eventuell angepasst oder verbessert werden können.

Wie passen Bibliotheken und Offenheit zusammen?

Florian Hagen: Bibliotheken stehen in meinen Augen traditionell für den freien Zugang zu Wissen. Durch die vielen Entwicklungen in der digitalen Welt erlebt dieses klassische Prinzip unter anderem mit Open Access, Open Source und Open Data seit vielen Jahren ein Revival. Wenn wir in unserem Fall auf die TUB schauen, so gibt es hier seit vielen Jahren Bemühungen um verschiedene Openness-Entwicklungen. Seit 2002 wird für die Unterstützung der Forschung über die Universitätsbibliothek Open-Access-Repository TORE angeboten und seit vielen Jahren gibt es einen Publikationsfonds.

Die TUB engagiert sich auch regelmäßig bei vielen Projekten rund um Openness. Im Rahmen des Hamburg Open Science-Programmes beteiligte sich die Universitätsbibliothek unter anderem am Projekt „Modernes Publizieren“, in welchem eine Prozesskette entwickelt wurde, die zum Beispiel einerseits das gemeinsame Schreiben in einer Forschungsgruppe unterstützt, andererseits andere Wege beim Peer-Review-Prozess geht und zugleich eine Publikation in einem Open-Access-Journal ermöglicht. Ein wichtiger Baustein war hier auch Open-Source-Software wie das GitLab der TUHH.

Und im Rahmen der Projektförderung der HOOU an der TUHH wurden auch zwei Projekte sehr erfolgreich durchgeführt, deren Ergebnisse heute noch in verschiedener Form fester Bestandteil des Serviceangebots der Bibliothek sind. Zum einen das vorhin erwähnte und sehr nachgefragte NTA-Seminar zum wissenschaftlichen Arbeiten an der TUHH und zum anderen das nach wie vor regelmäßig bespielte Blogangebot tub.torials.

Darüber hinaus bieten Bibliotheken natürlich grundsätzlich Zugang zu einer breiten Palette von Informationen, unabhängig von politischen, wirtschaftlichen oder ideologischen Interessen, um so letztlich eine informierte und offene Gesellschaft und Kultur zu fördern. Dies zeigt sich auch in der Öffentlichkeitsarbeit, wo unter anderem auch die Beteiligung an nationalen und internationalen Initiativen und Events wie der jährlichen Open Access Week eine Rolle spielt, um den offenen Austausch von Wissen und Ideen zu fördern. Das sollen nur einige Beispiele sein, die auch dazu führten, dass der Einsatz der TUB mit dem Open Library Badge ausgezeichnet wurde und die aufzeigen, dass Bibliothek und Offenheit einfach zusammengehört.

tub.torials - Gedanken, Ideen und Materialien zu Offenheit in Forschung und Lehre

tub.torials widmet sich in Textform und über interaktive Elemente dem Thema Offenheit im Kontext von Wissenschaft, Forschung sowie Lehre.

Du hast gerade die beiden HOOU-Projekte erwähnt. Beschreibe sie gerne einmal in deinen Worten.

Florian Hagen: Das erste Projekt war 2018 „Wissenschaftliches Arbeiten öffnen“, durch das ich auch an die TUB kam. Das zweite Projekt war 2019 und 2020 das Blog tub.torials.

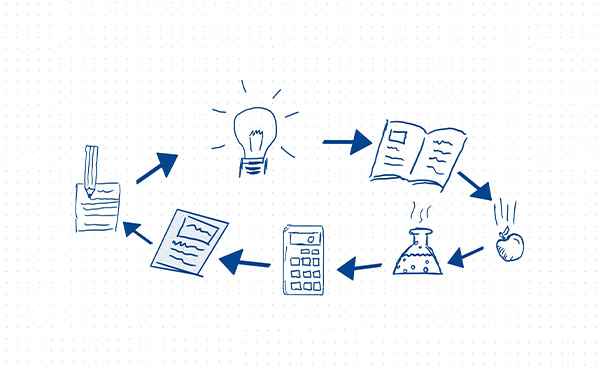

Im Projekt „Wissenschaftliches Arbeiten öffnen“ wurde ein neues Seminarkonzept erarbeitet, dass das seit 2013 angebotene Seminar „Wissenschaftliches Arbeiten“ didaktisch und inhaltlich im Hinblick auf die Entwicklungen im Wissenschaftsbereich auffrischte und Inhalte aus dem Seminar für alle Interessierten zugänglich machte.

Natürlich hat das Seminar weiterhin als roten Faden den idealtypischen Prozess von der Ideenfindung und Recherche, über den Schreibprozess bis hin zur Publikation und der Präsentation der Arbeitsergebnisse. Daran haben wir nichts geändert. Open Access und Entwicklungen in der wissenschaftlichen Publikationslandschaft sind inzwischen aber große Themen geworden, die wir auch im Seminar behandeln.

Auf dem Blog „tub.torials“ werden regelmäßig offene Bildungsmaterialien rund um den Life-Cycle wissenschaftlicher Kommunikation veröffentlicht. Der Schwerpunkt des Angebots ist die Bereitstellung von OER, die auch in den Serviceangeboten der TUB, wie zum Beispiel Beratungsgespräche und Seminare zum wissenschaftlichen Arbeiten, zum Einsatz kommen.

Außerdem werden im Blog auch Ideen, Erlebnisse und Erfahrungen aus dem Arbeitsalltag offen festgehalten. Hierzu gehören zum Beispiel Berichte von besuchten Veranstaltungen oder auch Erfahrungen mit verschiedenen Anwendungen und Workflows.

Aus beiden HOOU-Projekten ist in Kooperation mit dem bereits erwähnten Hamburg Open Science Projekt „Modernes Publizieren“ die Veröffentlichung „Mehr als 77 Tipps zum wissenschaftlichen Arbeiten“ entstanden. Und das finde ich klasse, dass es Schnittpunkte zwischen den Projekten gab, genauso wie es Berührungspunkte in meiner Arbeit gibt: zwischen der offenen Wissenschaft und den offenen Lehr- und Lernmaterialien.

Und hier wären wir wieder beim Thema Openness: damit gibt es eine Art Flexibilität. Man findet etwas, findet das total gut, obwohl es aus einem anderen Anwendungskontext stammt, und kann es dann durch das Remixen auf die eigenen Bedürfnisse anpassen. Dadurch entsteht auch häufig ein spannender Austausch und man kann voneinander lernen. Wo wir nun wieder beim Stichwort des lebenslangen Lernens wären, denn genau das ist es ja.

Ein paar Beispiele dazu: wir haben an der TUB viele Erfahrungsberichte und Anleitungen zu Literaturverwaltungsprogrammen verfasst. Und wir haben immer wieder interessierte Gäste aus dem Ausland, die diese gerne an ihrer Bibliothek nutzen und anbieten möchten. Durch die offene Lizenzierung stellt dies kein Problem dar und die Texte müssen nur noch übersetzt werden, was heutzutage mit KI-Unterstützung auch schnell geht. Und so machen dann die Materialien ihre Runden. Manchmal erhält man eine Rückmeldung zur Nutzung, manchmal auch nicht.

Um noch ein Beispiel zu nennen: wir hatten versucht, den Begriff Open Science bildlicher darzustellen und haben den Open Science Regenschirm entworfen. Hier haben wir viele Rückmeldungen zur Weiternutzung erhalten – das freut einen natürlich immer! Oder auch, dass ich auf Tagungen über Remixe von unseren Veröffentlichungen aufmerksam werde. Und konstruktives Feedback oder Verbesserungsvorschläge zu den Materialien, sei es von Kolleg:innen oder auch Studierenden, sehe ich als Geschenk.

Was hast du selbst durch deine HOOU-Projekte gelernt und für deine tägliche Arbeit mitgenommen?

Florian Hagen: Das erste, was mir bei dieser Frage in den Sinn kommt ist, dass ich viele tolle Leute kennengelernt habe. Menschen, mit denen ich gerne rede und mit denen ich gerne zusammenarbeite. Menschen, die mir vorgelebt haben und vorleben, dass es gut ist offen für Vieles zu sein. Für andere Perspektiven auf Dinge und Meinungen, für konstruktives Feedback, aber auch dafür, immer wieder aus der eigenen Komfortzone einen Blick über den Tellerrand zu werfen. Auch wenn man also zum Beispiel seine geliebten Tools und Arbeitswerkzeuge im Arbeitsalltag hat, lohnt es sich Alternativen auszuprobieren. Mal, um einen anderen Blick auf etwas zu gewinnen. Mal, um perspektivisch auf sich dynamisch entwickelnde Arbeitsprozesse auch flexibel reagieren zu können und nicht zu sehr in den eigenen Gewohnheiten festzustecken.

Ich glaube, im Rahmen der HOOU fielen in der einen oder anderen gemeinsamen Projektrunde die Begriffe „Toolbox“ und „survival kit“. Zu meinem „survival kit“ zählen für mich neben einigen digitalen Werkzeugen die Kolleg:innen, mit denen man sich einfach mal gegenseitig Gedanken und Ideen zuwerfen kann, um voranzukommen. Dafür fand ich auch den HOOU-Hackerspace immer sehr schön.

Kannst du die beiden HOOU-Projekte in wenigen Worten beschreiben?

Florian: Ich versuche es: Türöffner, Vernetzung, Offener Blick und Reflexionswerkzeug.

Was ist dein Wunsch für die nächsten 10 Jahre HOOU@TUHH?

Florian: Ein jahresübergreifender Ideenaustausch mit allen ehemaligen HOOU-Projekten wäre schön!

Über Florian Hagen

Florian Hagen absolvierte zunächst eine Ausbildung zum Fachangestellten für Medien- und Informationsdienste (FaMI) und erwarb im Anschluss einen Bachelorabschluss im Bereich Bibliotheks- und Informationsmanagement. Darauf folgte ein Masterstudium in Information, Medien, Bibliothek (IMB). Sein Fokus liegt auf den Themen Open Access, Open Education und Literaturverwaltung. Zudem ist er aktuell für die Ausbildungskoordination an der TUB zuständig.

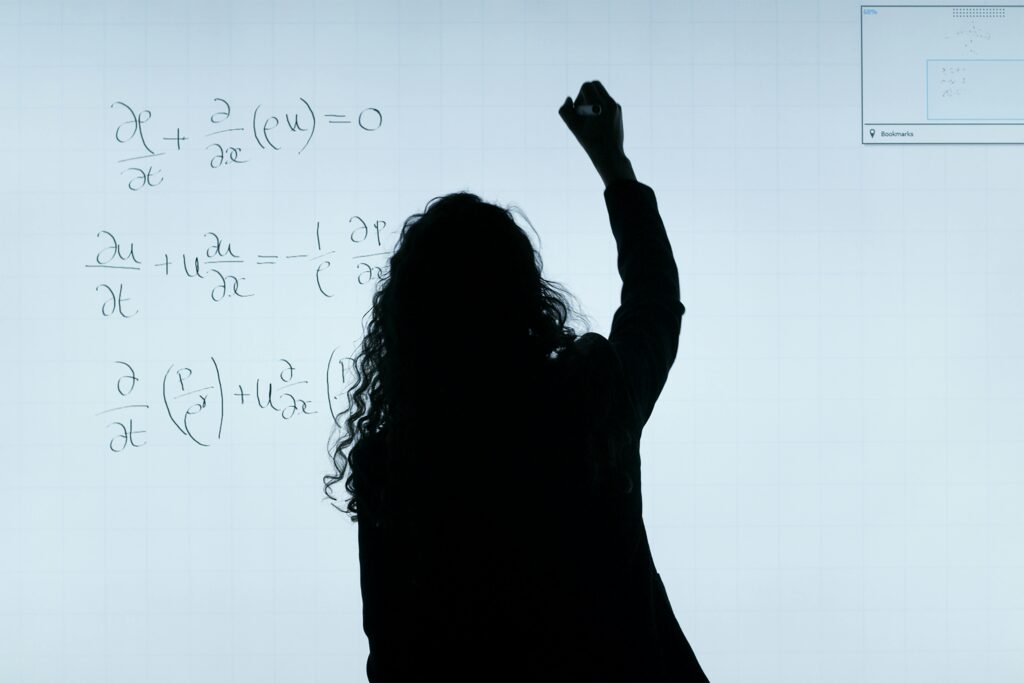

Bild: ThisIsEngineering

14.03.2025 | Meena Stavesand

Gleichstellung in der Wissenschaft: Parität erst 2064?

Von Dorothea Christiane Erxlebens mutiger Promotion im 18. Jahrhundert bis zu den aktuellen Zahlen von nur 29 Prozent Professorinnen – unser Abschlussartikel zum Weltfrauentag blickt auf historische Vorbilder, aktuelle Herausforderungen und notwendige Veränderungen für eine echte Gleichstellung in Forschung und Lehre. Es geht um brillante Wissenschaftlerinnen, hartnäckige Widerstände und die Frage, warum wissenschaftlicher Fortschritt Vielfalt braucht – und wie lange wir noch auf Parität warten müssen.

Der Weltfrauentag am 8. März erinnert uns jedes Jahr daran, dass Gleichberechtigung kein Relikt vergangener Kämpfe ist, sondern eine lebendige Aufgabe bleibt. Seit Clara Zetkin 1911 den ersten internationalen Frauentag ins Leben rief, hat sich viel verändert – aber nicht genug. In der Wissenschaft spiegelt sich diese Entwicklung wie unter einem Brennglas wider: Beeindruckende Forschung steht neben großen Herausforderungen.

In unserer Serie zum Weltfrauentag haben wir eine Woche lang die Geschichten mutiger Wissenschaftlerinnen erzählt, ihre Durchbrüche und die Hürden, die sie überwinden mussten – und teilweise noch immer müssen – geschildert. Zum Abschluss dieser Reihe werfen wir einen umfassenden Blick auf dieses facettenreiche Thema.

Die Wegbereiterinnen: Mit Leidenschaft gegen Widerstände

Die Geschichte von Frauen in der Wissenschaft ist geprägt von außergewöhnlichem Mut. Dorothea Christiane Erxleben stellte sich Mitte des 18. Jahrhunderts gegen nahezu unüberwindbare gesellschaftliche Widerstände.

Sie praktizierte als Ärztin ohne formalen Abschluss und musste sich dafür sogar vor Gericht verantworten. Erst mit Unterstützung ihres Bruders und des preußischen Königs Friedrich des Großen konnte sie in Halle promovieren – ein Meilenstein, der bewies: Barrieren können fallen, wenn der Wille stark genug ist. Allerdings gilt das auch nicht immer, wie die Geschichte von Emmy Noether beweist – etwa 150 Jahre später:

Als erst zweite Frau in Deutschland promovierte Emmy Noether 1907 in Mathematik. Trotz eines formellen Verbots von 1908 versuchte sie, ihre Habilitation einzureichen. Der Mathematiker David Hilbert kämpfte für sie, doch offizielle Positionen blieben ihr verwehrt.

Der preußische Minister schrieb damals: „Die Zulassung von Frauen zur Habilitation als Privatdozent begegnet in akademischen Kreisen nach wie vor erheblichen Bedenken. Da die Frage nur grundsätzlich entschieden werden kann, vermag ich auch die Zulassung von Ausnahmen nicht zu genehmigen, selbst wenn im Einzelfall dadurch gewisse Härten unvermeidbar sind.“

Oft hielt Noether ihre Vorlesungen deswegen unter Hilberts Namen. Nach jahrelangem Ringen wurde ihr wegweisender Beitrag zur Abstrakten Algebra endlich anerkannt – heute gilt sie als Pionierin einer ganzen Epoche.

Dass Frauen in der Wissenschaft oft im Schatten standen, zeigt auch Rosalind Franklins Geschichte: Sie bewies als Biochemikerin und Spezialistin für Röntgenstrukturanalyse mit dem Foto 51 die Doppelhelix unser DNA. Den Nobelpreis bekamen allerdings zwei Männer: James Watson und Francis Crick, obwohl deren Forschung auf Rosalind Franklins Arbeiten beruhte. Ihr Anspruch erlosch mit ihrem frühen Tod 1958, da der Nobelpreis nicht posthum verliehen wird. Sie starb an Krebs – möglicherweise eine Auswirkung ihrer Arbeit mit Röntgenstrahlen.

Diese drei Biografien zeigen, wie hart der Kampf um wissenschaftliche Anerkennung in den vergangenen Jahrhunderten und Jahrzehnten war. Sie beweisen auch, dass bedeutende Fortschritte oft dann entstehen, wenn Frauen gegen strukturelle Widerstände angehen und gleichzeitig neue Denkweisen etablieren.

Gegenwart: Zwischen Fortschritt und Stillstand

Die heutige Situation zeigt ein gemischtes Bild. Es gibt messbare Fortschritte, aber auch Unterschiede:

- Der Frauenanteil in wissenschaftlichen Führungspositionen stieg von 13,5 Prozent (2013) auf 24,2 Prozent (2023).

- Über die Hälfte (52,3 Prozent) der Studienanfänger:innen waren 2022 weiblich – ein ausgeglichenes Verhältnis auf der Einstiegsstufe.

- Nur 29 Prozent der Professuren in Deutschland sind mit Frauen besetzt (2023).

Klassische Rollenbilder beeinflussen nach wie vor viele Karriereverläufe. Frauen übernehmen überdurchschnittlich viel unbezahlte Care-Arbeit, was ihre Zeit für Forschung und Publikationen einschränkt.

Es braucht Chancengleichheit – sowohl strukturell als auch in den Köpfen der Menschen.Katrin Bock, TU Hamburg

Der sogenannte Gender Publication Gap belegt: Wissenschaftlerinnen veröffentlichen tendenziell weniger Artikel als ihre männlichen Kollegen. Jede zweite Forscherin berichtet zudem von Fällen, in denen ihr Beitrag schlichtweg übersehen wurde.

„Es braucht Chancengleichheit – sowohl strukturell als auch in den Köpfen der Menschen!“ Dieses Zitat von Katrin Bock, wissenschaftliche Mitarbeiterin an der TU Hamburg, bringt es auf den Punkt. Gleichzeitig ist vor allem eins wichtig, wie Dr. Sophie Heins, wissenschaftliche Mitarbeiterin an der HafenCity Universität verdeutlicht: „Im Design und der Designforschung ist Vernetzung entscheidend, um Frauen sichtbarer zu machen“, antwortet sie auf die Frage, was es braucht, damit Frauen in dem eigenen Fachbereich noch stärker wirken können und sichtbarer werden.

Der Weg zur echten Gleichstellung: Parität erst 2064?

Der Glass Ceiling Index belegt weiterhin eine gläserne Decke zwischen Promotion und Professur. Obwohl der Frauenanteil bei Promotionen deutlich gestiegen ist, bleibt er bei den höchsten Professuren weit zurück:

„Wenn der Frauenanteil an den höchsten Professuren in gleicher Weise wie seit 1992 wachsen würde, wäre eine Parität im Jahr 2064 erreicht (…). Auch wenn das etwas schnellere Wachstum der letzten 10 Jahre zugrunde gelegt würde, wäre eine Parität erst 2057 erreicht“, heißt es in der Bilanz „30 Jahre Geschlechtergleichstellung in der Wissenschaft“.

29

Prozent der Professuren sind in Deutschland mit Frauen besetzt.

Die Vereinbarkeit von Wissenschaft und Familie bleibt ein zentrales Thema – auch unter Wissenschaftlerinnen: „In der Wissenschaft braucht es mehr Frauen in Führungspositionen, um Veränderung zu bewirken und junge Wissenschaftlerinnen zu inspirieren“, sagt Dr. Franziska Miegel, psychologische Psychotherapeutin am Universitätsklinikum Hamburg-Eppendorf.

Von mehr Flexibilität und der Anerkennung von Care-Arbeit würden jedoch alle Forschenden profitieren. Wenn dieses Umdenken gelingt, müsste niemand mehr zwischen Familie und Karriere wählen.

Ausblick: Was die Zukunft bringen muss

Die Gemeinsame Wissenschaftskonferenz hat die Förderung von Frauen in Wissenschaft und Forschung als wichtiges Querschnittsthema definiert. Damit sind die Grundlagen für Veränderung geschaffen. Was jetzt folgen muss, sind konkrete Maßnahmen wie etwa:

- Strukturelle Reformen zur Förderung von Frauen auf allen Karrierestufen

- Ein kultureller Wandel, um starre Denkmuster aufzubrechen

- Ausgebaute Mentoring- und Vernetzungsangebote

- Mehr Sensibilität für Care-Arbeit und faire Arbeitsbedingungen

Die Zahlen belegen, dass wir Fortschritte machen – aber das Tempo könnte schneller sein. Dass eine positive Entwicklung stattfindet, ist sicherlich auch dem unbeugsamen Engagement jener Frauen zu verdanken, die sich nicht abschrecken ließen: von Dorothea Christiane Erxleben über Rosalind Franklin bis hin zu Emmy Noether. Sie haben bewiesen, dass herausragender Forschungsgeist weder einem Geschlecht noch bestimmten Rollenmustern untergeordnet ist.

Lange hielt die Welt an dem Irrglauben fest, Frauen fehle es an Kreativität und Fähigkeiten. Diese Vorstellung ist falsch, und sie zu widerlegen motiviert uns, sichtbarer und einflussreicher zu werden.Tam Thi Pham, Hochschule für Musik und Theater

Mehr Mut, mehr Gleichberechtigung, mehr Sichtbarkeit

Der Weltfrauentag mahnt uns jedes Jahr aufs Neue, nicht nachzulassen. Er erinnert aber auch daran, wie viel Frauen schon erreicht haben – gerade in der Wissenschaft. Tam Thi Pham, Komponistin, Improvisateurin und Projektkoordinatorin an der Hochschule für Musik und Theater fasst daher treffend zusammen: „Lange hielt die Welt an dem Irrglauben fest, Frauen fehle es an Kreativität und Fähigkeiten. Diese Vorstellung ist falsch, und sie zu widerlegen motiviert uns, sichtbarer und einflussreicher zu werden.“

19.02.2025 | dorothee.schielein@tuhh.de

4228.10: Gesine Liese – Kinderforscher und Kniffelix

Stephan Dublasky spricht mit Gesine Liese, die Gründerin der Kinderforscher an der TU Hamburg. Es geht nur um das Projekt Kniffelix das zu den „Early Birds“ der HOOU an der TU Hamburg gehörte. Wir bekommen Einblicke in die Experimente von Kniffelix und warum die Kinderforscher gegründet wurden. Ein Rückblick auf 10 Jahre HOOU an der TU Hamburg.

19.02.2025 | dorothee.schielein@tuhh.de

4227.10: Lars Schmeink – Zukunft neu denken

Wie können wir uns andere Welten, andere Formen des Miteinanders, des Lernens und Arbeitens vorstellen? Diesen Fragen geht der Science-Fiction- und Fantastikforscher Dr. Lars Schmeink nach. In der HOOU hat er von 2018 bis 2020 die Projekte “SciFiVisions” und “Zukunft | Gesellschaft | Technologie” entwickelt und umgesetzt, letzteres zusammen mit Axel Dürkop, der auch das Gespräch geführt hat.

Foto: Stephan Dublasky

18.02.2025 | dorothee.schielein@tuhh.de

4226.10: Ruth Schaldach – RUVIVAL Universum

Die Projektleiterin der ersten Stunde, Dr. Ruth Schaldach, entwickelte mit ihrem großen, internationalen Team aus studentischen und wissenschaftlichen Mitarbeiter*innen das bis heute umfangreichste Lernangebot der HOOU: RUVIVAL. In unserem Gespräch blicken wir zurück auf 10 Jahre produktive Zusammenarbeit.

18.02.2025 | dorothee.schielein@tuhh.de

4225.10: Stephan Dublasky und Dorothee Schielein – Rollentausch

Seit Oktober 2018 begeistert der „Podcast 42“ seine Zuhörer*innen mit spannenden und unterhaltsamen Episoden, die Antworten auf (fast) alle Fragen liefern. Ursprünglich als Trio gestartet, sind heute Dorothee Schielein und Stephan Dublasky die Köpfe und Stimmen hinter dem Wissenschaftspodcast. In „Podcast 42“ erhalten die Hörer*innen nicht nur spannende Einblicke in die Projekte der Hamburg Open Online University (HOOU), sondern lernen auch die faszinierenden Lebensgeschichten der Gäste kennen. Zu Beginn jeder Folge stellt ein mitgebrachtes Geräusch einen ersten Bezug zur Arbeit der eingeladenen Person her, was sofort Neugierde weckt und zum Mitraten einlädt. In der exklusiven Jubiläumsfolge anlässlich des 10-jährigen Bestehens der HOOU an der TU Hamburg haben wir das Format auf den Kopf gestellt: Dr. Jana Panke, Teamleiterin und Projektkoordinatorin der HOOU@TUHH, übernimmt die Rolle der Gastgeberin und interviewt Dorothee Schielein und Stephan Dublasky. In dieser besonderen Episode geht es um nicht-lineare Lebensläufe, typische Geräusche und natürlich die Geschichte und Hintergründe des Podcast 42.

Foto: Gerd Altmann / Pixabay

12.02.2025 | Meena Stavesand

"Wissenschaft lebt von Perspektivenvielfalt und Interdisziplinarität"

Prof. Dr. Maren Baumhauer ist seit Februar neues Mitglied im HOOU-Aufsichtsrat. Anlässlich des internationalen Tags der Frauen und Mädchen in der Wissenschaft gibt sie Einblicke in die Zukunft des Wissenschaftssystems. Sie betont, dass echter Fortschritt nur durch fachübergreifende Zusammenarbeit und multiprofessionelle Teams entstehen kann.

Prof. Baumhauer setzt sich für transparente Bildungsangebote ein und macht mit innovativen Projekten wie dem „Navigator für KI-Einsteiger“ Wissenschaft für alle zugänglich. Dabei unterstreicht sie die Bedeutung einer offenen Wissenschaftskultur, die nicht nur den technologischen Fortschritt vorantreibt, sondern auch das gesellschaftliche Vertrauen in die Forschung stärkt.

Was macht Wissenschaft für unsere Gesellschaft so wertvoll und wie bereichert uns die Vielfalt der Perspektiven in der Forschung?

Prof. Dr. Maren Baumhauer: Meines Erachtens liegt gerade die Zukunft unseres Wissenschaftssystems in der Interdisziplinarität und einer Perspektivenverschränkung unterschiedlichster Forschungsansätze und -strategien begründet. Sicherlich ist der Aspekt der Selbstbehauptung und Anerkennung, gerade wenn es um das „eigene“ Gegenstandsinteresse einer Disziplin geht wichtig.

Ein „echter“ Fortschritt – im Sinne eines konkreten Mehrwerts für die Gesellschaft – lässt sich aus meiner Sicht aber nur mit einem „Blick über den eigenen Tellerrand“ und über die Zusammenarbeit in multiprofessionellen Teams erzeugen. Wenn ich den Wert von Wissenschaft an bestimmten Kategorien festmachen müsste, würde ich vor allem den Erkenntnisgewinn, den technologischen Fortschritt und die Innovation, ihren kulturellen Beitrag und die Weiterentwicklung der Gesellschaft sowie die offenen Bildungsmöglichkeiten für Individuen herausstellen.

Der Internationale Tag der Frauen und Mädchen in der Wissenschaft (englisch: International Day of Women and Girls in Science) wird jedes Jahr am 11. Februar begangen und wurde erstmals 2016 offiziell gefeiert. Ausgerufen von den Vereinten Nationen, soll dieser Tag auf die nach wie vor bestehenden Ungleichheiten in wissenschaftlichen Disziplinen aufmerksam machen. Ziel ist es, die volle und gleichberechtigte Teilhabe von Frauen und Mädchen in den Bereichen Wissenschaft, Technik, Ingenieurwesen und Mathematik zu fördern. Gleichzeitig erinnert der Tag daran, dass Diversität und Chancengleichheit entscheidend sind, um Innovationen voranzutreiben und globale Herausforderungen zu meistern.

Wie können wir die Wissenschaftswelt offener und zukunftsfähiger gestalten?

Prof. Dr. Maren Baumhauer: Ein „offenes“ Konzept von Wissenschaft und Bildung hat aus meiner Sicht eine hohe Bedeutung für die Zusammenarbeit in Bildungsorganisationen und den Austausch von Wissen. Gemeinsam Wissensstrukturen zu erzeugen, zu teilen und voneinander zu profitieren ist für die kollektive und individuelle Kompetenzentwicklung im Kontext von Arbeit, Beruf und Bildung enorm wichtig.

Ein weiterer zentraler Punkt ist aus meiner Perspektive das gesellschaftliche Vertrauen in die Wissenschaft zu stärken. Transparente Bildungsangebote und der freie Zugang zu wissenschaftlich basierten Bildungsmaterialien können dazu einen wichtigen Beitrag leisten. Genau diese Punkte sehe ich in den Bildungsinitiativen und offenen Lernangeboten der HOOU realisiert.

Ein aktuelles Beispiel ist der „Navigator für KI-Einsteiger“, den ich zusammen mit meinem Team konzipiert habe. Künstliche Intelligenz (KI) ist längst Teil unserer Bildungsrealität geworden. Unser Lernangebot richtet sich an alle Bildungsinteressierten und bietet neue Impulse, sich Schritt für Schritt dem Thema KI anzunähern, um ihre Möglichkeiten und Grenzen zu reflektieren.

Schritt für Schritt: Ein Navigator für KI-Einsteiger

Künstliche Intelligenz (KI) hat sich inzwischen zu einem integralen Bestandteil unseres Alltags entwickelt. Mit innovativen KI-Tools wie ChatGPT, DALL-E oder Gemini ist es möglich, Texte zu erstellen, Bilder zu generieren, Musik zu komponieren und komplexe Probleme zu lösen.KI bietet zahlreiche Chancen, bringt jedoch auch Herausforderungen und Risiken mit sich. Daher ist es von Bedeutung, sich aktiv mit diesem Thema auseinanderzusetzen, um die Möglichkeiten und Grenzen dieser technischen Entwicklung zu verstehen.Unser Lernangebot zeigt dir einen Weg auf, wie du dich Schritt für Schritt mit dem Thema KI vertraut machen kannst.

Was hat in Ihnen die Begeisterung für die Wissenschaft geweckt und welchen Rat möchten Sie jungen Menschen geben, die eine wissenschaftliche Laufbahn erwägen?

Prof. Dr. Maren Baumhauer: Wissenschaftlich zu arbeiten bedeutet für mich absolute Freiheit und kreative Entfaltungsmöglichkeit im Rahmen meiner beruflichen Tätigkeit. Das ist eine großartige Chance, die das Wissenschaftssystem für junge Menschen bietet. Herausfordernder war und ist es, geeignete Rahmenbedingungen im Kontext andauernder Befristung zu schaffen, um weder Energie noch Muße für die wissenschaftlichen Qualifizierungsphasen zu verlieren.

Für die Bewältigung dieser Phasen bedarf es eines zielgerichteten Ressourceneinsatzes, um sein Ziel nicht aus den Augen zu verlieren. Absolut wichtig ist für mich darüber hinaus die Entwicklung von Ambiguitätskompetenz im Wissenschaftssystem, die sich auf den Umgang mit Unsicherheiten und auch Mehrdeutigkeiten bezieht. Eine offene Haltung im Umgang mit Widersprüchen, unterschiedlichen Perspektiven und Erklärungsansätzen ist dafür unerlässlich.

Über Prof. Dr. Maren Baumhauer

Prof. Dr. Maren Baumhauer ist Juniorprofessorin für Berufliche Bildung und Digitalisierung am Dekanat T (Technologie und Innovation in der Bildung) an der TU Hamburg. Nach dem Studium der Erziehungswissenschaften (Dipl.-Päd.) an der Universität Trier mit den Nebenfächern Soziologie und Psychologie, Studienrichtung Weiterbildung, folgten Stationen als Wissenschaftliche Mitarbeiterin an der Universittät Trier und der Leibniz Universität Hannover.

Ihre Promotion legte Baumhauer in Berufspädagogik ab. Titel ihrer Dissertation: Berufsbezug und Wissenschaftsorientierung – Grundzüge einer Didaktik wissenschaftlich reflektierter (Berufs-)Praxis im Kontext der Hochschulweiterbildung. Seit 2023 forscht und lehrt sie an der TU Hamburg.

Bild: sasint / Pixabay

24.01.2025 | Meena Stavesand

Wissen als Schlüssel: Wie lebenslanges Lernen unsere Welt verändert

Der demografische Wandel stellt unsere Gesellschaft vor große Herausforderungen. Angesichts einer alternden Bevölkerung, einer immer vielfältiger werdenden Gesellschaft und der rasanten Veränderungen in der Arbeitswelt gewinnt das Konzept des lebenslangen Lernens zunehmend an Bedeutung. Anlässlich des internationalen Welttages der Bildung (24. Januar) zeigen wir, wie wir, die Hamburg Open Online University als Wissensplattform, auch den gesellschaftlichen Zusammenhalt fördern.

Für uns spielt lebenslanges Lernen eine Schlüsselrolle bei der Integration verschiedener Bevölkerungsgruppen, bei der Sicherung von Arbeitsplätzen in Zeiten des technologischen Wandels und bei der Förderung des Zusammenhalts zwischen Jung und Alt.

In einer Welt, in der sich Berufe und Qualifikationen ständig verändern, müssen Menschen bereit sein, ihr Wissen stetig zu erweitern. Um das zu ermöglichen und zu fördern, braucht es faktenbasierte und qualitativ wie didaktisch erstklassige Bildungsangebote für alle. Der Zugang dazu muss niederschwellig und barrierearm sein.

Unterstützung für Menschen in jeder Lebensphase

Plattformen wie die HOOU als Verbundeinrichtung der Freien und Hansestadt Hamburg, der Hamburger Hochschulen (HAW Hamburg, TU Hamburg, Hochschule für Musik und Theater, Hochschule für Bildende Künste), der Multimedia Kontor Hamburg gGmbH und des Universitätsklinikums Hamburg-Eppendorf arbeiten daran und unterstützen Menschen in jeder Lebensphase mit ihren fundierten Wissensangeboten. Drei Gedanken dazu.

1. Fit für die Zukunft: Warum lebenslanges Lernen in der Arbeitswelt unverzichtbar ist

In einer alternden Gesellschaft, in der die Menschen länger im Erwerbsleben stehen, wird lebenslanges Lernen zu einer zentralen Voraussetzung, um berufliche Chancen zu sichern und den technologischen Wandel zu bewältigen. Dies gilt insbesondere für ältere Arbeitnehmerinnen und Arbeitnehmer, die sich an neue Anforderungen anpassen müssen, um auf dem Arbeitsmarkt konkurrenzfähig zu bleiben.

Wir bieten als Plattform kostenlose, flexible und niederschwellige Weiterbildungsmöglichkeiten, die es Menschen (auch im Alter) ermöglichen, neue berufliche Kompetenzen zu erwerben. Durch die flexiblen Online-Formate können Interessierte die Lerninhalte auch mit begrenztem Zeitbudget – ob berufstätig oder in der Familienphase – nutzen.

Dies dient nicht nur der individuellen beruflichen Entwicklung, sondern wirkt auch dem durch den demografischen Wandel verschärften Fachkräftemangel entgegen.

2. Bildung für alle Lebensphasen: Persönliche Entwicklung durch lebenslanges Lernen

Lebenslanges Lernen unterstützt die persönliche Entwicklung in allen Lebensphasen – von der Jugend bis ins hohe Alter. Es ermöglicht jungen Menschen, ihre Bildung über die traditionellen schulischen und universitären Bildungswege hinaus zu erweitern, und älteren Menschen, neuen Interessen nachzugehen oder vorhandene Fähigkeiten auszubauen.

Gerade vor dem Hintergrund des demografischen Wandels ist dies wichtig, da der Dialog zwischen den Generationen und der gegenseitige Wissenstransfer gestärkt werden. Wir fördern diesen generationsübergreifenden Austausch, indem wir Menschen den Zugang zu hochwertiger Bildung ermöglichen.

3. KI und Automatisierung: Warum technologische Bildung jetzt wichtig ist

Mit dem technologischen Wandel durch künstliche Intelligenz (KI) und Automatisierung sind viele Berufe im Umbruch. Dies betrifft sowohl junge Menschen, die in eine sich wandelnde Arbeitswelt eintreten, als auch ältere Arbeitnehmerinnen und Arbeitnehmern, die sich an diese Veränderungen anpassen müssen. Wir bieten daher Lerninhalte, die Menschen jeden Alters darauf vorbereiten, die neuen technologischen Anforderungen zu bewältigen.

Für Jugendliche und junge Erwachsene ist es wichtig, sich frühzeitig auf die digitale Zukunft vorzubereiten, während ältere Erwachsene durch die Plattform die Möglichkeit haben, sich neue berufliche Fähigkeiten anzueignen und ihre Karrierechancen zu sichern.

Fazit: Lebenslanges Lernen für eine erfolgreiche Zukunft im demografischen Wandel

Diese drei Gedanken zeigen, dass lebenslanges Lernen mehr ist als persönliche Entwicklung. Es ist ein gesellschaftlicher Auftrag vor dem Hintergrund des demografischen Wandels. Eine alternde Bevölkerung, zunehmende Diversität und technologische Umbrüche machen es erforderlich, dass Menschen ihre Kompetenzen kontinuierlich erweitern und sich an neue Herausforderungen anpassen.

Bildungsplattformen wie wir bieten die notwendige Infrastruktur, um diesen Wandel erfolgreich zu gestalten. Wir ermöglichen den Zugang zu Bildung für alle Altersgruppen, fördern den Austausch zwischen den Generationen und stärken den gesellschaftlichen Zusammenhalt.

Nur durch eine breite Verankerung des lebenslangen Lernens kann eine zukunftsfähige Gesellschaft entstehen, die Jung und Alt in den Transformationsprozess integriert und eine gerechtere und nachhaltigere Zukunft sichert.