Schlagwort: KI

Hintergrund: Martin Martz / Unsplash

06.03.2026 | Meena Stavesand

Weltfrauentag: Vier Frauen erzählen, warum sie ihr Wissen offen teilen

Kunstgeschichte, Künstliche Intelligenz, Geburtshilfe und Schlagzeug – an der HOOU teilen Frauen aus ganz unterschiedlichen Fachgebieten ihr Wissen offen mit der Welt. Zum Weltfrauentag haben wir vier von ihnen drei Fragen gestellt. Ihre Antworten zeigen, was sie antreibt, woran sie gerade arbeiten und welche Themen ihnen am Herzen liegen.

Hinter jedem Lernangebot auf der HOOU-Plattform stehen Menschen mit einer Geschichte, einer Haltung und einer Motivation. Oft sieht man die Kurse, die Texte, die Videos – aber nicht die Köpfe dahinter. Das wollten wir zum Weltfrauentag ändern. Nicht mit großen Reden über Gleichstellung, sondern indem wir vier Frauen einfach zu Wort kommen lassen: über ihre Arbeit, ihre Themen und das, was sie der Welt mitgeben wollen. Die Bandbreite ihrer Antworten zeigt, wie vielfältig offene Bildung sein kann – von der Kunstkritik bis zur Geburtsmedizin, von der KI-Werkstatt bis zum Schlagzeug-Repertoire.

Geschichte findet nicht in der Vergangenheit statt, sondern in der Gegenwart.Prof. Dr. Astrid Mania

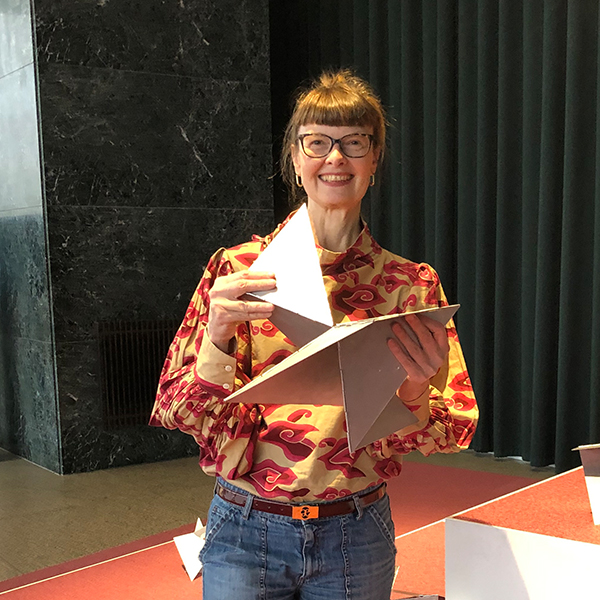

Prof. Dr. Astrid Mania ist Professorin für Kunstkritik und Kunstgeschichte der Moderne an der Hochschule für bildende Künste Hamburg.

Was treibt dich an, dein Wissen offen zu teilen?

Neben der Begeisterung für mein Fach, die ich natürlich artikulieren möchte, ist es mir wichtig zu betonen, dass Geschichte nicht in der Vergangenheit, sondern in der Gegenwart stattfindet. Unser Blick auf die Geschichte ist von Fragen geprägt, die wir uns heute stellen. Was dabei sichtbar wird und was nicht, kann oft politische oder ideologische Gründe haben. Geschichte ist im guten wie im schlechten Sinne wandelbar. Eine kritische Selbstreflexion ist daher wichtig: Wozu forschen wir? Warum und aus welcher Perspektive heraus tun wir das? Was übersehen wir vielleicht dabei? Darum ist es in meinen Augen besonders wichtig, möglichst viel Wissen zugänglich zu machen – auch damit es für künftige Forschungen bereitsteht.

Woran arbeitest du gerade und warum begeistert es dich (und andere)?

Neben einer Reihe von eigenen Publikationsprojekten zu Kunstkritik und zeitgenössischer Kunst arbeite ich seit einem Jahr mit unseren Studierenden an einem Online-Archiv. Wir machen darin die Geschichte unserer internationalen Alumni sichtbar: The International Alumni Archive auf https://tiaa.hfbk.net.

Aktuell befassen wir uns mit den Jahren 1945 bis 1985. Es gibt Textbeiträge und Interviews, in denen es um das Studium dieser Alumni und die Zeit danach geht. In manchen Fällen haben heutige Studierende Verwandte und Zeitzeug:innen gefunden und konnten so ein Bild ihrer Vorgänger:innen zeichnen. Das Vorhaben profitiert enorm von unseren gegenwärtigen internationalen Studierenden, die in ihren Sprachen und Kulturen forschen und Informationen erschließen können.

Es ist ein wenig wie Detektivarbeit. Und die Lebenswege, die wir finden, sind hochgradig spannend: Alumnus Igor Suhacev war in Kanada als Ikonenmaler erfolgreich, Alice Matilda Schwartz wurde in den USA zu einer Pionierin im Unterrichtsfernsehen für Kunst, Francisco Whitaker Ferreira ist unter seinem Spitznamen „Chico“ und als Mitbegründer des Weltsozialforums bekannt. Und natürlich schließen sich grundlegende politische und sozio-ökonomische Fragen an unser Vorhaben an, die wir hoffentlich im Laufe der nächsten Jahre in Texten und Grafiken beantworten werden: Aus welchen Ländern kamen die Studierenden und warum? Wer konnte es sich überhaupt leisten, im Ausland zu studieren? Welche Form der Unterstützung gab es? Welche strukturellen Hindernisse galt es zu überwinden, auch mit Blick auf eine internationale künstlerische Karriere?

So wollen wir mit dem Online-Archiv den jetzigen und ehemaligen internationalen Studierenden einen historischen Kontext geben und gleichzeitig einen Wissensfundus auch für externe Interessierte anlegen, die sich mit Fragen des akademischen Austauschs oder des internationalen Kunstbetriebs befassen.

Über welches Thema sollten mehr Menschen Bescheid wissen?

Nach wie vor sind die Beiträge von Künstlerinnen unterschätzt und ungewusst, weil selbst zu Lebzeiten sehr erfolgreiche Künstlerinnen nicht in die Geschichte eingeschrieben und ihre Leistungen bewusst ignoriert wurden. Hier gibt es immer noch viel Nachholbedarf.

Offene und kostenfreie Bildung ist für eine demokratische Gesellschaft essentiell.Katrin Schröder

Katrin Schröder arbeitet beim Multimedia Kontor Hamburg und ist an der HOOU u. a. für Social Media verantwortlich.

Was treibt dich an, dein Wissen offen zu teilen?

Für mich ist offene und kostenfreie Bildung für eine demokratische, gerechte und vielfältige Gesellschaft essentiell. Daher finde ich es wichtig, wissenschaftlich fundierte Forschung durch unterschiedliche Wissenszugänge für jeden anzubieten.

Woran arbeitest du gerade und warum begeistert es dich (und andere)?

Derzeit setze ich mich vor allem im HOOU-Kosmos mit Künstlicher Intelligenz auseinander und versuche den Diskurs dazu durch unterschiedliche Formate, wie Online-Kurse, Schulungen oder KI-Werkstätten in die Gesellschaft zu tragen.

KI-Kompetenz an Hochschulen

Künstliche Intelligenz ist längst auf dem Campus angekommen – in Forschung, Lehre und Verwaltung. Ob automatisierte Prüfungsbewertung, KI-gestützte Beratung oder generative Tools im Studienalltag: Der verantwortungsvolle Umgang mit KI ist zu einer zentralen Zukunftsaufgabe für Hochschulen geworden. Dieser Kurs vermittelt praxisnahes Wissen über technische Grundlagen, ethische Fragestellungen und rechtliche Rahmenbedingungen – mit besonderem Fokus auf die neue europäische KI-Verordnung (AI Act). Interaktive Elemente laden zur aktiven Auseinandersetzung ein. Der Kurs richtet sich an Hochschulmitarbeitende aller Fachbereiche, die KI verstehen, einordnen und kompetent nutzen wollen. Das Lernangebot zu KI-Kompetenzen wurde als hochschulübergreifendes Selbstlernangebot durch das MMKH in enger Zusammenarbeit mit den beteiligten Hamburger Hochschulen entwickelt und bereitgestellt. Hinweis: Diese Beta-Version wird laufend weiterentwickelt – Inhalte und Funktionen können sich noch ändern.

Über welches Thema sollten mehr Menschen Bescheid wissen?

Ich denke, Themen wie Nachhaltigkeit, aber tatsächlich KI, wird uns in Zukunft im Leben und der Arbeit stark beschäftigen, daher finde ich die Auseinandersetzung damit wichtig. Die HOOU bietet in diesen Themenfeldern ja viele interessante Online-Kurse und Events an.

Gebären ist ein kraftvolles Geschehen – und gleichzeitig mit einer großen Verletzlichkeit verbunden, weshalb es Schutz, Geborgenheit und Respekt braucht.Dr. Angelica Ensel

Dr. Angelica Ensel ist promovierte Kulturwissenschaftlerin, Hebamme und an der HAW Hamburg im Studiengang Hebammenwissenschaft B.Sc. tätig.

Was treibt dich an, dein Wissen offen zu teilen?

Das große Potenzial der Geburt für die Gesundheit der Gebärenden und ihrer Familie. Gebären ist ein kraftvolles Geschehen – und gleichzeitig mit einer großen Verletzlichkeit verbunden, weshalb es Schutz, Geborgenheit und Respekt braucht. Wenn es den Fachkräften möglich ist, eine Geburtshilfe zu leisten, die ihren Werten entspricht, erleben sie Freude, Leidenschaft und Begeisterung.

Woran arbeitest du gerade und warum begeistert es dich (und andere)?

Ich möchte das Lernangebot der HOOU „Menschenwürdig gebären – erfahren und begleiten“ bekannt machen, das Wissen weiterzugeben, welche Elemente eine physiologische Geburt fördern und welchen Wandel unsere Geburtskultur braucht. Gleichzeitig engagiere ich mich in verschiedenen Netzwerken für eine Geburtshilfe, die die Rechte der Gebärenden sichert und eine gute Geburtserfahrung ermöglicht. Deshalb unterstütze ich die Klage des Vereins „Gerechte Geburt“ e.V., die in diesem Frühjahr beim Bundesverfassungsgericht eingebracht soll, um die Grundrechte der Gebärenden und ihrer Familien im Kontext der Geburtshilfe zu sichern.

Menschenwürdig gebären – erfahren und begleiten. Geburtskulturen im Wandel

Die Geburt als existenzielles Ereignis betrifft jeden Menschen – besonders Frauen, Paare und Kinder im Kontext von Schwangerschaft, Geburt und Elternwerden. Unmittelbar betrifft sie auch die Arbeit der begleitenden Berufsgruppen, wie Hebammen, Ärzt*innen, Pflegende, Beratende und Psychotherapeut*innen. Menschenwürdig gebären und geboren werden als fundamentales Frauen- und Menschenrecht ist auch in Deutschland keineswegs selbstverständlich. Dieses Lernangebot beleuchtet die essenziellen Elemente einer menschenwürdigen Geburt und das Zusammenwirken der Beteiligten mit dem Fokus auf die Geburt in der Klinik. Dabei werfen wir einen kritischen Blick auf die Machtstrukturen in der Geburtshilfe, den derzeitigen Notstand in der Versorgung und die Auswirkungen für Frauen, Familien und Fachkräfte. Wir widmen uns der Frage, welche Veränderungen notwendig sind, damit evidenzbasiertes Wissen und gelebte geburtshilfliche Kunst eine gesundheitsfördernde, frauen- und menschenwürdige Geburt ermöglichen.

Über welches Thema sollten mehr Menschen Bescheid wissen?

Erfahrungen von Respektlosigkeit und Gewalt im Kontext der Geburt sind weit verbreitet. Dazu gehören unter anderem: respektloses oder entwürdigendes Verhalten, Eingriffe ohne Einverständnis, mangelnde Aufklärung, Verweigerung von Schmerzmitteln sowie allein lassen. Etwa 25 Prozent aller Gebärenden machen solche Erfahrungen mit zum Teil gravierenden Traumatisierungen, die sie und ihre Familien nachhaltig schwer belasten. Deshalb ist es dringend notwendig, endlich die große gesellschaftliche Leistung des Gebärens anzuerkennen, die Menschenrechte rund um die Geburt in unserer Verfassung zu sichern und die finanziellen Mittel für ihre Umsetzung bereit zu stellen.

Das ist wie beim gemeinsamen Musizieren: da ist auch nicht immer nur einer wichtig.Prof. Dr. Cornelia Monske

Prof. Dr. Cornelia Monske ist Professorin für Schlagzeug an der Hochschule für Musik und Theater Hamburg.

Was treibt dich an, dein Wissen offen zu teilen?

Ich habe mich mit dem Werk „Phenix“ von Françoise-Bernard Mâche sehr lange und intensiv beschäftigt. Es ist ein sehr komplexes und schweres Stück, das nur sehr wenig gespielt wird. Daher möchte ich mein Wissen gern teilen, um so noch viele andere zu animieren, sich auch mit diesem großartigen Werk auseinander zu setzen.

Woran arbeitest du gerade?

Ich arbeite gerade an einem neuen Projekt: „Das Schlagzeug in Werken von Axel Ruoff“. Er ist noch nicht so bekannt in der Schlagzeug-Welt und ich möchte ihn und ein paar seiner Werke gern bekannter machen.

Über welches Thema sollten mehr Menschen Bescheid wissen?

Ich beobachte bei meinen vielen Reisen, dass viele Menschen immer unhöflicher werden. Sie denken nur an den eigenen Vorteil. Wir leben in einer sehr starken „Ich-Gesellschaft“. Zu einem guten Miteinander gehört auch, sich selbst einmal zurück zu nehmen. Das ist wie beim gemeinsamen Musizieren: da ist auch nicht immer nur einer wichtig.

Was diese vier Frauen verbindet: der Wunsch, mit ihrer Arbeit etwas zugänglich zu machen, das sonst verborgen bleibt. Ihre Lernangebote findet ihr auf hoou.de. Danke an Astrid, Katrin, Angelica und Cornelia!

26.02.2026 | Christian Friedrich

LLMs angreifen! OWASP’s Top 10

LLM Verwundbarkeiten und deren Absicherung: Wir besprechen die OWASP Top 10!

Eigentlich ist das Open Web Application Security Projects (OWASP) als amerikanische NGO international im Bereich von Web-Anwendungen und deren Sicherheit unterwegs. Da LLMs mit ihrer Bedienung, Verfügbarkeit und Lernbasis aber auch irgendwie im Web anzusiedeln sind, hat OWASP ein Projekt, das sich um LLM-Verwundbarkeiten und deren Absicherung kümmert. An dieser Dokumentation in der Version 2025 vom 18. Nov. 2024 orientieren wir uns im Gespräch heute. Und wir verlinken sie euch in den Shownotes.

Links

OWASP Top 10 for LLM Applications 2025

Unsere Folge zur (Un-)Sicherheit von LLMs, insbesondere in Sicherheitsbehörden

Podcast App Empfehlungen

Unsere Kapitelbilder könnt ihr mit einer guten Podcast App sehen. Zum Beispiel mit:

Die Sicherheits_lücke im Netz

Abonniere Die Sicherheits_lücke überall, wo es Podcasts gibt, oder über unsere Website: https://www.sicherheitsluecke.fm

Die Sicherheits_lücke bei Mastodon

Die Sicherheits_lücke bei LinkedIn

Die Sicherheits_lücke bei Pixelfed

Feedback oder Kritik? Wünsche? Schreib uns: post@sicherheitsluecke.fm

Die Sicherheits_lücke ist ein Podcast der Hamburg Open Online University (HOOU).

Monina Schwarz, LSI Bayern

Volker Skwarek an der HAW Hamburg

Produktion und Musik: Christian Friedrich

Das in dieser Episode verwendete Bildmaterial steht unter der Lizenz CC-BY 4.0, Urheberin ist Anne Vogt.

29.01.2026 | Christian Friedrich

(Un-)sicher mit LLMs?

Untertitel

Zu Gast: Dr. Tobias Wirth, Leiter des Transferlabors Innere Sicherheit am DFKI

Beschreibung

Mit Tobias Wirth haben wir über die (Un-)Sicherheit von LLMs und KI Anwendungen in Sicherheitsbehörden gesprochen. Er ist Themenfeldleiter für generative und transparente KI im Forschungsbereich smarte Daten- und Wissensdienste am DFKI und leitet das Transferlabor KI-Forschung für die Polizei KI4POL.

Im Gespräch geht es um Möglichkeiten, LLMs auszutricksen, darum, wie Sicherheitsbehörden sich gegen die größten Angriffsvektoren schützen können und darum, was wir daraus auch auf den Alltag außerhalb von Sicherheitsbehörden lernen können.

Links

BSI-Publikationen

BSI: Generative KI-Modelle – Chancen und Risiken für Industrie und Behörden (PDF)

BSI: Evasion-Angriffe auf LLMs – Gegenmaßnahmen (PDF)

Sicherheit und Schwachstellen

Malwarebytes: ChatGPT Deep Research Zero-Click Vulnerability

OWASP Top 10 for Large Language Model Applications

Agentic LLM Vulnerabilities (arXiv, Stanford HAI)

Tools und Ressourcen

GARAK – LLM Vulnerability Scanner

Prompt Injection in the Wild (Kaggle Dataset)

Podcast App Empfehlungen

Unsere Kapitelbilder könnt ihr mit einer guten Podcast App sehen. Zum Beispiel mit:

Die Sicherheits_lücke im Netz

Abonniere Die Sicherheits_lücke überall, wo es Podcasts gibt, oder über unsere Website: https://www.sicherheitsluecke.fm

Die Sicherheits_lücke bei Mastodon

Die Sicherheits_lücke bei LinkedIn

Die Sicherheits_lücke bei Pixelfed

Feedback oder Kritik? Wünsche? Schreib uns: post@sicherheitsluecke.fm

Die Sicherheits_lücke ist ein Podcast der Hamburg Open Online University (HOOU).

Monina Schwarz, LSI Bayern

Volker Skwarek an der HAW Hamburg

Produktion und Musik: Christian Friedrich

Das in dieser Episode verwendete Bildmaterial steht unter der Lizenz CC-BY 4.0, Urheberin ist Anne Vogt.

03.01.2026 | Christian Friedrich

Jahresrückblick und Ausblick: 2025-2026

Unsere Folge zum Jahreswechsel: Wie blicken wir auf 2025, was erwarten wir von 2026?

Zum Jahreswechsel schauen wir auf die Entwicklungen in der IT- und Cyber-Security in 2025 zurück und wagen einen Ausblick auf 2026. Was hat uns im letzten Jahr beeindruckt, bewegt und beunruhigt? Welche Trends erhoffen wir, welche befürchten wir?

Website: www.sicherheitsluecke.fm

LinkedIn: https://www.linkedin.com/company/die-sicherheitslücke/

Mastodon: https://podcasts.social/@DieSicherheits_luecke

Links zu dieser Folge

Microsoft Sharepoint Sicherheitslücke beim BSI

Russischer Botschafter wird wegen Cyberangriffen einbestellt

Hardware Backdoor „Mifare Classic“

BSI-Lagebericht 2025 (Kurzfassung)

Deutsche Verwaltung: Microsoft-Abhängigkeit, Kosten, Risiken

Adieu Microsoft: Schleswig-Holstein setzt auf Open Source und spart Millionen

Tech-Industrie EU: Digitale Souveränität

Cloud-Zoff in Bayern wegen Milliardenauftrag an Microsoft ohne Ausschreibung

Rekord-DDoS-Angriff mit 7,3 TBit/s

US-Firma über benachbarte WLAN-Geräte Dritter angegriffen

Hacken auf höchstem Niveau: Malware in DNA eingeschleust

Nature: DNA-Sequencer Security Research

Podcast App Empfehlungen

Unsere Kapitelbilder könnt ihr mit einer guten Podcast App sehen. Zum Beispiel mit:

Die Sicherheits_lücke im Netz

Abonniere Die Sicherheits_lücke überall, wo es Podcasts gibt, oder über unsere Website: https://www.sicherheitsluecke.fm

Die Sicherheits_lücke bei Mastodon

Die Sicherheits_lücke bei LinkedIn

Die Sicherheits_lücke bei Pixelfed

Feedback oder Kritik? Wünsche? Schreib uns: post@sicherheitsluecke.fm

Die Sicherheits_lücke ist ein Podcast der Hamburg Open Online University (HOOU).

Credits

Monina Schwarz, LSI Bayern

Volker Skwarek an der HAW Hamburg

Produktion und Musik: Christian Friedrich

Das in dieser Episode verwendete Bildmaterial steht unter der Lizenz CC-BY 4.0, Urheberin ist Anne Vogt.

09.12.2025 | Christian Friedrich

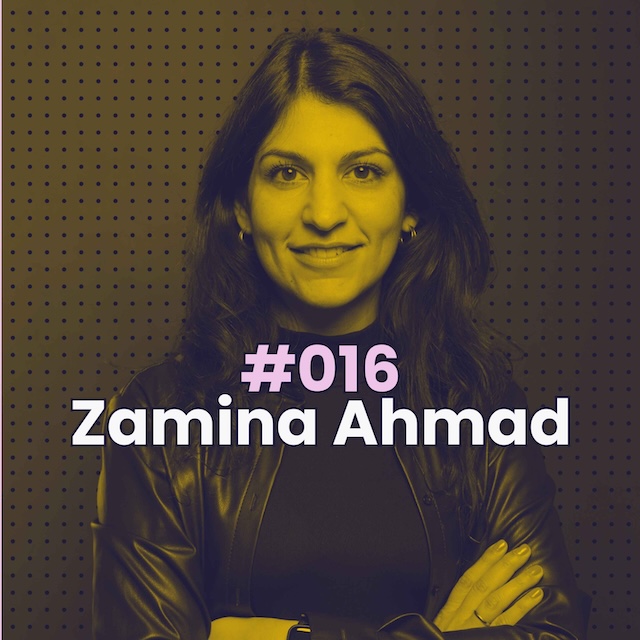

Zamina Ahmad

Gründerin und Beraterin Zamina Ahmad im Gespräch mit Christian Friedrich über faire und verantwortungsvolle KI

Zamina Ahmad ist Expertin für maschinelles Lernen und hilft Unternehmen, KI Anwendungen sinnvoll einzusetzen. Sie setzt sich für Faire KI ein und in dieser Folge geht es auch darum, was das für sie und andere bedeuten kann.

Zamina hat ein Beratungsunternehmen gegründet, dass sich mit Fragen rund um Fairness und Ethik von KI-Anwendungen befasst. Sie hat einen eigenen Podcast, hält regelmäßig Vorträge, gibt Workshops zum Thema KI und ihrem verantwortungsbewusster Einsatz in Organisationen und in Unternehmen. Im Gespräch teilt Zamina auch Tipps, was einzelne Nutzende in ihrer privaten Nutzung von Chatbots wie ChatGPT tun können, um Vorurteile, Stereotypen und vielleicht auch unerwünschte Ergebnisse ein Stück weit zu minimieren.

Links

Programmiersprache Python (Wikipedia)

Zaminas Buchempfehlung: Bas Kast, Wie der Bauch dem Kopf beim Denken hilft

Fair Tech, Fair Society (Podcast)

HOOU Lernangebote

Credits

Moderation: Nicola Wessinghage und Christian Friedrich

Musik: Jakob Kopczynski

Produktion: Christian Friedrich

Die Angebote zum Selbstlernen auf der Online-Plattform der Hamburg Open Online University stehen allen Interessierten frei zur Verfügung.

Um unsere Lernangebote zu nutzen, brauchst du weder zu studieren noch bestimmte Voraussetzungen zu erfüllen. Schau einfach online vorbei. Unsere Internetadresse ist www.hoou.de

Feedback, Anregungen und Kommentare zum Podcast erreichen uns per E-Mail unter waswillstduwissen@haw-hamburg.de

Bild: Google DeepMind / Unsplash

10.11.2025 | Meena Stavesand

KI ist Teamsport: Warum wir alle mitspielen sollten

„Education is key“ – aber reicht Aufklärung allein? Bildungsexperte Max Landefeld vom Fraunhofer-Institut für Intelligente Analyse- und Informationssysteme IAIS erklärt, warum KI ohne diverse Teams unvollständig bleibt und wichtige Perspektiven übersieht, was der EU AI Act bringen soll und weshalb KI-Kompetenz schon in der Schule beginnen muss. Das Interview ist ein Plädoyer für KI als Teamsport statt Tech-Monopol.

Mit der HAW Hamburg hat das Fraunhofer IAIS das Lernangebot „KI und Diversität“ erstellt. Warum das wichtig ist? Künstliche Intelligenz reproduziert unsere Vorurteile und genau daran müssen wir auf Entwicklungs- und Nutzungsebene arbeiten. Wie das aussehen kann, verrät Max Landefeld im Gespräch.

KI und Diversität

Um mit KI verantwortungsvoll umgehen zu können, bietet euch dieser Kurs ein Verständnis für KI-Konzepte, Biases, ethische Fragestellungen und Standards vertrauenswürdiger KI.

Wenn Sie Künstliche Intelligenz und Diversität hören, welche drei Begriffe kommen Ihnen in den Sinn und warum?

Max Landefeld: Mir kommt zuerst der Begriff „Spiegel“ in den Kopf – das mag etwas pathetisch klingen, aber KI zeigt uns relativ schnell, was in unseren Daten und damit auch in unseren Denkmustern steckt. Als Reflexionsinstrument sehe ich diese Technologie als sehr wertvoll an.

Der zweite Begriff, der direkt an das Thema Daten anknüpft, ist „Fairness“ beziehungsweise „Unfairness“. Viele Daten weisen Selection Bias auf – diskriminierende Muster finden sich in den Daten wieder und werden dann häufig unbewusst durch die Algorithmen reproduziert. Die Algorithmen selbst haben erst einmal keinen eigenen Wertemechanismus, was dann häufig zu unfairen Ergebnissen führt.

Als dritten Begriff denke ich an „Vertrauenswürdigkeit“ oder „Trustworthiness“. Dieser Bereich der Forschung setzt sich kritisch mit KI auseinander und fasst Initiativen und Ansätze zusammen – seien es technologische oder regulatorische Ansätze. Sie beschäftigt sich mit der Entwicklung und dem Einsatz von KI, die insbesondere zuverlässig, ethisch und sicher sein soll. Das sind die ersten Buzzwords, die mir in den Kopf kommen.

Bias (engl. für Verzerrung oder Voreingenommenheit) bezeichnet systematische Fehler oder Unausgewogenheiten in Daten und Algorithmen, die zu unfairen oder diskriminierenden Ergebnissen führen. Diese entstehen, wenn KI-Systeme mit historischen Daten mit gesellschaftlichen Ungleichheiten trainieren.<br><br>Beispiele: Recruiting-Software bevorzugte männliche Bewerber, Gesichtserkennungssysteme funktionieren bei hellhäutigen Personen zuverlässiger als bei People of Color, Kreditvergabe-Algorithmen benachteiligen Menschen aus bestimmten Wohngebieten.<br><br>Gegensteuern lässt sich durch vielfältige Entwicklungsteams, repräsentative Trainingsdaten und kontinuierliche Überprüfung der Ergebnisse.

Sie beschäftigen sich mit KI und Diversität. Gab es einen Schlüsselmoment, der Ihr Interesse oder Bewusstsein für verantwortungsbewusste und vielfältige KI besonders geweckt hat?

Landefeld: Ich arbeite seit mehreren Jahren im Bildungsbereich, und wenn ich ehrlich bin, sind es die Diskussionen mit Schülerinnen und Schülern, die mich besonders prägen. Sie berichten ungefiltert von ihren Ängsten, Vorbehalten und negativen wie positiven Erfahrungen mit KI. Ich kann also keinen genauen Termin nennen, aber die Debatten, die mich über die vergangenen Jahre begleiteten, haben mein Interesse und mein eigenes Bewusstsein für das Thema stark gefördert und gestärkt.

Was sind die Ängste der Schüler:innen?

Landefeld: Häufig befürchten sie, dass KI wie in einem Science-Fiction-Film – Stichwort Terminator – autonom die Weltherrschaft übernimmt. Das sind die extremen Gedanken. Einfachere Beispiele kennen sie von Instagram, TikTok oder aus Zeitungen: Systeme, die bestimmte Gruppen ausschließen, beispielsweise bei Bewerbungen für Jobs. Oder Chatbots, die regelmäßig schädlichen Input geben, aber auch Feedback, das irreführend ist und die Schülerinnen und Schüler verunsichert.

Hat sich das in den vergangenen Jahren verstärkt? Als ChatGPT rauskam, wurde KI quasi gesellschaftsfähig. Vorher war sie eher ein Thema für Fachleute. Haben sich die Gespräche verändert?

Landefeld: Die Besonderheit ist: Wir nutzen KI schon seit vielen Jahren, teils Jahrzehnten – häufig wissen wir das aber nicht. Es fängt bei den Empfehlungsalgorithmen von Social Media an, geht über Googles Page-Ranking-Algorithmus bis hin zur Face-ID am Smartphone oder Google Maps. Überall stecken Machine Learning und Deep-Learning-Algorithmen drin.

Mit ChatGPT hatten wir jetzt einen Game Changer: Mit einem Aha-Effekt bekommt man generischen Output und allen wird klar: Okay, das scheint ein KI-System zu sein. Die größte Herausforderung dabei ist das Thema Aufklärung. Wir sagen immer „Education is key“ – und da ist etwas dran. Wir sollten versuchen, KI-Kompetenzen zu schulen und im besten Fall in der Schule damit anfangen, wirklich aufzuklären. Das bedeutet nicht, dass jede:r Data Scientist:in werden muss – das sind die Fachleute, die sich mit der Algorithmik und der Konzeptionierung von KI-Systemen beschäftigen. Aber zumindest jede:r sollte ein grundlegendes Verständnis haben:

- Wie funktioniert so ein Algorithmus?

- Warum sind Daten wichtig?

Nur so können wir potenziell gefährliche Outputs wie Bias erkennen, reflektieren und einschätzen.

Neben der Aufklärung ist die Transparenz wichtig. Insbesondere wenn wir KI nutzen, wissen wir im Regelfall nicht, welche Daten ins Modelltraining geflossen sind. Da braucht es Transparenz – auch auf der Anbieterseite.

Gelingt das aktuell?

Landefeld: Aktuell gelingt es wenig bis kaum. Wir haben den EU AI Act, der derzeit sukzessive in nationales Recht überführt wird. Diese europäische KI-Regelung soll Abhilfe schaffen und insbesondere die Anbieter dazu verpflichten, ihre Systeme kritisch aufzubauen und zu prüfen. Auch hier spielt das Stichwort Vertrauenswürdigkeit eine große Rolle.

Wir in Europa haben große Hoffnungen, dass diese KI-Entwicklung auf europäischer Ebene zu unseren Gunsten beeinflusst wird und wir uns kritischer und selbstreflektierter damit auseinandersetzen. Wobei wir einschränken müssen: Es handelt sich um europäisches, nicht um internationales bzw. globales Recht.

Der AI Act (KI-Verordnung) ist ein umfassendes Gesetz zur Regulierung Künstlicher Intelligenz, das die Europäische Union (EU) 2024 verabschiedet hat. Die Verordnung wird derzeit schrittweise in nationales Recht überführt und soll 2026 vollständig in Kraft treten.<br><br>Das Gesetz teilt KI-Systeme nach ihrem Risiko ein: Anwendungen mit unannehmbarem Risiko wie biometrische Massenüberwachung werden verboten. Hochrisiko-KI in sensiblen Bereichen wie Bewerbungsverfahren, Kreditvergabe oder Strafverfolgung unterliegt strengen Auflagen. KI mit geringem Risiko wie Chatbots muss als solche gekennzeichnet werden. Für KI-Anbieter bedeutet das: Sie müssen offenlegen, welche Daten sie zum Training verwendet haben, Risiken dokumentieren und ihre Systeme auf Diskriminierung prüfen. Bei Verstößen drohen hohe Strafen. <br><br>Der AI Act gilt als wichtiger Schritt für vertrauenswürdige KI, betrifft aber nur den europäischen Markt – internationale Standards fehlen weiterhin.

Wie kann Diversität dazu beitragen, KI fairer und besser zu machen?

Landefeld: Diversität ist ein elementarer Schlüssel, weil sie Blickwinkel erweitert. Auf der einen Ebene bei der Entwicklung – das geht von der Datenauswahl bis hin zur Interpretation der Ergebnisse. Unterschiedliche Erfahrungen, kulturelle Hintergründe und Denkweisen können dabei helfen, Wissenslücken zu erkennen , Perspektivenvielfalt zu ermöglichen und damit gerechtere, vertrauenswürdige Systeme zu gestalten. Das ist die Entwicklungsseite, wo wir noch viel Potenzial haben.

Gleichzeitig müssen sich aber auch die Nutzenden damit auseinandersetzen – also diejenigen, die diese Systeme nicht selbst entwickeln, sondern sie tagtäglich anwenden. Auch sie müssen sich damit beschäftigen und beispielsweise den Output ihrer Chatbot-Anfragen kritisch prüfen.

Warum ist es wichtig, dass möglichst viele Menschen – nicht nur Fachleute – ein Verständnis für KI und Vielfalt entwickeln?

Landefeld: Weil KI so allumfassend ist und alle Gesellschaften, alle Industrien berührt. Das betrifft insbesondere die private Nutzung zu Hause mit den sozialen Medien, aber auch die ganze Joblandschaft. Es wird keine Industrie geben, die langfristig nicht bedeutend von KI berührt wird und sich dadurch verändert.

Deshalb ist es ganz wichtig, dass wir uns alle kritisch damit auseinandersetzen. Ein Kollege von mir sagt immer: „KI ist Teamsport.“ Das fasst es gut zusammen. Es ist eben nicht dieses „nerdige“ Informatik-Thema, mit dem sich nur die Data Scientists befassen sollen.

Denn selbst Data Scientists mit einem multikulturellen, diversen Hintergrund sind nicht zwingend repräsentativ für Gesellschaften. Es sind häufig doch die Akademiker:innen mit mathematisch-statistischem Hintergrund. Deswegen muss man sich – wieder diese Differenzierung – auf der Entwicklungsebene kritisch damit auseinandersetzen und ein grobes Verständnis auch für diese algorithmische Voreingenommenheit und Biases in KI-Systemen entwickeln, aber eben auch auf der Nutzungsebene.

Sie haben mit der HAW Hamburg am Fraunhofer IAIS ein Lernangebot zu KI und Diversität entwickelt: Was kann ich da lernen?

Landefeld: Wir befassen uns auf der einen Seite mit den Grundlagen: Was ist KI überhaupt? Woher kommt sie? Es gibt verschiedene Begriffe und Grundtechnologien, die in fast allen Systemen vorkommen – die erklären wir. Des Weiteren erklären wir das Thema Biases und welchen Bezug das zur Diversität hat. Wir zeigen auf, warum diverse Ansätze so wichtig sind. Dann schauen wir uns an, was auf regulatorischer Ebene passiert und was die europäischen Institutionen vorgeben – an Leitlinien, aber auch an Gesetzen wie dem EU AI Act. Zum Abschluss üben wir den kritischen und reflektierten Umgang mit solchen Tools, mit den Chatbots, die gerade sehr präsent in unserem Alltag sind.

KI und Diversität

Um mit KI verantwortungsvoll umgehen zu können, bietet euch dieser Kurs ein Verständnis für KI-Konzepte, Biases, ethische Fragestellungen und Standards vertrauenswürdiger KI.

An welche Altersgruppe richtet sich das Angebot?

Landefeld: Das E-Learning richtet sich an Menschen ab 16 Jahren aufwärts – insbesondere an Schülerinnen und Schüler, aber auch an Studierende der Hochschulen. Es ist ansonsten offen für alle. Wir freuen uns, wenn Menschen mit einem anderen Hintergrund, beispielsweise im Kontext der beruflichen Weiterbildung, sich damit auseinandersetzen. Demnach ist es auch kostenlos und frei verfügbar für alle. Sie bekommen dort einen schnellen Einstieg, wenn Sie sich mit dem Thema befassen wollen.

Wenn Sie in die Zukunft blicken: Was wünschen Sie sich für den gesellschaftlichen Umgang mit KI in einer pluralistischen Welt?

Landefeld: Ich fände es schön, wenn KI von diesem reinen Informatik-Thema weg kommt und als gemeinsames Gestaltungsprojekt verstanden und interpretiert wird. Denn es ist kein rein technisches Thema – es ist so bedeutsam und hat so viel Einfluss auf verschiedene Bereiche bei uns privat, aber auch auf der Arbeit. Im Zuge dessen – und das ist vielleicht sogar ein Appell, den ich formulieren möchte – ist es wichtig, dass wir KI-Kompetenzen aufbauen und dass dies strukturell gefördert wird. Das geht meines Erachtens schon in der Schule los, und zwar nicht nur im Informatikunterricht, sondern fächerübergreifend.

Dieser Ansatz sollte sich fortsetzen bis zur universitären Ausbildung und dann zur stetigen Aus- und Weiterbildung auch im Betrieb. Der Artikel 4 des EU AI Acts sieht genau das vor. Trotzdem haben wir noch viel zu tun in den nächsten Jahren und Jahrzehnten, um diese Kompetenzen aufzubauen. Wichtig ist es allemal.

Über Max Landefeld

Max Landefeld arbeitet am Fraunhofer IAIS und koordiniert die Initiative AI4Schools. Diese widmet sich der Gestaltung von Bildungsangeboten rund um das Thema KI für Schulen. Er engagiert sich leidenschaftlich für die Entwicklung vertrauenswürdiger, nachhaltiger und niedrigschwelliger KI-Systeme.

Bild: Matheus Bertelli / pexels

19.05.2025 | Ellen Pflaum

Urheberrecht bei KI-Inhalten: 10 entscheidende Antworten - auch für OER

Zum 10. Geburtstag der HOOU präsentiert das Team der HAW Hamburg eine Broschürenreihe, die durch zehn ausgewählte Impulse, Konzepte und Ideen Einblicke in die Welt der HOOU und insbesondere der Open Educational Resources (OER) gewährt. Den Auftakt dieser Reihe bildet eine Broschüre zu Urheberrechtsfragen bei der Verwendung KI-generierter Inhalte. Autorin ist Andrea Schlotfeldt, Juristin an der HAW Hamburg.

Unter dem Titel „10 Fragen zu KI-Output, Urheberrecht und OER“ werden zehn häufig gestellte Fragen rund um KI-generierte Inhalte, deren Nutzungsmöglichkeiten, Kennzeichnungspflichten sowie KI-Output als Bestandteil von Open Educational Resources umfassend beantwortet.

In den vergangenen Jahren haben sich KI-Systeme zur Text- und Bildgenerierung im Bildungs- und Wissenschaftsbereich zu einem alltäglichen Arbeitsinstrument entwickelt – sei es für die Zusammenfassung, Umformulierung oder Übersetzung von Texten oder für die Erstellung passender Bilder und grafischer Darstellungen.

Auch werden KI-generierte Inhalte zunehmend in offene Bildungsmaterialien (OER) eingebunden. Diese Anwendungen bringen verschiedene urheber- und lizenzrechtliche Fragestellungen mit sich.

Praxisnahe Antworten auf relevante Fragen

Die neue Broschüre greift gezielt jene zehn Fragen auf, die in Urheberrechts- und OER-Workshops sowie -Beratungen häufig gestellt wurden. Sie bietet nicht nur praxisnahe Antworten auf diese relevanten Fragen, sondern sensibilisiert die Leserschaft auch für rechtliche Sonderfälle, die bei der KI-Nutzung bislang möglicherweise übersehen wurden. Sämtliche Antworten auf die FAQ stehen sowohl in einer knappen Übersicht als auch in einer ausführlichen Fassung zur Verfügung.

Zitiervorschlag:

10 Jahre HOOU – 10 Fragen zu KI-Output, Urheberrecht und OER, HOOU@HAW Hamburg | Andrea Schlotfeldt, CC BY 4.0 (2025)

Bild: Ivan Samkov / pexels.com

15.04.2025 | Meena Stavesand

KI trifft Klassenzimmer: Wie Lehrkräfte lernen, künstliche Intelligenz sinnvoll einzusetzen

Wie verändert KI die Bildung – nicht nur im Klassenzimmer, sondern schon in der Ausbildung der Lehrkräfte? Wir haben mit Johannes Schäfers von der TU Hamburg gesprochen. Er ist Experte für berufliche Bildung und entwickelte für die HOOU gemeinsam mit Prof. Dr. Maren Baumhauer und Stephanie Wichmann das Lernangebot „KOM.KI“, mit dem sich etwa Lehramtsstudierende auf den reflektierten Einsatz von KI vorbereiten können. Im Interview spricht er über Chancen, Stolpersteine – und darüber, warum man sich ruhig trauen darf, einfach mal mit KI loszulegen.

Wann bist du mit KI in Berührung gekommen?

Johannes Schäfers: Mein erster Berührungspunkt mit KI war tatsächlich Ende 2022, Anfang 2023, als die ersten Chatbots für die breite Gesellschaft wie z. B. ChatGPT aufkamen. Das war schon beeindruckend, was da plötzlich möglich war.

Wie nutzt du KI heute in deiner Arbeit an der TU Hamburg?

Johannes Schäfers: Inzwischen fast täglich. An der TU Hamburg haben wir einen eigenen Chatbot namens TUKI, die auch auf ChatGPT basiert. Die ist mit unserer Infrastruktur verknüpft. Das macht es besonders praktisch.

Ich nutze aber auch verschiedene KI-Tools fürs Brainstorming, zum Strukturieren von Inhalten und für Bildgenerierung – zum Beispiel für Präsentationen oder für die Lehre allgemein. KI hilft mir teilweise bei administrativen Aufgaben, um Prozesse effizienter zu gestalten. Es spart einfach Zeit und gibt Raum für Kreativität.

Wenn du an Schule und Bildung denkst – wo siehst du die größten Potenziale von KI? Für Lehrkräfte und für Schüler:innen?

Johannes Schäfers: Für Lehrkräfte sehe ich unter anderem riesiges Potenzial in der Analyse und Begleitung von Lernprozessen – also dabei, besser zu verstehen, wo die Schüler:innen gerade stehen – das nennt sich Learning Analytics.

Für Schüler:innen wiederum ist KI super, um sich Inhalte einfacher aufbereiten zu lassen: Zusammenfassungen, Gliederungen, einfache Erklärungen oder auch Bildmaterial. Das erleichtert vieles.

Aber: Es ist wichtig, diese Tools aber auch kritisch zu betrachten. Man muss lernen, die Ergebnisse zu hinterfragen. Ist das korrekt, was die KI da ausspuckt? Wie kann ich die Ergebnisse möglicherweise weiter überprüfen? Ergibt das Sinn? Diese Reflexion sollte immer dazu gehören.

Learning Analytics bezeichnet die systematische Auswertung von Lerndaten der Schüler:innen. Es geht darum, Lernstände zu analysieren, Abweichungen frühzeitig zu erkennen und individuelle Lernpfade aufzuzeigen. Beispielsweise kann ein KI-gestütztes System zeigen, wenn die Leistung eines Schülers oder einer Schülerin plötzlich abfällt – vielleicht durch persönliche Probleme oder Lernschwierigkeiten. Lehrkräfte können so gezielter unterstützen. Auch adaptive Lernpfade sind möglich: Wer Schwierigkeiten hat, bekommt kleinere, passende Aufgabenpakete – bis das große Ganze bewältigt werden kann. Das Ziel: mehr (und schnellere) individuelle Förderung.

Ich musste mir damals im Studium alle Inhalte mühsam zusammensuchen – heute fragt man ein Tool. Geht da nicht auch etwas verloren?

Johannes Schäfers: Natürlich kann man sagen: Die Tools nehmen einem einiges an Arbeit ab. Aber man muss auch dazu befähigt werden, sie überhaupt sinnvoll einsetzen zu können. Und genau da sehe ich unsere Aufgabe – in der Ausbildung der angehenden Lehrkräfte. Es geht nicht nur um die bloße Anwendung, sondern um eine ganzheitliche Kompetenzentwicklung im Umgang mit KI-Tools.

Und klar ist doch: Jede Generation hatte ihre Tools. Wir hatten in den 2000ern plötzlich Computer. Vor knapp 50 Jahren gab’s das alles noch nicht. Es geht nicht darum, ob man Technik nutzt – sondern wie.

Welche Kompetenzen sind dir dabei besonders wichtig?

Johannes Schäfers: Neben dem technischen Verständnis sind mir ethische, gesellschaftliche und auch ökologische Aspekte extrem wichtig. Aspekte der Diskriminierung, des Datenschutzes aber auch der Energieverbrauch von Servern – das gehört alles dazu. Ich versuche, meinen Studierenden genau diese Perspektiven mitzugeben: Es geht nicht nur um die Technik, sondern darum, wie wir verantwortungsvoll mit ihr umgehen.

Ihr habt ein Lernangebote zum Umgang mit KI erstellt. Es geht um die Entwicklung von KI-Kompetenzen. Was sind eure Erkenntnisse bisher?

Johannes Schäfers: Was mich total begeistert: Die Studierenden in unseren Seminaren kommen mit vielen eigenen Ideen. Sie entwickeln Projekte, erproben KI in Lehrveranstaltungen und profitieren auch selbst ganz konkret. Auch leistungsschwächere Studierende sehe ich durch KI gezielt unterstützt – etwa bei der Rechtschreibung oder bei der Gliederung von Texten. Das stärkt das Selbstbewusstsein und führt oft zu besseren Ergebnissen.

Aber das funktioniert natürlich nur, wenn die Studierenden auch wissen, wie man mit KI sinnvoll umgeht. Und genau das versuchen wir zu fördern – Schritt für Schritt, ohne Überforderung, mit den Lernangeboten unseres Projekts „Kom.KI“.

Worum geht’s da genau?

Johannes Schäfers: Wir haben zwei Formate entwickelt: den „Short Track“ für Einsteiger:innen, der sich am 4-A-Modell von Prof. Dr. Doris Weßels orientiert – also Aufklären, Ausprobieren, Akzeptieren, Aktiv werden. Wir haben das Ganze um ein fünftes A ergänzt: Anlässe schaffen. Denn oft fehlt in Schulen genau das – der konkrete Anlass, um KI sinnvoll z. B. im Unterricht einzusetzen.

Dann gibt es noch den „Deep Track“ für Fortgeschrittene. Dieser vertieft das Thema – mit konkreten Beispielprojekten, die unsere Studierenden gemeinsam mit Lehrkräften unter anderem aus Hamburger beruflichen Schulen entwickelt haben. Die Ergebnisse wurden hierbei in Form von Postern aufbereitet und sind auf unserer über unsere Lernangebote öffentlich zugänglich.

Kom.KI - Kompetenzentwicklung für KI-Tools

Künstliche Intelligenz (KI) spielt für viele Bereiche unseres Lebens bereits eine wichtige Rolle. Dies zeigt sich durch die intensive Nutzung von generativer KI, zum Beispiel in Form von Textgenerierung oder verschiedenen kreativen Prozessen wie Bilderstellung, Musikkomposition oder Videoproduktion. Die Veränderungen, die KI mit sich bringt, wirken sich aber auch unmittelbar auf unsere persönliche und berufliche Bildung aus. Diese Zusammenhänge möchten wir dir gerne hier in diesem Lernmodul vermitteln. Dafür haben zahlreiche Studentinnenund Studenten in Kooperation mit beruflichen Schulen Konzepte entwickelt, wie Künstliche Intelligenz für verschiedene Akteure zum Vorteil werden kann.

Wie gut kennen sich die Studierenden mit KI aus? Gibt es da Unterschiede?

Johannes Schäfers: Ja, definitiv. Manche sind sehr Technik-affin, andere tun sich schwerer – es gibt große Unterschiede. Dazu kommen die unterschiedlichen Vorerfahrungen oder auch ungleichen Zugänge zu kostenpflichtigen Tools – das sind alles reale Stolpersteine, denen wir begegnen.

Ich bin zwar ein Fan von „einfach mal ausprobieren“, also „trial and error“, aber wir brauchen trotzdem einen begleiteten Einstieg. Nur so können die Studierenden lernen, worauf es ankommt – nicht nur technisch, sondern auch inhaltlich und praktisch damit zu arbeiten sowie ihr Erlerntes zu reflektieren.

Ihr seid auch bei der KI-Werkstatt der HOOU. Was zeigt ihr dort?

Johannes Schäfers: Bei der KI-Werkstatt stellen wir beide Lernformate vor – und damit auch die Projektergebnisse unserer Studierenden. Uns geht’s darum, andere Lehrkräfte zu inspirieren: Schaut, was möglich ist! Findet Anlässe in eurem eigenen Schulalltag. Probiert Dinge aus, auch wenn ihr noch keine Expert:innen seid.

Denn genau das ist der erste Schritt: ins Handeln kommen. Nicht nur verstehen, sondern machen.

Wenn du an die Zukunft des Lernens denkst – welche Rolle spielt KI dabei?

Johannes Schäfers: Ich glaube KI wird nicht wieder verschwinden. Sie ist schon jetzt Teil unseres Alltags, besonders im Bildungsbereich. Und ich sehe das nicht als Problem, sondern als großartige Chance. Wichtig ist, dass wir lernen, damit umzugehen – kritisch, reflektiert und verantwortungsvoll.

Natürlich gibt es auch Risiken: KI kann halluzinieren, also falsche Informationen ausgeben. Aber wenn wir lernen damit umzugehen, können wir viel gewinnen. Studien zeigen schon jetzt: Wer mit KI arbeitet, kann manche Aufgaben schneller und besser erledigen – gerade im Bereich allgemeiner Schreibaufgaben. Die Qualität steigt, der Zeitaufwand sinkt. Das finde ich ist ein starkes Argument.

Aber: Es braucht Interesse, Neugier und die Bereitschaft, sich mit diesen Technologien auseinanderzusetzen. Nur dann kann man das Potenzial wirklich nutzen.

Über Johannes Schäfers

Johannes Schäfers M. Ed. ist seit Mai 2023 wissenschaftlicher Mitarbeiter am Institut für Berufliche Bildung und Digitalisierung an der Technischen Universität Hamburg. Zuvor war er in der Zeit von Juni 2020 bis April 2023 über das BMBF-geförderte Projekt „Leibniz works 4.0“ im Rahmen der Qualitätsoffensive Lehrerbildung als wissenschaftlicher Mitarbeiter am Institut für Berufspädagogik und Erwachsenenbildung an der Leibniz Universität Hannover beschäftigt. Sein Arbeits- und Forschungsschwerpunkt liegt in der Entwicklung und Evaluation von digitalen Lernumgebungen und der Erfassung und Förderung digitalisierungsbezogener Kompetenzen von Lehrkräften in der beruflichen Bildung.

30.10.2024 | Meena Stavesand

Entdecke deine digitale Superkraft: Der Insider-Guide zu KI-Tools

Stell dir vor, du könntest morgen aufwachen und plötzlich all die KI-Tools beherrschen, von denen alle um dich herum sprechen. Keine komplizierten Handbücher, keine kryptischen Anleitungen – stattdessen ein Weg, der so entspannt ist wie ein Gespräch mit einer guten Freundin. Genau das haben wir für dich entwickelt. Mit unserer KI-Moderatorin Luca, unsere niederschwelligen Texten und unseren kurzweiligen Erklärvideos tauchst du in eine Welt ein, in der Bildbearbeitung, Textgestaltung und Videokreation kein Mysterium mehr sind. Sie werden deine neuen Alltagstools. Wir zeigen dir nicht nur das Was und Wie, sondern vor allem das Warum und Wofür.

Künstliche Intelligenz revolutioniert die Art, wie wir arbeiten, kommunizieren und unsere Kreativität entfalten. Zwischen spektakulären Schlagzeilen und komplizierten Fachbegriffen fehlt dabei oft das Wichtigste: Ein verständlicher Zugang, der zeigt, wie diese Tools der generativen KI dein Leben tatsächlich bereichern können.

Gerade jetzt, wo KI-Technologien immer ausgereifter werden, ist es wichtiger denn je, sich mit den Möglichkeiten vertraut zu machen – nicht als passive:r Beobachter:in, sondern als aktive:r Gestalter:in dieser digitalen Revolution.

Technologie (be)greifbar machen

In unserem digitalen Lernangebot „KI-Tools kurz erklärt: So verwendest du ChatGPT, Leonardo.AI & Co.“ des Multimedia Kontor Hamburg und der TU Hamburg haben wir die spannendsten und nützlichsten KI-Tools für dich unter die Lupe genommen. Das Ergebnis: Ein kostenloser Online-Kurs, der Technologie (be)greifbar macht.

Deine Begleiterin durch dieses Abenteuer ist unsere KI-generierte Moderatorin Luca. Sie ist selbst ein faszinierendes Beispiel dafür, was mit generativer KI heute möglich ist, und wird dir in unseren Video-Tutorials mit Rat und Tat zur Seite stehen.

Das kannst du von unserem Kurs erwarten

- Deine Routineaufgaben geschickt automatisieren und wertvolle Zeit gewinnen

- Kreative Prozesse beschleunigen und neue Inspirationsquellen erschließen

- Professionelle Ergebnisse erzielen, die sich von der Masse abheben

- Innovative Lösungsansätze entwickeln und selbstbewusst umsetzen

- Technische Barrieren überwinden und deine digitale Kompetenz steigern

Text-KI als Inspirationsquelle

Im Bereich der Text-KI öffnen wir dir die Tür zu einem ganzen Universum an Möglichkeiten. Mit ChatGPT lernst du einen vielseitigen Allrounder kennen, der dir bei unzähligen Aufgaben zur Hand geht – von der ersten Recherche bis zur Textgestaltung. Microsoft Copilot wird zu deinem persönlichen Office-Assistenten und kann deinen Arbeitsalltag erleichtern, während du mit Google Gemini eine der nächsten Generation der Sprach- und Textverarbeitung kennenlernst. Speziell für Marketing-Inhalte zeigen wir dir Neuroflash, ein Tool, das die Feinheiten der Sprache besonders gut beherrscht. Das Besondere: Es ist ein deutsches Start-up!

KI-Tools kurz erklärt! So verwendest du ChatGPT, Leonardo.AI & Co.

Mit dem Lernangebot "KI-Tools kurz erklärt! So verwendest du ChatGPT, Leonardo.AI & Co." möchten wir einen niederschwelligen Zugang zu den gängigsten KI-Tools bereitstellen. Wir möchten Lust machen, die KI-Tools Schritt für Schritt kennenzulernen und sie direkt auszuprobieren und damit zu experimentieren. In verständlicher Sprache behandeln wir KI-Textgeneratoren sowie KI-Bild- und Videogeneratoren, gehen auf rechtliche Fragen ein, liefern Informationen zu Prompting, haben eine Sammlung für tiefergehendes Wissen und bieten ein Dialogforum, damit du dich mit anderen austauschen kannst. Wir erläutern dir die Tools auf zweifache Weise: in leicht verständlichen Texten, die auch Hintergrundinformationen zu der Entwicklung geben, und mit Videos, die die KI-Generatoren in der Anwendung zeigen. So lernst du die Entwicklung, die Funktionen und die Bedienung der Tools in deinem eigenen Tempo kennen und kannst sie Schritt für Schritt erkunden. Begib dich mit uns auf die Reise in dein KI-Abenteuer! 👩🚀

Visuelle Magie: Deine Ideen werden Realität

Die Welt der Bildgenerierung eröffnet dir völlig neue kreative Horizonte. In unseren praxisnahen Tutorials zeigen wir dir:

- wie du mit DALL-E fotorealistische Bilder zauberst, die deinen Vorstellungen entsprechen

- wie Midjourney dir hilft, deinen eigenen künstlerischen Stil zu entwickeln

- wie du Stable Diffusion für deine individuellen Projekte nutzt und anpasst

- wie Leonardo.AI deine Visualisierungen auf ein neues Level hebt.

Besonders spannend: Du lernst die Kunst der Prompts. Wir zeigen dir, wie du durch geschickte Formulierungen und Parameter genau die Bilder erzeugst, die du im Kopf hast. Dabei gehen wir auch auf spannende Techniken ein und modifizieren bestehende Bilder oder arbeiten mit verschiedenen Stilen.

Dein Weg in die KI-Zukunft

Die digitale Transformation ist in vollem Gange. KI-Tools sind dabei der Schlüssel zum Erfolg. In einer Zeit, in der sich Technologien rasant entwickeln, bieten wir dir einen verlässlichen Kompass durch die Welt der künstlichen Intelligenz. Unser Kurs vermittelt dir das nötige Wissen, um diese Entwicklung aktiv mitzugestalten – praxisnah, verständlich und ohne technische Hürden.

Stell deine Fragen in der Lunch Bag Session

Wir möchten dich hautnah informieren und regelmäßig updaten. So veranstalten wir Lunch Bag Sessions zu unserem Lernangebot. Darin informieren wir dich über die neuesten Entwicklungen und Trends in der Welt der KI-Tools.

Du bleibst damit am Puls der Zeit und kannst neue Features und Möglichkeiten direkt für dich nutzen. Unser Ziel ist es, dass du nach dem Kurs und unseren Schulungen nicht nur die Tools beherrschst, sondern auch verstehst, wie du sie kreativ und effizient in deinen Alltag integrierst.

Die nächste Lunch Bag Session zu ChatGPT und DALL-E

Unsere nächste Online-Schulung dreht sich um ChatGPT und DALL-E. Am Mittwoch, 20. November, erläutert Katrin Schröder vom Multimedia Kontor Hamburg von 12 bis 13 Uhr diese KI-Tools und deren vielfältige Anwendungsmöglichkeiten.

Die Schulung via ZOOM richtet sich an alle Interessierten – nicht nur aus dem Hochschulbereich, sondern auch explizit an interessierte Bürger:innen – unabhängig von Vorkenntnissen, und vermittelt ein grundlegendes Verständnis für die Anwendungen und Potenziale dieser KI-Modelle. Katrin Schröder ist Expertin auf diesem Gebiet und hat den Kurs „KI-Tools kurz erklärt: So verwendest du ChatGPT, Leonardo.AI & Co.“ gemeinsam mit Meena Stavesand konzipiert und umgesetzt.

Jetzt anmelden und einen Platz in der Schulung sichern

Melde dich jetzt kostenlos für die Lunch Bag Session an und starte deine persönliche KI-Lernreise mit uns. Unser Expertinnenteam freut sich darauf, dir die faszinierenden Möglichkeiten dieser Technologie näherzubringen und dich auf deinem Weg zu mehr digitaler Kompetenz zu begleiten. Gemeinsam erschließen wir das volle Potenzial der künstlichen Intelligenz – für deine persönliche und berufliche Entwicklung.

Weitere Veranstaltungen der HOOU zu Künstlicher Intelligenz

Die HOOU bietet dir ein vielfältiges Angebot zum Thema Künstliche Intelligenz – hier eine Auswahl der kostenlosen Events im November:

- Dienstag, 12. November, 18.30 Uhr, ligeti zentrum in Hamburg-Harburg: KI & Musik: Künstlerische Intelligenz im digitalen, kreativen Raum

- Freitag, 15. November, 13.45 bis 15 Uhr, TURN-Conference in Berlin: KI-Avatare in der Wissenschaftskommunikation & Lehre

- Mittwoch, 20. November, 12 bis 13 Uhr, ZOOM: Lunch Bag Session: Einführung in die KI-Tools ChatGPT und DALL-E

- Montag, 25. November, 17 bis 19.30 Uhr, TU Hamburg: Abschlusskonferenz im Projekt Kom.KI: KI –Kompetenzen fördern

- Donnerstag, 28. November, 15 bis 19 Uhr, Forum Finkenau in Hamburg: KI-Werkstatt: Alles KI – oder was?

Bild: Midjourney

24.07.2024 | Meena Stavesand

Generative KI: Das musst du über Urheberrecht, Datenschutz und Transparenz wissen

ChatGPT, Co-Pilot, Midjourney, Dalle-E oder auch DeepL – das alles sind KI-Generatoren für Texte und Bilder, die künstliche Intelligenz in die Gesellschaft gebracht haben. Jeder kann sich an generativer KI versuchen, Texte, Bilder und Videos erstellen und veröffentlichen. Aber wie sieht es mit Urheberrecht und Datenschutz aus? Was darf wie genutzt werden? Wann muss man KI-generierte Inhalte kennzeichnen? Und welche Verantwortung trägt man bei der Arbeit mit KI-Generatoren? Diese Fragen haben wir der Juristin Andrea Schlotfeldt von der HAW Hamburg gestellt. Herausgekommen ist ein spannendes Interview, in dem es auch um den neuen AI Act der EU geht.

Thema Urheberrecht. Inwieweit kann es bei Erstellung und Nutzung von KI-Inhalten zu Urheberrechtsverletzungen kommen?

Andrea Schlotfeldt: Die Wahrscheinlichkeit, hierbei fremde Urheberrechte zu verletzen, ist an sich gering. Es verbleibt aber ein Restrisiko. Hierfür ist die Art des gewählten Prompts relevant und, ob ich den KI-Output noch weiterbearbeite und falls ja, in welchem Umfang. Lasse ich einen noch geschützten fremden Text übersetzen und veröffentliche ich diese Übersetzung, kann darin eine Urheberrechtsverletzung liegen. Ebenfalls wenn ich ein fremdes Bild hochlade, durch die KI geringfügig verändere und dann neu veröffentliche.

Eine Urheberrechtsverletzung kann allerdings auch zufällig bzw. unbewusst vorkommen, auch je nach zugrunde liegendem Trainingsmaterial. Sofern KI-Output mit bestehenden fremden Werken identisch ist oder diesen stark ähnelt, ohne dass ich durch meinen Prompt darauf hingewirkt habe, könnte es theoretisch also auch zu Urheberrechtsverletzungen kommen.

Wie kann ich sicherstellen, dass ich bei der Nutzung von KI-Inhalten keine Urheberrechte verletze?

Andrea Schlotfeldt: Eine pauschale Sicherstellung ist nicht möglich, aber man kann z. B. durch eine Rückwärtssuche u. a. bei Google prüfen, ob man ähnliche Ergebnisse bekommt – wenn ja, ist man eventuell im Bereich der Urheberrechtsverletzung und sollte auf die Nutzung verzichten. Aber das lässt sich nicht generell sagen, sondern man muss es im Einzelfall prüfen. Grundsätzlich ist die Rückwärtssuche ein Instrument, mit dem man zumindest eine erste Information bekommt.

Auch sollte man davon absehen, KI-generierte Übersetzungen noch geschützter Texte ohne Zustimmung der Rechteinhaber:innen zu veröffentlichen. Letztlich kommt es darauf an, wie der Prompt ausgestaltet ist. Wenn man ganz gezielt nach bestimmten Texten oder Studienauszügen fragt, dann kann es vorkommen, dass zumindest in Teilen auch 1:1-Inhalte generiert werden. Von deren Weiterverwendung sollte ich dann absehen.

Gibt es Grenzen?

Andrea Schlotfeldt: Ja, man muss immer unterscheiden, in welchem Kontext man den Content verwendet. Wenn man ihn im Rahmen einer studentischen Arbeit oder auch als lehrende Person in Folien verwendet, dann kann das unter die Schranke des § 60a Urheberrechtsgesetz fallen, der zu Studien- oder Lehrzwecken bestimmte Nutzungen erlaubt, wenn die Inhalte in einem geschlossenen Benutzerkreis bleiben und nicht öffentlich auf einer Website zugänglich gemacht werden. Allerdings besteht hier die Anforderung, dass die Quellen angegeben werden müssen. Man muss also wissen, woher die Texte oder Bilder stammen – was bei KI-Output oft schwierig bis unmöglich sein kann. Und genau der eingeschränkte Kreis der Teilnehmerinnen und Teilnehmer an einer Veranstaltung ist wichtig.

Was ist der AI Act?<br>Der Artificial Intelligence Act (AIA) ist ein von der EU-Kommission im Rahmen der EU-Digitalstrategie veröffentlichtes Gesetz zur Regulierung von Künstlicher Intelligenz (KI) in Forschung und Wirtschaft. Er legt fest, welche Anbieter:innen und Nutzer:innen von KI-Systemen in der EU den neuen Regularien unterliegen. Dies betrifft sowohl in der EU ansässige als auch außerhalb der EU befindliche Akteur:innen, deren KI-Systeme in der EU genutzt werden. Der AI Act definiert KI weit: KI umfasst demnach Systeme, die maschinelles Lernen, logik- und wissensbasierte Konzepte oder statistische Ansätze nutzen. <br><br>KI-Anwendungen werden nach ihrem potenziellen Risiko in vier Kategorien eingeteilt: unannehmbares Risiko, hohes Risiko, geringes Risiko und minimales Risiko. Systeme mit unannehmbarem Risiko sind verboten, Hochrisiko-Systeme unterliegen strengen Anforderungen wie Risikomanagement und Daten-Governance, also Datenrichtlinien für die Erfassung, Speicherung, Verarbeitung und Vernichtung von Daten. Systeme mit geringem Risiko müssen minimale Transparenzpflichten erfüllen, während Anwendungen mit minimalem Risiko keine besonderen Anforderungen haben.<br><br>Der AI Act zeigt die EU-Bemühungen, Missbrauchspotenziale wie Beeinflussung und Überwachung durch KI zu minimieren. Unternehmen sollten sich frühzeitig mit den Regulierungen auseinandersetzen und ihre Entwicklungen entsprechend anpassen.

Es gibt auch die Gemeinfreiheit bei Werken. Was ist das genau?

Andrea Schlotfeldt: Zum einen sind Werke gemeinfrei, wenn der Urheberrechtsschutz abgelaufen ist, also 70 Jahre nach dem Tod des Urhebers oder der Urheberin. Oder Werke sind gemeinfrei, wenn sie gar nicht geschützt waren, weil es sich zum Beispiel um eine sehr einfache Gestaltung handelt, die keine Schöpfungshöhe, also keine besondere Originalität, aufweist, oder wenn es sich z. B. um Gesetzestexte handelt.

Wie kann ich sicherstellen, dass meine KI-generierten Inhalte nicht kopiert werden?

Andrea Schlotfeldt: Sicherstellen lässt sich dies nicht. Hier ist die Situation dieselbe wie bei herkömmlichen urheberrechtlich geschützten Texten oder Bildern, die ich veröffentliche. Sofern kein technischer Kopierschutz gegeben ist, können Inhalte rein faktisch übernommen werden. Wer bei mir „klauen“ möchte, den oder die kann ich nicht daran hindern.

Der Unterschied zu diesen von Menschen verfassten Inhalten ist, dass bei KI-Output in der Regel ja kein Urheberrechtsschutz anzunehmen ist, so dass die Weiternutzung zumeist tatsächlich zulässig ist (Stichwort „digitales Freiwild“). Derzeit wird unter Jurist:innen diskutiert, ob KI-Output künftig über ein sogenanntes Leistungsschutzrecht geschützt werden sollte, wie dies beispielsweise in Großbritannien in bestimmten Konstellationen der Fall ist. Ob eine solche Gesetzesänderung kommt, ist aber noch unsicher. Das Gesetzgebungsverfahren würde zudem sicher eine gewisse Zeit brauchen.

Gibt es Fälle, in denen mein KI-Output gleichwohl urheberrechtlich geschützt ist?

Andrea Schlotfeldt: Wenn Inhalte von mir wie Bilder oder Texte von einer KI nur geringfügig bearbeitet bzw. verändert wurden, aber im Wesentlichen immer noch meine Arbeit, mein Werk, sind, dann unterliegen sie weiterhin meinem Urheberrecht. So interpretiere ich die aktuelle Rechtslage. Wenn ich aber mittels KI ein Bild erstellen lasse, für das ich vorgebe, dass eine Lehr- bzw. Unterrichtssituation zu sehen sein soll, klassisch – ein Raum, Tische, Stühle, Monitore, Whiteboard und Studierende – und die KI generiert mir das, dann ist das nicht mein eigenes Werk. Wenn ich dieses Bild so – auch unbearbeitet – auf meine Website stelle, dann können es theoretisch auch andere nutzen. Es unterliegt dann keinem Urheberrecht. Das ist die Besonderheit – im Vergleich zu herkömmlichen Fotos oder Texten, auch wenn es mein Prompt ist, auf dem der Output ja letztlich basiert.

Gibt es eine Verpflichtung zur Transparenz, wenn ich Inhalte mit einer KI generiere?

Andrea Schlotfeldt: Hier kommt es auf die geplante Nutzung an: Eine generelle Pflicht zur Transparenz besteht aktuell noch nicht. Allerdings können sich auch jetzt schon Kennzeichnungspflichten aus Prüfungsvorgaben ergeben, etwa im Kontext der in der Regel geforderten Hilfsmittelangabe. Hierfür sind Art, Umfang und Zweck der KI-Nutzung ausschlaggebend. Die Umsetzung dieser Pflichten kann komplex ausfallen, zumal wenn die verwendeten Prompts mit aufzuführen sind.

Auch darf ich mich nicht als Urheber:in KI-generierter Texte ausweisen, wenn diese ausschließlich von einem KI-Tool erzeugt wurden. Die Grenzen sind allerdings fließend, und Rechtsprechung hierzu steht aus (Wieviel Anteil eines Textes darf beispielsweise KI-erzeugt sein, damit dieser noch als eigener Text gilt? Dies ist auch relevant bei Übersetzungen mit Diensten wie DeepL.). Bei Presseerzeugnissen können journalistische Sorgfaltspflichten ebenfalls eine Pflicht zur Kennzeichnung mit sich bringen.

Wichtig ist auch: Die EU hat im Mai 2024 den sogenannten AI Act verabschiedet – ein Gesetz für den Umgang mit KI. Darin ist auch eine Vorschrift enthalten, die eine Transparenzpflicht vorsieht. Sie soll voraussichtlich ab August 2025 gelten. Die genauen Vorgaben sind derzeit noch unkonkret. Hier werden juristische Kommentierungen oder ggf. Konkretisierungen durch das AI Office eine wertvolle Hilfe sein, Aktuell wird an diesen gearbeitet.

Eine Frage, die sich daran anschließt, ist die nach der Kontrolle. Wie kann man kontrollieren, ob ein Content KI-erzeugt ist?

Andrea Schlotfeldt: Kontrolle ist schwierig. Es gibt u. a. die Möglichkeit, Wasserzeichen einzusetzen, um KI-Output als solchen zu kennzeichnen, aber wie dauerhaft sind diese? Kann man sie einfach „herausschneiden“? Hier ist die Forschung gefragt und auch dabei (u. a. an der HAW Hamburg), gute Lösungen zu entwickeln, damit solche Markierungen nicht einfach entfernt werden können.

Was sind Deepfakes?<br>Deepfakes sind Medieninhalte, bei denen künstliche Intelligenz verwendet wird, um realistisch aussehende Fälschungen zu erstellen. Diese Fälschungen können Videos, Audios oder Bilder umfassen, bei denen das Gesicht oder die Stimme einer Person manipuliert oder komplett ersetzt wird, um den Eindruck zu erwecken, dass diese Person etwas gesagt oder getan hat, was in Wirklichkeit nicht der Fall ist. Der Begriff „Deepfake“ setzt sich aus „Deep Learning“ und „Fake“ zusammen und weist darauf hin, dass tiefe neuronale Netze, eine Technologie des maschinellen Lernens, verwendet werden, um diese Fälschungen zu erzeugen.

Thema Verantwortung und Haftung. Bin ich für meine Inhalte verantwortlich? Und kann ich die Verantwortung abgeben?

Andrea Schlotfeldt: Man kann die Verantwortung in der Regel nicht abgeben. Wenn man die Tools nutzt und damit Inhalte erstellt, dann sind die Nutzungsbedingungen dieser Programme in der Regel so ausgestaltet, dass der Nutzer oder die Nutzerin selbst verantwortlich ist. Anders kann die Situation zu beurteilen sein, wenn bei einer Prüfung der Einsatz eines KI-Tools verpflichtend vorgesehen ist und „unwissentlich“ eine Urheberrechtsverletzung entsteht, die zudem der Öffentlichkeit zugänglich wird, etwa im Zuge der Präsentation von Abschlussarbeiten. Hier hängt die Beurteilung sehr vom Einzelfall ab.

Viele Nutzende treibt der Datenschutz um. Bei ChatGPT gibt es die Möglichkeit, die eigenen Daten dahingehend zu schützen, dass die Prompts und Ergebnisse nicht weiterverwendet werden. Ist das wirklich möglich?

Andrea Schlotfeldt: Ob diese Einstellungen ein Garant für den Schutz sind, dazu sind mir keine Erhebungen oder Studien bekannt. Viele Expert:innen sprechen bei KI-Tools von einer Black Box. Was passiert da eigentlich? Wird eingehalten, dass meine Daten oder Werke nicht für das KI-Training verwendet werden? Das lässt sich derzeit nicht mit Sicherheit sagen. Wer seine Daten schützen will, sollte z. B. bei ChatGPT auf die History verzichten – und das kann wiederum problematisch sein. Diese Art der Dokumentation wird bei Prüfungen, bei denen KI-Generatoren erlaubt oder sogar vorgesehen sind, in der Regel vorausgesetzt, siehe oben, Stichwort Kennzeichnungspflichten. Das ist auch ein Problem, für das wir praxistaugliche Lösungen brauchen.

Hast du generell einen Tipp, wie man mit seinen Daten umgehen sollte?

Andrea Schlotfeldt: Möchte ich datensparsam vorgehen, sollte ich schon bei den eigenen Eingaben darauf achten, keine persönlichen Daten einzugeben und mir genau überlegen, wie viele Informationen ich preisgeben möchte. Wenn ich zum Beispiel meinen Lebenslauf von einer KI verbessern lasse, muss ich mich bewusst entscheiden, welche Daten ich der KI gebe.

Wenn ich im Personalwesen oder in der Forschung mit KI arbeite und zum Beispiel personenbezogene Daten zusammenfassen lasse, dann muss ich eine Rechtsgrundlage bzw. eine Einwilligung der Personen haben – und die muss freiwillig sein. Das heißt, die Person, die ich um Einwilligung bitte, muss verstehen, was genau mit den Daten passiert, und sie muss die Entscheidung tatsächlich als freiwillig empfinden. Es ist wichtig, dass wir diese Datensensibilität auf beiden Seiten entwickeln.

Was meinst du damit?

Andrea Schlotfeldt: Es geht zum einen darum, dass die Nutzerinnen und Nutzer von KI wissen, dass sie nicht einfach persönliche Daten anderer in das KI-Tool kopieren können, um zum Beispiel etwas zusammenzufassen oder sich die Arbeit anderweitig zu erleichtern. Gerade im Arbeitskontext, auch an Hochschulen, wird für Datenverarbeitungen immer eine Rechtsgrundlage benötigt. Zum anderen müssen auch die sogenannten „Betroffenen“, also die Menschen, deren Daten oder Informationen genutzt werden, verstehen, was konkret mit ihren Daten passiert und worauf sie bei einer Einwilligung achten müssen.

Das Thema KI wird uns rechtlich in den nächsten Jahren noch intensiv beschäftigen. Es geht um unsere eigenen Daten, um Urheberrechte und Transparenz, aber auch um die Verletzung von Persönlichkeitsrechten, zum Beispiel durch Deep Fakes.

Andrea Schlotfeldt: Ja, die sogenannten Deepfakes sind eine der großen Herausforderungen, denen wir begegnen. Je mehr technisch möglich ist und je mehr Menschen auch mit den Tools umgehen können, desto gravierender können die Auswirkungen auf die Gesellschaft und einzelne Betroffene sein. Der Bereich der pornografischen (Fake-)Darstellungen ist bereits jetzt ein riesiges Problem.

Auch die Politik und der Journalismus haben mit Deepfakes zu kämpfen – das kann Wahlen oder andere politische Entscheidungen beeinflussen, wenn Falschinformationen über KI-erzeugte Videos oder Bilder verbreitet werden. Ein weiteres Problem können sogenannten Softfakes sein, also Bilder, Videos oder Audioclips, die manipuliert werden, um politische Kandidat:innen attraktiver oder vorteilhafter wirken zu lassen. Auch im Bereich wissenschaftlicher Forschung können negative Auswirkungen, die auf Falschinformationen basieren, nicht ausgeschlossen werden.

Was kann hier helfen?

Andrea Schlotfeldt: Wir müssen eine deutlich höhere Sensibilität für solche falschen Inhalte entwickeln. Das geht nur durch (Weiter-)Bildung – und betrifft alle Altersstufen. Die Menschen müssen vielfältige Kompetenzen in diesem Bereich erwerben. Am besten fängt man damit schon bei Kindern an.

Viele Institutionen und Einrichtungen bieten bereits geeignete Materialien und Tools wie Fakefinder an. Auch von der HOOU an der HAW Hamburg gibt es ein passendes Lernangebot, adressiert an Lehrkräfte, die ihren Schülerinnen und Schülern wichtige Kompetenzen beim Umgang mit Informationen aus dem Netz vermitteln möchten, also auch Deepfakes. Diese Angebote sollten wir nutzen.

Über Andrea Schlotfeldt:

Andrea Schlotfeldt ist wissenschaftliche Mitarbeiterin Juristische Beratung für Projekte der Hamburg Open Online University an der HAW Hamburg. In dieser Rolle berät sie OER-Produzierende in rechtlicher Hinsicht bei der Konzeption und Veröffentlichung ihrer offenen Bildungsmaterialien. Darüber hinaus ist sie mit Fragen des Urheberrechts, des Datenschutzes und KI in der digitalen Lehre befasst. Sie ist zudem seit 2008 selbständige Rechtsanwältin, Dozentin und Referentin mit Schwerpunkt Urheber-/Vertragsrecht und KI, auch hier fokussiert auf Wissenschafts- und Bildungsinstitutionen.

Lizenzhinweis für das Interview (Text): CC BY 4.0